Ley de IA de la UE y WiFi para Invitados: Lo que los especialistas en marketing deben saber

La Ley de IA de la UE (Reglamento 2024/1689) introduce un marco basado en riesgos que afecta directamente cómo los operadores de recintos implementan marketing WiFi impulsado por IA, Captive Portals y análisis de invitados. Esta guía mapea los cuatro niveles de riesgo de la Ley con casos de uso reales de WiFi para Invitados, identifica prácticas prohibidas, incluyendo la inferencia de emociones y la puntuación social, y proporciona pasos de cumplimiento accionables para equipos de TI y directores de marketing que operan en entornos de hostelería, comercio minorista, eventos y sector público. Comprender dónde se sitúa su implementación en el espectro de riesgos —e implementar las obligaciones de transparencia del Artículo 50 para chatbots de IA y portales conversacionales— ya no es opcional: la aplicación de las prácticas prohibidas comenzó en febrero de 2025.

🎧 Escucha esta guía

Ver transcripción

- Resumen Ejecutivo

- Análisis Técnico Detallado

- El Marco de Riesgo de Cuatro Niveles

- Prácticas Prohibidas Según el Artículo 5

- Sistemas de Alto Riesgo Según el Anexo III

- Obligaciones de Transparencia del Artículo 50 — La Prioridad Inmediata

- La Ley de IA y GDPR: Un Marco de Cumplimiento Apilado

- Guía de Implementación

- Paso 1: Construya su Inventario de IA

- Paso 2: Clasifique Cada Sistema Según los Niveles de Riesgo

- Paso 3: Implemente las Divulgaciones del Artículo 50

- Paso 4: Revisar los Acuerdos de Subprocesadores de Proveedores

- Paso 5: Alinear con la Gobernanza de GDPR

- Paso 6: Planificar el Cumplimiento de Sistemas de Alto Riesgo (Fecha Límite: Agosto de 2026)

- Mejores Prácticas

- Solución de Problemas y Mitigación de Riesgos

- ROI e Impacto Empresarial

- Escuchar: Podcast sobre la Ley de IA de la UE y WiFi para Huéspedes

Resumen Ejecutivo

La Ley de IA de la UE (Reglamento 2024/1689) es el primer marco legal integral del mundo para la inteligencia artificial, y se aplica directamente a cómo los operadores de recintos implementan la IA en la infraestructura de WiFi para Invitados . La Ley clasifica los sistemas de IA en cuatro niveles de riesgo — Prohibido, Alto Riesgo, Riesgo Limitado y Riesgo Mínimo — y asigna las obligaciones de cumplimiento correspondientemente. Para la mayoría de los operadores de hostelería y comercio minorista , el impacto operativo inmediato se divide en dos áreas: primero, asegurar que cualquier interfaz conversacional impulsada por IA en un Captive Portal incluya una divulgación de transparencia clara del Artículo 50; y segundo, auditar las pilas de marketing existentes para confirmar que no utilizan prácticas prohibidas como la inferencia de emociones, la puntuación social o la categorización biométrica basada en atributos sensibles.

Las disposiciones sobre prácticas prohibidas del Artículo 5 entraron en vigor en febrero de 2025. Las obligaciones de los sistemas de alto riesgo del Anexo III se aplican a partir de agosto de 2026. Las multas por violaciones de prácticas prohibidas alcanzan hasta 35 millones de euros o el 7% de la facturación anual global. Esta guía proporciona una referencia técnica para gerentes de TI, arquitectos de red y líderes de cumplimiento que necesitan evaluar sus implementaciones actuales e implementar los cambios requeridos este trimestre.

Análisis Técnico Detallado

El Marco de Riesgo de Cuatro Niveles

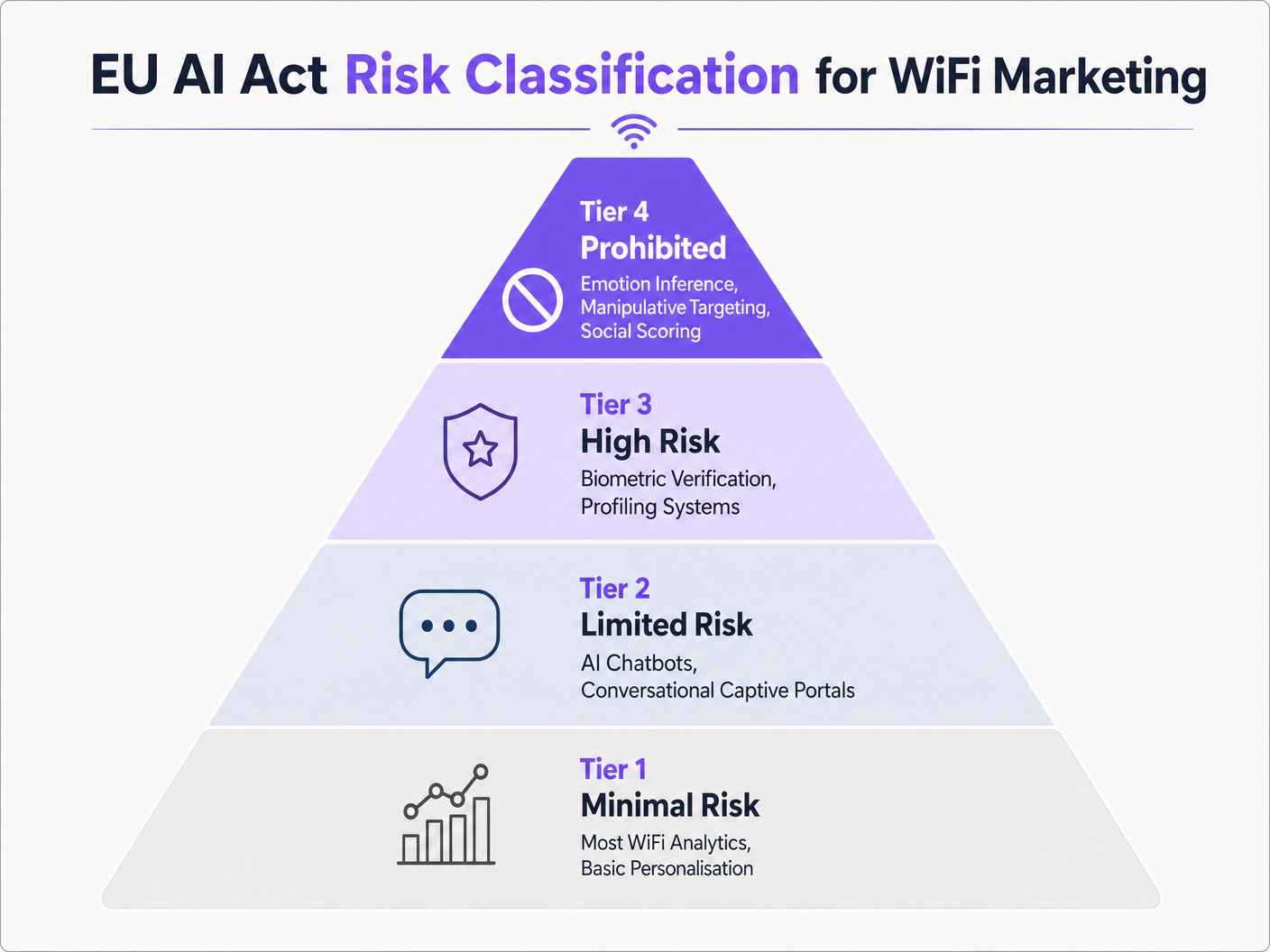

La Ley de IA de la UE clasifica los sistemas de IA según el riesgo que representan para los derechos fundamentales, la seguridad y los valores democráticos. La clasificación determina las obligaciones de cumplimiento que se aplican tanto al proveedor (el desarrollador o vendedor del sistema de IA) como al implementador (la organización que pone el sistema en servicio — típicamente el operador del recinto o el equipo de TI).

Los cuatro niveles, mapeados a los contextos de WiFi para Invitados y marketing de recintos, son los siguientes:

| Nivel de Riesgo | Referencia de la Ley de IA | Ejemplos de Marketing WiFi | Obligación de Cumplimiento |

|---|---|---|---|

| Prohibido | Artículo 5 | Inferencia de emociones en interacciones de portal; puntuación social de invitados; categorización biométrica por raza/religión | Cese inmediato; no se permite la implementación |

| Alto Riesgo | Anexo III | Verificación biométrica en Captive Portal; perfilado de IA para acceso a servicios esenciales | Evaluación de conformidad, documentación técnica, sistema de gestión de riesgos, registro en base de datos de la UE |

| Riesgo Limitado | Artículo 50 | Chatbots de IA en Captive Portals; páginas de bienvenida de IA generativa; sistemas de reconocimiento de emociones (contextos no prohibidos) | Divulgación de transparencia a los usuarios finales antes/durante la interacción |

| Riesgo Mínimo | Sin obligación específica | Análisis de afluencia agregada; mapas de calor de tiempo de permanencia; personalización basada en reglas; IA de optimización de ancho de banda | Sin obligaciones específicas de la Ley de IA (GDPR sigue aplicándose) |

Prácticas Prohibidas Según el Artículo 5

El Artículo 5 de la Ley de IA define ocho categorías de prácticas de IA prohibidas. Tres son directamente relevantes para las implementaciones de marketing WiFi en recintos.

Técnicas Manipuladoras y Engañosas. La Ley prohíbe los sistemas de IA que implementan técnicas subliminales, manipuladoras o engañosas para distorsionar el comportamiento de una persona y menoscabar su capacidad para tomar una decisión informada, cuando esto cause o sea probable que cause un daño significativo. En un contexto de marketing WiFi, esto se dirige a sistemas que explotan señales de comportamiento capturadas en el Captive Portal —dudas al hacer clic, patrones de desplazamiento, tiempo en la página— para inferir vulnerabilidades psicológicas y ofrecer promociones manipuladoras. El umbral clave es el daño significativo; los reguladores lo evaluarán contextualmente, pero el principio es claro: el "nudging" impulsado por IA que elude la agencia racional está fuera de alcance.

Puntuación Social. La Ley prohíbe los sistemas de IA que evalúan o clasifican a individuos basándose en su comportamiento social o características personales, cuando esto conduce a un trato perjudicial o desfavorable. Un sistema de fidelización WiFi que utiliza un modelo de IA para puntuar a los invitados según patrones de comportamiento —frecuencia de visitas, tiempo de permanencia, señales de compra— y luego restringe la velocidad de acceso o retiene ofertas a invitados con puntuaciones más bajas, caería dentro de esta prohibición. La distinción entre personalización permisible y puntuación social prohibida radica en si la clasificación de IA produce un trato perjudicial: ofrecer una mejor promoción a un invitado premium es personalización; negar el acceso a servicios a un invitado con puntuación más baja es puntuación social.

Categorización Biométrica de Atributos Sensibles. La Ley prohíbe los sistemas de IA que utilizan datos biométricos para inferir atributos sensibles, incluyendo raza, opinión política, afiliación sindical, creencias religiosas o filosóficas, vida sexual u orientación sexual. Esto es particularmente relevante para recintos que utilizan análisis basados en cámaras junto con datos WiFi. Si un sistema de IA cruza datos de direcciones MAC de dispositivos con análisis visuales para inferir la etnia y personalizar el contenido en consecuencia, eso es una violación directa del Artículo 5. La prohibición se aplica independientemente de si los datos biométricos se procesan en tiempo real o por lotes.

Inferencia de Emociones — Aclaración del Alcance. La Ley prohíbe la inferencia de emociones en lugares de trabajo e instituciones educativas. Esta prohibición no se extiende automáticamente a recintos minoristas, hoteles o estadios en relación con los invitados. Sin embargo, si su recinto es también un lugar de trabajo —un campus corporativo, un espacio de co-working, un hospital— y está utilizando la inferencia de emociones en empleados conectados al WiFi para invitados, eso está prohibido. Los operadores de recintos deben mapear cuidadosamente sus poblaciones de usuarios antes de asumir que la prohibición de inferencia de emociones no se aplica.

Sistemas de Alto Riesgo Según el Anexo III

El Anexo III de la Ley enumera casos de uso que se clasifican como de alto riesgo. Para las implementaciones de Guest WiFi, dos categorías son directamente relevantes.

Primero, sistemas biométricos: los sistemas remotos de identificación biométrica (excluyendo la verificación biométrica simple que confirma que una persona es quien dice ser) y los sistemas de categorización biométrica que infieren atributos sensibles o protegidos son de alto riesgo. Si su Captive Portal utiliza reconocimiento facial para autenticar a los huéspedes que regresan, ese sistema requiere una evaluación de conformidad completa, documentación técnica, un sistema de gestión de riesgos durante todo el ciclo de vida del sistema y el registro en la base de datos de la Ley de IA de la UE.

Segundo, perfilado individual: cualquier sistema de IA listado en el Anexo III se considera siempre de alto riesgo si perfila a individuos, lo que se define como el procesamiento automatizado de datos personales para evaluar aspectos de la vida de una persona, incluyendo preferencias, intereses, comportamiento y ubicación o movimiento. Esta es la disposición con mayor probabilidad de afectar a las plataformas de WiFi Analytics que construyen perfiles individuales persistentes que alimentan decisiones de marketing automatizadas. La pregunta clave es si el sistema de IA toma o influye sustancialmente en decisiones automatizadas sobre huéspedes individuales basándose en sus características perfiladas.

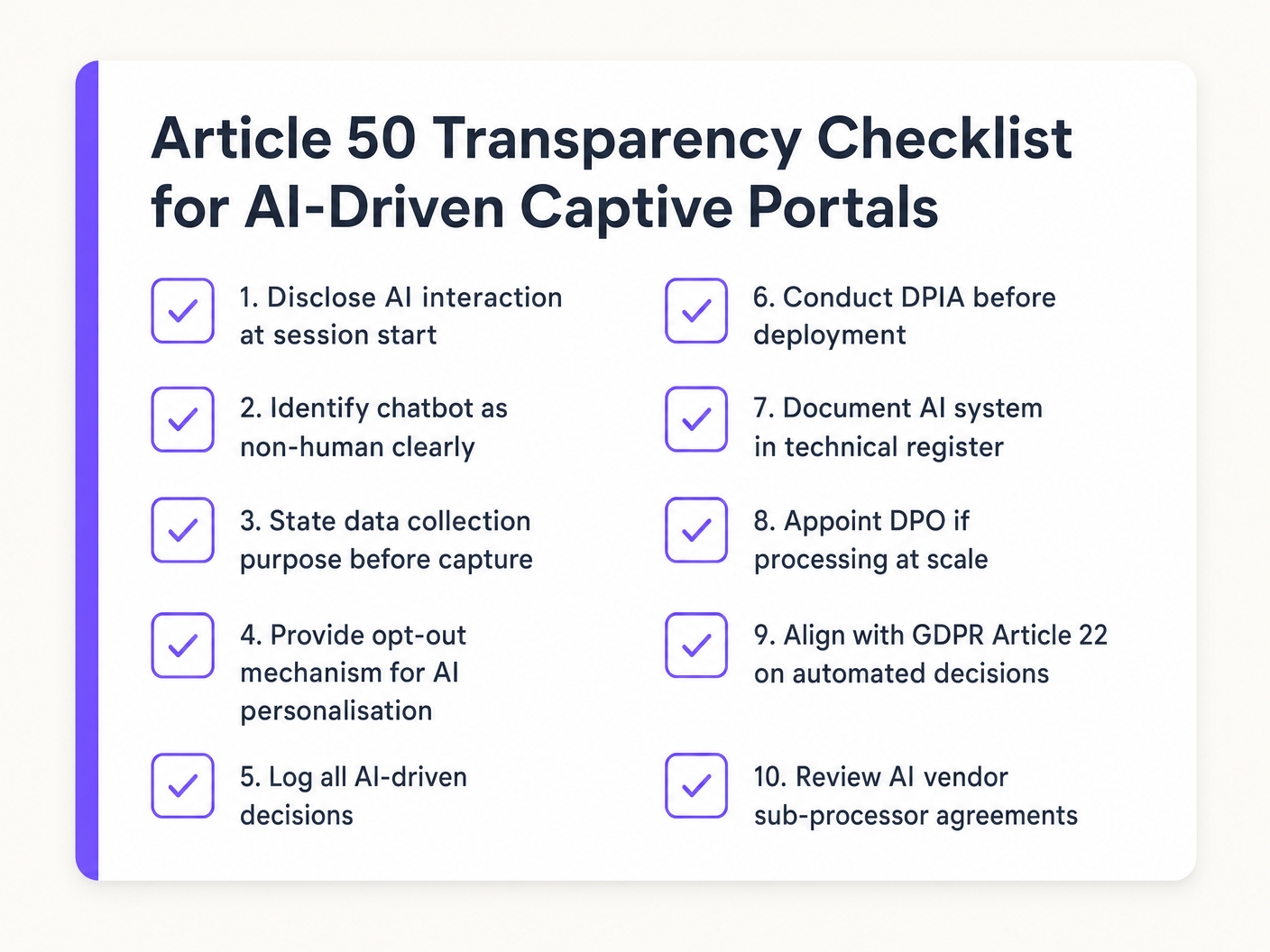

Obligaciones de Transparencia del Artículo 50 — La Prioridad Inmediata

Para la mayoría de los operadores de recintos hoy en día, el Artículo 50 es la disposición más relevante operativamente. Cubre tres escenarios:

Sistemas de IA conversacionales (Artículo 50(1)): Los proveedores deben asegurar que los sistemas de IA destinados a interactuar con personas físicas estén diseñados de manera que esas personas sean informadas de que están interactuando con un sistema de IA, a menos que esto sea obvio por el contexto. Los implementadores deben asegurar que esta divulgación esté en su lugar. Esto aplica a cualquier chatbot de IA implementado en un Captive Portal, ya sea para servicios al huésped, asistencia para el check-in del hotel, navegación del recinto o consultas de marketing.

Reconocimiento de emociones y categorización biométrica (Artículo 50(3)): Los implementadores de sistemas de reconocimiento de emociones o sistemas de categorización biométrica deben informar a las personas físicas expuestas a esos sistemas. Esta es una obligación separada de la divulgación del chatbot y se aplica incluso cuando el sistema no está prohibido.

Contenido sintético (Artículo 50(4)): Los sistemas de IA que generan contenido de audio, imagen, video o texto sintético deben marcar ese contenido como generado por IA. Si su Captive Portal utiliza IA generativa para producir mensajes de bienvenida personalizados o copias promocionales, ese contenido debe ser etiquetado.

La Ley de IA y GDPR: Un Marco de Cumplimiento Apilado

La Ley de IA no reemplaza a GDPR; opera en paralelo. Para los operadores de recintos, esto significa que las obligaciones de cumplimiento de ambos marcos se aplican simultáneamente a las implementaciones de marketing WiFi impulsadas por IA.

Bajo GDPR, las disposiciones relevantes para el marketing WiFi impulsado por IA incluyen: Artículo 6 (base legal para el procesamiento), Artículo 9 (datos de categoría especial — relevante si se procesan datos biométricos), Artículo 13/14 (obligaciones de transparencia en avisos de privacidad), Artículo 22 (restricciones sobre la toma de decisiones individuales automatizadas) y Artículo 35 (Evaluación de Impacto de Protección de Datos para el procesamiento de alto riesgo).

La Ley de IA añade: Artículo 5 (cumplimiento de prácticas prohibidas), Artículo 50 (divulgaciones de transparencia en el punto de interacción de la IA) y — para sistemas de alto riesgo — Artículos 8–17 (gestión de riesgos, documentación técnica, evaluación de conformidad, registro).

Donde GDPR requiere una DPIA para el procesamiento de datos de alto riesgo, la Ley de IA requiere un sistema de gestión de riesgos para sistemas de IA de alto riesgo. Estos pueden y deben estar alineados: una única evaluación integrada que cubra tanto los riesgos de procesamiento de datos (GDPR) como los riesgos del sistema de IA (Ley de IA) es más eficiente y demuestra una postura de gobernanza madura ante los reguladores.

El Artículo 22 de GDPR es particularmente relevante para los Captive Portals impulsados por IA. Restringe la toma de decisiones únicamente automatizada que produce efectos legales o significativamente similares en los individuos. Si su sistema de IA toma decisiones automatizadas sobre niveles de acceso WiFi, elegibilidad promocional o calidad del servicio sin supervisión humana, debe evaluar si el Artículo 22 aplica y si debe proporcionar a los huéspedes el derecho a solicitar una revisión humana.

Guía de Implementación

Paso 1: Construya su Inventario de IA

Antes de poder evaluar el cumplimiento, necesita una imagen completa de cada sistema de IA en su pila de marketing WiFi. Esto significa ir más allá de sus propias implementaciones para incluir componentes de IA incrustados en plataformas de terceros — herramientas de automatización de marketing, paneles de análisis, proveedores de Captive Portal e integraciones de CRM.

Para cada sistema, documente: la función del sistema; los datos que procesa; el proveedor y cualquier subprocesador; el nivel de riesgo bajo la Ley de IA; y las obligaciones de cumplimiento aplicables. Este inventario es la base de su postura de cumplimiento de la Ley de IA y será requerido si los reguladores solicitan evidencia de diligencia debida.

Paso 2: Clasifique Cada Sistema Según los Niveles de Riesgo

Aplique el marco de cuatro niveles a cada sistema en su inventario. Las preguntas de clasificación son:

- ¿El sistema utiliza alguna práctica listada en el Artículo 5? Si es así, está prohibido — cese la implementación.

- ¿El sistema se utiliza para verificación biométrica, perfilado individual para acceso a servicios o cualquier otro caso de uso del Anexo III? Si es así, es de alto riesgo — comience la planificación de la evaluación de conformidad.

- ¿El sistema interactúa con personas físicas de forma conversacional, genera contenido sintético o realiza reconocimiento de emociones? Si es así, es de riesgo limitado — implemente las divulgaciones del Artículo 50.

- ¿Ninguna de las anteriores? Es de riesgo mínimo — no hay obligaciones específicas de la Ley de IA, pero el cumplimiento de GDPR sigue siendo obligatorio.

Paso 3: Implemente las Divulgaciones del Artículo 50

Para cualquier chatbot de IA o interfaz conversacional en su Captive Portal, implemente una divulgación clara antes de lcomienza la interacción. La divulgación debe ser explícita, no implícita ni oculta en los términos y condiciones. Un elemento de interfaz de usuario simple que indique "Está chateando con un asistente de IA" al inicio de la sesión cumple con la obligación. Este es un cambio de front-end, no una reconstrucción del sistema, y debería poder implementarse en un solo sprint.

Para los sistemas de reconocimiento de emociones que operan en su establecimiento (donde no estén prohibidos), añada un aviso visible en el área de operación informando a los huéspedes que se está utilizando un sistema de reconocimiento de emociones.

Paso 4: Revisar los Acuerdos de Subprocesadores de Proveedores

Como implementador, usted comparte la responsabilidad por las prácticas prohibidas utilizadas por sus proveedores. Revise sus contratos con proveedores de plataformas de marketing WiFi, proveedores de análisis y proveedores de Captive Portal. Solicite una confirmación explícita de su clasificación según la Ley de IA y la documentación de cumplimiento. Añada disposiciones contractuales que exijan a los proveedores notificarle cualquier cambio en sus sistemas de IA que pueda afectar la clasificación de riesgo.

Paso 5: Alinear con la Gobernanza de GDPR

Involucre a su Delegado de Protección de Datos en el proceso de cumplimiento de la Ley de IA. Actualice su Registro de Actividades de Procesamiento para incluir las clasificaciones de sistemas de IA. Cuando se requiera una DPIA bajo GDPR para el procesamiento de datos de alto riesgo, extiéndala para cubrir los requisitos de gestión de riesgos de la Ley de IA. Asegúrese de que sus avisos de privacidad estén actualizados para reflejar el procesamiento impulsado por IA y las divulgaciones del Artículo 50.

Paso 6: Planificar el Cumplimiento de Sistemas de Alto Riesgo (Fecha Límite: Agosto de 2026)

Si alguno de sus sistemas está clasificado como de alto riesgo, inicie el proceso de evaluación de conformidad ahora. La fecha límite de agosto de 2026 para los sistemas del Anexo III está más cerca de lo que parece si se tiene en cuenta el tiempo necesario para la documentación técnica, la implementación del sistema de gestión de riesgos y el registro en la base de datos de la UE. Involucre a sus proveedores con anticipación para comprender qué documentación pueden proporcionar y qué necesita producir usted como implementador.

Mejores Prácticas

Adopte un enfoque de Privacidad desde el Diseño para la implementación de IA. Los requisitos de la Ley de IA para sistemas de alto riesgo —gestión de riesgos a lo largo del ciclo de vida, gobernanza de datos, documentación técnica— se cumplen de manera más eficiente cuando se integran en la arquitectura del sistema desde el principio, en lugar de adaptarse posteriormente. Al evaluar nuevas herramientas de marketing impulsadas por IA, incluya los requisitos de cumplimiento de la Ley de IA en sus criterios de adquisición junto con el cumplimiento de GDPR y los estándares de seguridad como ISO 27001 y PCI DSS.

Prefiera datos de primera parte basados en el consentimiento sobre atributos inferidos. Las prácticas prohibidas y las clasificaciones de alto riesgo de la Ley están dirigidas principalmente a sistemas de IA que infieren características sensibles o toman decisiones automatizadas significativas sobre individuos. Los sistemas que utilizan datos de primera parte explícitamente consentidos —direcciones de correo electrónico, preferencias declaradas, membresía en programas de lealtad— para impulsar la personalización tienen un riesgo regulatorio significativamente menor que los sistemas que infieren características a partir de señales de comportamiento.

Mantenga una separación entre la IA para operaciones de red y la IA para marketing. Los sistemas de IA utilizados para la gestión de red —asignación de ancho de banda, mitigación de interferencias, balanceo de carga— presentan un riesgo mínimo según la Ley. Los sistemas de IA utilizados para la elaboración de perfiles de huéspedes y la personalización de marketing conllevan un riesgo mayor. Mantenerlos arquitectónicamente separados simplifica su clasificación de riesgo y limita el impacto de cualquier problema de cumplimiento en la pila de marketing.

Consulte IEEE 802.1X y WPA3 para la arquitectura de autenticación. Cuando se utilice verificación biométrica en el Captive Portal, asegúrese de que la arquitectura de autenticación subyacente cumpla con los estándares actuales. IEEE 802.1X proporciona control de acceso a la red basado en puertos con autenticación sólida, y WPA3 proporciona cifrado mejorado para la capa inalámbrica. Estos estándares son neutrales en cuanto a proveedores y se mencionan tanto en los marcos de seguridad empresarial como en la guía de GDPR sobre medidas técnicas apropiadas.

Documente sus decisiones de cumplimiento de la Ley de IA. Incluso para sistemas de riesgo mínimo, documentar su justificación de clasificación demuestra la debida diligencia a los reguladores. La Ley de IA exige a los proveedores de sistemas de alto riesgo documentar su evaluación antes de comercializar el sistema; como implementador, mantener documentación equivalente para sus propias evaluaciones de riesgo es una mejor práctica.

Solución de Problemas y Mitigación de Riesgos

Riesgo: Las prácticas de IA del proveedor son opacas. Muchas plataformas de automatización de marketing y análisis de WiFi incorporan capacidades de IA que no están claramente documentadas. Mitigación: Emita un cuestionario formal de cumplimiento de la Ley de IA a todos los proveedores. Solicite su clasificación de sistema, documentación técnica y evidencia de evitación de prácticas prohibidas. Incluya el cumplimiento de la Ley de IA como un requisito contractual en acuerdos nuevos y renovados.

Riesgo: El chatbot del Captive Portal carece de la divulgación del Artículo 50. Esta es la brecha de cumplimiento más común identificada en las implementaciones actuales. Mitigación: Audite la interfaz de usuario de su Captive Portal. Si alguna interfaz de IA conversacional carece de una divulgación clara previa a la interacción, este es un elemento de remediación prioritario. La solución es un cambio en la interfaz de usuario que se puede implementar en días.

Riesgo: La plataforma de análisis construye perfiles individuales que activan la clasificación de alto riesgo. Si su plataforma de WiFi Analytics construye perfiles individuales persistentes que alimentan decisiones de marketing automatizadas, podría estar operando un sistema de alto riesgo sin la evaluación de conformidad requerida. Mitigación: Revise el modelo de datos de la plataforma. Si se están construyendo y utilizando perfiles individuales para decisiones automatizadas, contacte a su proveedor sobre su clasificación según la Ley de IA e inicie un proceso de evaluación de conformidad.

Riesgo: El cumplimiento de GDPR y la Ley de IA se tratan como flujos de trabajo separados. Las organizaciones que gestionan el cumplimiento de GDPR y la Ley de IA en equipos separados corren el riesgo de duplicaciones, lagunas y documentación inconsistente. Mitigación: Establezca un marco unificado de gobernanza de IA que aborde ambos marcos regulatorios. Un único proceso integrado de DPIA/evaluación de riesgos de IA es más eficiciente y más defendible.

Riesgo: Clasificación errónea del alcance de la inferencia de emociones. La prohibición de la inferencia de emociones se aplica en lugares de trabajo e instituciones educativas. Los lugares que también son lugares de trabajo —campus corporativos, hospitales, espacios de co-working— deben aplicar la prohibición a los sistemas orientados a los empleados, no solo a los orientados a los huéspedes. Mitigación: Mapee sus poblaciones de usuarios y aplique la prohibición a todos los contextos donde los empleados puedan estar sujetos a la inferencia de emociones.

ROI e Impacto Empresarial

El cumplimiento de la Ley de IA de la UE no es puramente un centro de costos. Las organizaciones que construyen marcos de gobernanza de AI antes de la curva de aplicación obtienen ventajas competitivas medibles.

Riesgo regulatorio reducido. Las multas por violaciones de prácticas prohibidas —hasta 35 millones de euros o el 7% de la facturación anual global— representan un riesgo financiero material para cualquier organización que opere a escala en los estados miembros de la UE. Una postura de cumplimiento proactiva elimina esta exposición.

Diferenciación de proveedores. A medida que el cumplimiento de la AI Act se convierte en un requisito de adquisición, las plataformas que pueden demostrar una clasificación de riesgo clara, prácticas de AI transparentes e interfaces compatibles con el Artículo 50 serán preferidas sobre aquellas que no pueden. Para los operadores de hospitalidad y retail que evalúan plataformas de marketing de WiFi, la documentación de cumplimiento de la AI Act se está convirtiendo en un requisito estándar de RFP.

Confianza del huésped y calidad de los datos de primera parte. Las obligaciones de transparencia según el Artículo 50 —cuando se implementan bien— aumentan la confianza del huésped. Los huéspedes que entienden cómo se está utilizando la AI en su interacción son más propensos a participar auténticamente y proporcionar datos de primera parte de mayor calidad. Esto mejora directamente la precisión de los modelos de personalización y el ROI de las campañas de marketing.

Eficiencia operativa a través de una gobernanza unificada. Las organizaciones que alinean sus marcos de cumplimiento de GDPR y la AI Act en una única estructura de gobernanza reducen la duplicación de esfuerzos entre los equipos legales, de TI y de marketing. La inversión en la construcción de este marco rinde dividendos a medida que el panorama regulatorio continúa evolucionando —la AI Act será seguida por una regulación adicional específica de AI, y una postura de gobernanza madura proporciona una base duradera.

Para los operadores de transporte y las organizaciones del sector público, el cumplimiento de la AI Act es particularmente importante dada la mayor supervisión de los sistemas de AI en espacios de acceso público. El cumplimiento proactivo demuestra responsabilidad tanto ante los reguladores como ante el público, apoyando objetivos más amplios de confianza digital.

Para más información sobre marcos de cumplimiento relacionados, consulte nuestra guía sobre PIPEDA Compliance for Guest WiFi in Canada , que cubre requisitos análogos de consentimiento y transparencia en el contexto canadiense.

Escuchar: Podcast sobre la Ley de IA de la UE y WiFi para Huéspedes

Términos clave y definiciones

Provider (EU AI Act)

A natural or legal person, public authority, agency, or other body that develops an AI system or general-purpose AI model, or that has an AI system or general-purpose AI model developed, with a view to placing it on the market or putting it into service under its own name or trademark, whether for payment or free of charge.

In a Guest WiFi context, the provider is typically the WiFi marketing platform vendor or the developer of the AI personalisation engine. Providers of high-risk systems carry the heaviest compliance obligations under the Act.

Deployer (EU AI Act)

A natural or legal person, public authority, agency, or other body that uses an AI system under its own authority, except where the AI system is used in the course of a personal non-professional activity.

The venue operator — hotel group, retail chain, stadium operator — is the deployer. Deployers are responsible for Article 50 transparency disclosures and for ensuring that the AI systems they use comply with the Act's requirements, even when those systems are provided by third parties.

Biometric Categorisation System

An AI system for the purpose of assigning natural persons to specific categories on the basis of their biometric data, such as face, movement, gait, posture, voice, appearance, behaviour, or other physiological or behavioural human characteristics or traits.

Relevant for venue operators using camera-based analytics or device fingerprinting in combination with AI. Systems that infer sensitive attributes (race, religion, political opinion) from biometric data are prohibited under Article 5. Systems that perform biometric categorisation without inferring sensitive attributes may be high-risk under Annex III.

Emotion Recognition System

An AI system for the purpose of identifying or inferring emotions or intentions of natural persons on the basis of their biometric data.

Prohibited in workplaces and educational institutions under Article 5. In other venue contexts (retail, hospitality), emotion recognition systems are regulated under Annex III as high-risk and require deployers to inform affected persons under Article 50(3). Vendors marketing 'mood-based' or 'engagement state' features should be assessed against this definition.

Individual Profiling

Any form of automated processing of personal data consisting of the use of personal data to evaluate certain personal aspects relating to a natural person, in particular to analyse or predict aspects concerning that natural person's performance, economic situation, health, personal preferences, interests, reliability, behaviour, location or movements.

AI systems listed under Annex III are always considered high-risk if they profile individuals. WiFi analytics platforms that build persistent individual profiles feeding into automated marketing decisions must be assessed against this definition to determine whether they are high-risk systems.

Social Scoring

The evaluation or classification of natural persons or groups of persons over a period of time based on their social behaviour or known, inferred, or predicted personal or personality characteristics, with a social score leading to detrimental or unfavourable treatment of those persons or groups in social contexts that are unrelated to the contexts in which the data was originally generated or collected.

Prohibited under Article 5. In a WiFi marketing context, this targets AI systems that score guests on behavioural patterns and use those scores to restrict access, withhold offers, or provide inferior service. The key element is detrimental treatment — personalisation that improves the experience for high-value guests is not social scoring unless it simultaneously disadvantages lower-scoring guests.

Captive Portal

A web page or authentication gateway presented to newly connected users of a WiFi network before they are granted broader access to the internet. Used by venue operators to collect guest data, present terms of service, and deliver marketing content.

The primary deployment surface for AI-driven WiFi marketing. AI features on captive portals — chatbots, personalised splash pages, recommendation engines — are subject to Article 50 transparency obligations. The captive portal is also the point at which GDPR consent for data processing is typically obtained.

Conformity Assessment

The process of verifying whether a high-risk AI system complies with the requirements set out in the EU AI Act, including risk management, data governance, technical documentation, transparency, human oversight, accuracy, robustness, and cybersecurity.

Required for high-risk AI systems before they are placed on the market or put into service. For most high-risk systems under Annex III, providers can conduct a self-assessment. For biometric identification systems, third-party assessment is required. Venue operators deploying high-risk AI systems need to ensure their vendors have completed the required conformity assessment and can provide the documentation.

DPIA (Data Protection Impact Assessment)

A process required under GDPR Article 35 for processing operations that are likely to result in a high risk to the rights and freedoms of natural persons. The DPIA must describe the processing, assess necessity and proportionality, and identify and mitigate risks.

Required under GDPR for high-risk data processing, including large-scale profiling and systematic monitoring of publicly accessible areas. In the AI Act context, the DPIA should be extended to cover AI system risk management requirements, creating a unified assessment that satisfies both regulatory frameworks.

Article 50 Transparency Obligation

The requirement under Article 50 of the EU AI Act that providers ensure AI systems intended to interact with natural persons are designed so that those persons are informed they are interacting with an AI system, unless this is obvious from the context. Deployers must ensure this disclosure is in place.

The most immediately actionable compliance obligation for venue operators with AI chatbots or conversational interfaces on their captive portals. The disclosure must be clear and upfront — before the interaction begins — not buried in terms and conditions. Applies to all AI conversational systems regardless of risk tier.

Casos de éxito

A 450-room hotel group operating across five EU member states has deployed an AI-driven chatbot on its captive portal to handle guest check-in queries, restaurant recommendations, and WiFi troubleshooting. The chatbot is powered by a third-party LLM platform. The marketing team also uses a WiFi analytics platform that builds individual guest profiles — including visit history, dwell time by venue area, and inferred demographic segments — to serve personalised promotional offers via the captive portal splash page. The CTO needs to assess the AI Act compliance posture of both systems before the next board meeting.

Step 1 — Classify the chatbot. The AI-driven chatbot is a conversational AI system interacting with natural persons. It falls under Article 50(1) as a Limited Risk system. The immediate action is to implement a clear pre-interaction disclosure on the captive portal UI: 'You are chatting with an AI assistant.' This is a front-end change. The hotel group, as the deployer, is responsible for this disclosure even though the underlying LLM is provided by a third party. Review the vendor contract to confirm the provider's AI Act classification and request their technical documentation.

Step 2 — Classify the analytics platform. The WiFi analytics platform builds individual guest profiles and uses them to serve personalised offers via automated decisions. The key question is whether this constitutes individual profiling under Annex III — automated processing of personal data to assess preferences, interests, behaviour, and location. If yes, the system is high-risk. Request the vendor's AI Act classification documentation. If the vendor classifies the system as minimal risk, obtain their written rationale and assess whether it is defensible. If the system is high-risk, begin planning for conformity assessment compliance ahead of the August 2026 deadline.

Step 3 — Audit the inferred demographic segments. If the analytics platform infers demographic segments that include sensitive attributes — age bracket, gender, nationality — using AI models, assess whether this constitutes biometric categorisation of sensitive attributes under Article 5. If the segmentation is based on declared data (loyalty programme membership, explicitly provided preferences) rather than AI inference from behavioural signals, it is lower risk. If it is AI-inferred from behavioural signals, it requires careful legal review.

Step 4 — Align with GDPR. Ensure the hotel group's privacy notice reflects AI-driven processing and the Article 50 disclosures. Review the lawful basis for the analytics processing under GDPR Article 6. If the processing is based on legitimate interests, conduct a legitimate interests assessment that accounts for the AI Act risk classification. Update the DPIA to cover both GDPR and AI Act risk dimensions.

A national retail chain with 120 stores across Germany, France, and the Netherlands is evaluating a new WiFi marketing platform that includes an AI feature described by the vendor as 'mood-based personalisation' — the system analyses the speed and pattern of a guest's captive portal interactions to infer their 'engagement state' and adjusts the promotional content served on the splash page accordingly. The IT director needs to assess whether this feature is permissible under the EU AI Act.

Step 1 — Identify the AI practice. The 'mood-based personalisation' feature analyses behavioural signals (interaction speed and pattern) to infer an 'engagement state' — which is functionally an emotional or psychological state. This is emotion inference.

Step 2 — Apply the Article 5 prohibition test. Article 5 prohibits emotion inference in workplaces and educational institutions. A retail store is not a workplace for the guest, so this specific prohibition does not apply to the guest population in the retail context. However, the feature may still be prohibited under Article 5(1)(a) if it deploys manipulative techniques to distort behaviour and impair informed decision-making, causing significant harm. The use of inferred emotional state to serve manipulative promotional content — targeting a guest identified as 'frustrated' with an urgency-based offer, for example — is likely to fall within this prohibition.

Step 3 — Assess the GDPR implications. Inferring emotional state from behavioural data constitutes processing of personal data for profiling purposes under GDPR. The lawful basis for this processing must be assessed. Legitimate interests is unlikely to be a defensible basis for emotion inference used for marketing purposes. Explicit consent is the most appropriate basis, but the consent mechanism must be specific and granular — consent to WiFi access does not constitute consent to emotion inference.

Step 4 — Recommendation. Do not deploy the 'mood-based personalisation' feature without a detailed legal assessment. The risk of Article 5 violation — specifically the manipulation prohibition — is material. Request the vendor's legal analysis of the feature's AI Act classification. If the vendor cannot provide a defensible classification, treat the feature as prohibited and do not activate it. Standard behavioural personalisation based on objective metrics (visit frequency, time of day, declared preferences) is permissible and carries significantly lower regulatory risk.

Análisis de escenarios

Q1. Your venue's WiFi marketing platform vendor has just released a new feature called 'Visitor Sentiment Scoring' that analyses the speed, sequence, and hesitation patterns of a guest's captive portal interactions to assign a sentiment score (positive, neutral, frustrated) and adjust the promotional content served accordingly. The vendor's documentation describes this as 'behavioural analytics' rather than 'emotion recognition'. As the IT director, how do you assess this feature's EU AI Act compliance status, and what actions do you take?

💡 Sugerencia:Focus on the technical function of the system, not the vendor's marketing language. Ask: what is the system actually doing? Is it inferring an emotional or psychological state from behavioural signals? Then apply the Article 5 prohibition test and the Article 50 transparency test.

Mostrar enfoque recomendado

The feature is functionally an emotion recognition system regardless of the vendor's labelling. Analysing interaction patterns to infer 'frustration' or 'positive sentiment' is emotion inference. The first step is to apply the Article 5 prohibition test: is this system being used in a workplace or educational institution? If the venue is a retail store or hotel, the Article 5 workplace prohibition does not apply to guests. However, the manipulation prohibition under Article 5(1)(a) may apply if the system uses the inferred sentiment to serve manipulative content — for example, targeting a 'frustrated' guest with an urgency-based offer. The second step is to assess whether the system falls under Annex III as an emotion recognition system, which would make it high-risk. The third step is to request the vendor's written AI Act classification and legal analysis. If the vendor cannot provide a defensible classification, do not activate the feature. Document your assessment rationale regardless of the outcome.

Q2. A stadium operator running a 60,000-capacity venue uses Purple's Guest WiFi platform to collect first-party data at events. The marketing team wants to deploy an AI chatbot on the captive portal to answer fan queries about facilities, merchandise, and upcoming events. The chatbot is powered by a third-party LLM API. The venue's legal team asks: what are the Article 50 obligations, who is responsible for compliance, and what does the implementation look like in practice?

💡 Sugerencia:Identify the deployer, the provider, and the applicable Article 50 scenario. Then specify what the disclosure must look like and when it must appear.

Mostrar enfoque recomendado

The stadium operator is the deployer; the LLM API provider is the provider. Under Article 50(1), the deployer is responsible for ensuring that guests are informed they are interacting with an AI system before the interaction begins. The implementation requires a clear disclosure on the captive portal UI — a badge or introductory message such as 'You are chatting with an AI assistant' — displayed before the first message is sent. This is a front-end change to the captive portal template. The disclosure must be explicit and upfront; it cannot be buried in the terms of service. The LLM provider has their own obligations as a provider (technical documentation, instructions for use), but the deployer cannot rely on the provider to satisfy the deployer's transparency obligations. Additionally, the stadium operator must ensure the chatbot's data processing complies with GDPR — the lawful basis for processing any personal data shared in the conversation must be established, and the privacy notice must reflect the AI-driven processing.

Q3. A retail chain's WiFi analytics platform has been building individual guest profiles for two years, combining WiFi session data (device MAC address, dwell time, visit frequency, location within store) with CRM data (purchase history, loyalty programme tier) to feed an AI model that makes automated decisions about which promotional offers to serve each guest at the captive portal. The chain's new compliance lead has been asked to assess whether this system is high-risk under the EU AI Act's Annex III individual profiling provision. What is the assessment methodology and likely outcome?

💡 Sugerencia:Apply the Annex III individual profiling test: is the AI system performing automated processing of personal data to assess aspects of a person's preferences, interests, behaviour, or location? Then consider whether the automated decisions are significant enough to trigger the high-risk classification.

Mostrar enfoque recomendado

The assessment methodology follows three steps. First, confirm that the system is an AI system (not a simple rules-based engine) — if the promotional decision is made by a machine learning model rather than a deterministic rules engine, it is an AI system. Second, apply the Annex III individual profiling test: the system is processing personal data (WiFi session data, CRM data) to assess individual preferences, interests, behaviour, and location. This meets the definition of individual profiling. Third, assess whether the system is listed under Annex III use cases — the most relevant category is 'access to and enjoyment of essential public and private services', which includes AI systems used to evaluate eligibility for services. Whether promotional offer decisions constitute 'access to services' is a grey area; if the AI system can deny a guest access to a promotional offer that materially affects their purchasing decision, regulators may take the view that this is significant. The likely outcome is that the system should be treated as potentially high-risk and a formal assessment conducted. The chain should engage the platform vendor to obtain their AI Act classification, initiate a DPIA/AI risk assessment, and begin planning for conformity assessment compliance ahead of the August 2026 deadline.