Loi sur l'IA de l'UE et WiFi invité : Ce que les marketeurs doivent savoir

La Loi sur l'IA de l'UE (Règlement 2024/1689) introduit un cadre basé sur les risques qui affecte directement la manière dont les opérateurs de sites déploient le marketing WiFi basé sur l'IA, les portails captifs et l'analyse des invités. Ce guide met en correspondance les quatre niveaux de risque de la Loi avec des cas d'utilisation réels du WiFi invité, identifie les pratiques interdites, y compris l'inférence d'émotions et le scoring social, et fournit des étapes de conformité concrètes pour les équipes informatiques et les directeurs marketing opérant dans les secteurs de l'hôtellerie, du commerce de détail, de l'événementiel et du secteur public. Comprendre où se situe votre déploiement sur le spectre des risques — et mettre en œuvre les obligations de transparence de l'Article 50 pour les chatbots IA et les portails conversationnels — n'est plus facultatif : l'application des pratiques interdites a commencé en février 2025.

🎧 Écouter ce guide

Voir la transcription

- Résumé Exécutif

- Approfondissement Technique

- Le Cadre de Risque à Quatre Niveaux

- Pratiques Interdites en Vertu de l'Article 5

- Systèmes à Haut Risque en Vertu de l'Annexe III

- Article 50 Obligations de Transparence — La Priorité Immédiate

- L'AI Act et le GDPR : Un Cadre de Conformité Superposé

- Guide d'Implémentation

- Étape 1 : Construisez Votre Inventaire d'IA

- Étape 2 : Classez Chaque Système en Fonction des Niveaux de Risque

- Étape 3 : Mettez en Œuvre les Divulgations de l'Article 50

- Étape 4 : Examiner les accords avec les sous-traitants des fournisseurs

- Étape 5 : S'aligner sur la gouvernance GDPR

- Étape 6 : Planifier la conformité des systèmes à haut risque (date limite : août 2026)

- Bonnes pratiques

- Dépannage et atténuation des risques

- ROI et impact commercial

- Écouter : Podcast sur l'EU AI Act et le WiFi invité

Résumé Exécutif

La Loi sur l'IA de l'UE (Règlement 2024/1689) est le premier cadre juridique complet au monde pour l'intelligence artificielle, et elle s'applique directement à la manière dont les opérateurs de sites déploient l'IA à travers l'infrastructure Guest WiFi . La Loi classe les systèmes d'IA en quatre niveaux de risque — Interdit, Risque Élevé, Risque Limité et Risque Minimal — et attribue les obligations de conformité en conséquence. Pour la plupart des opérateurs de l' hôtellerie et du commerce de détail , l'impact opérationnel immédiat se divise en deux domaines : premièrement, s'assurer que toute interface conversationnelle basée sur l'IA sur un captive portal comporte une divulgation de transparence claire de l'Article 50 ; et deuxièmement, auditer les piles marketing existantes pour confirmer qu'elles n'utilisent pas de pratiques interdites telles que l'inférence d'émotions, le scoring social ou la catégorisation biométrique basée sur des attributs sensibles.

Les dispositions relatives aux pratiques interdites en vertu de l'Article 5 sont devenues applicables en février 2025. Les obligations relatives aux systèmes à haut risque en vertu de l'Annexe III s'appliquent à partir d'août 2026. Les amendes pour les violations des pratiques interdites peuvent atteindre 35 millions d'euros ou 7 % du chiffre d'affaires annuel mondial. Ce guide fournit une référence technique pour les responsables informatiques, les architectes réseau et les responsables de la conformité qui doivent évaluer leurs déploiements actuels et mettre en œuvre les changements requis ce trimestre.

Approfondissement Technique

Le Cadre de Risque à Quatre Niveaux

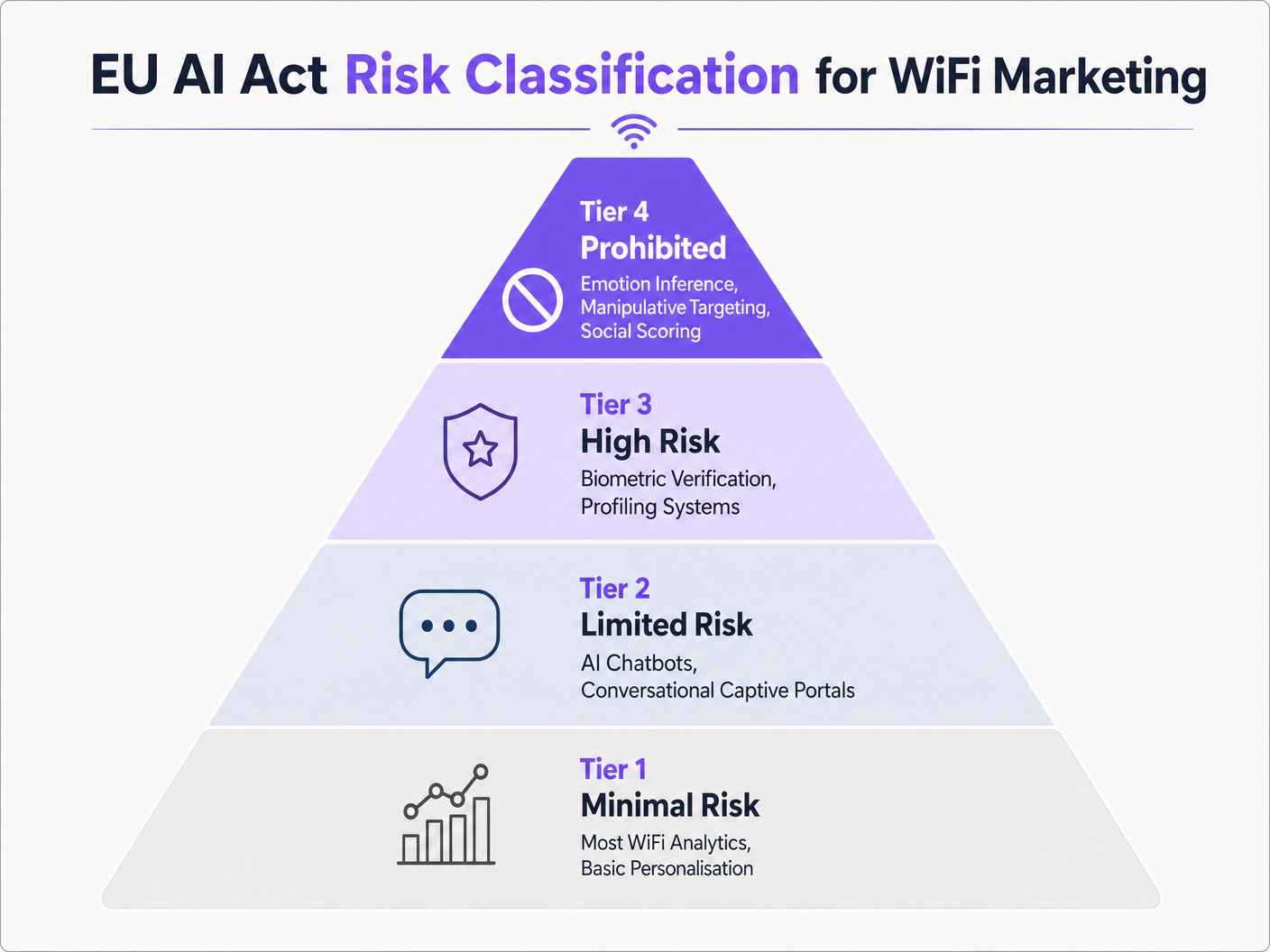

La Loi sur l'IA de l'UE classe les systèmes d'IA en fonction du risque qu'ils posent aux droits fondamentaux, à la sécurité et aux valeurs démocratiques. Cette classification détermine les obligations de conformité qui s'appliquent à la fois au fournisseur (le développeur ou le vendeur du système d'IA) et au déployeur (l'organisation qui met le système en service — généralement l'opérateur du site ou l'équipe informatique).

Les quatre niveaux, mis en correspondance avec les contextes du Guest WiFi et du marketing de site, sont les suivants :

| Niveau de Risque | Référence de la Loi sur l'IA | Exemples de Marketing WiFi | Obligation de Conformité |

|---|---|---|---|

| Interdit | Article 5 | Inférence d'émotions lors des interactions sur le portal ; scoring social des invités ; catégorisation biométrique par race/religion | Cessation immédiate ; aucun déploiement autorisé |

| Risque Élevé | Annexe III | Vérification biométrique sur le captive portal ; profilage IA pour l'accès aux services essentiels | Évaluation de la conformité, documentation technique, système de gestion des risques, enregistrement dans la base de données de l'UE |

| Risque Limité | Article 50 | Chatbots IA sur les captive portals ; pages d'accueil IA génératives ; systèmes de reconnaissance d'émotions (contextes non interdits) | Divulgation de transparence aux utilisateurs finaux avant/pendant l'interaction |

| Risque Minimal | Aucune obligation spécifique | Analyse agrégée de la fréquentation ; cartes thermiques de temps de présence ; personnalisation basée sur des règles ; IA d'optimisation de la bande passante | Aucune obligation spécifique à la Loi sur l'IA (le GDPR s'applique toujours) |

Pratiques Interdites en Vertu de l'Article 5

L'Article 5 de la Loi sur l'IA définit huit catégories de pratiques d'IA interdites. Trois sont directement pertinentes pour les déploiements de marketing WiFi de site.

Techniques Manipulatrices et Trompeuses. La Loi interdit les systèmes d'IA qui déploient des techniques subliminales, manipulatrices ou trompeuses pour déformer le comportement d'une personne et altérer sa capacité à prendre une décision éclairée, lorsque cela cause ou est susceptible de causer un préjudice significatif. Dans un contexte de marketing WiFi, cela vise les systèmes qui exploitent les signaux comportementaux capturés au niveau du captive portal — hésitation au clic, schémas de défilement, temps passé sur la page — pour inférer des vulnérabilités psychologiques et proposer des offres manipulatrices. Le seuil clé est le préjudice significatif ; les régulateurs l'évalueront contextuellement, mais le principe est clair : le nudging basé sur l'IA qui contourne l'agence rationnelle est hors de portée.

Scoring Social. La Loi interdit les systèmes d'IA qui évaluent ou classent les individus en fonction de leur comportement social ou de leurs caractéristiques personnelles, lorsque cela conduit à un traitement préjudiciable ou défavorable. Un système de fidélité WiFi qui utilise un modèle d'IA pour noter les invités en fonction de leurs schémas comportementaux — fréquence de visite, temps de présence, signaux d'achat — et qui restreint ensuite la vitesse d'accès ou refuse des offres aux invités moins bien notés, tomberait sous le coup de cette interdiction. La distinction entre la personnalisation permise et le scoring social interdit réside dans le fait que la classification par l'IA produise un traitement préjudiciable : offrir une meilleure offre à un invité premium est de la personnalisation ; refuser l'accès aux services à un invité moins bien noté est du scoring social.

Catégorisation Biométrique d'Attributs Sensibles. La Loi interdit les systèmes d'IA qui utilisent des données biométriques pour inférer des attributs sensibles, y compris la race, l'opinion politique, l'appartenance syndicale, les croyances religieuses ou philosophiques, la vie sexuelle ou l'orientation sexuelle. Ceci est particulièrement pertinent pour les sites utilisant des analyses basées sur des caméras en conjonction avec les données WiFi. Si un système d'IA croise les données d'adresse MAC de l'appareil avec des analyses visuelles pour inférer l'ethnicité et personnaliser le contenu en conséquence, il s'agit d'une violation directe de l'Article 5. L'interdiction s'applique que les données biométriques soient traitées en temps réel ou par lots.

Inférence d'Émotions — Clarification du Champ d'Application. La Loi interdit l'inférence d'émotions dans les lieux de travail et les établissements d'enseignement. Cette interdiction ne s'étend pas automatiquement aux commerces de détail, aux hôtels ou aux stades en ce qui concerne les invités. Cependant, si votre site est également un lieu de travail — un campus d'entreprise, un espace de co-working, un hôpital — et que vous utilisez l'inférence d'émotions sur les employés connectés au Guest WiFi, cela est interdit. Les opérateurs de sites doivent cartographier attentivement leurs populations d'utilisateurs avant de supposer que l'interdiction d'inférence d'émotions ne s'applique pas.

Systèmes à Haut Risque en Vertu de l'Annexe III

L'Annexe III de la Loi énumère les cas d'utilisation qui sont classifiés comme à haut risque. Pour les déploiements de Guest WiFi, deux catégories sont directement pertinentes.

Premièrement, les systèmes biométriques : les systèmes d'identification biométrique à distance (à l'exclusion de la simple vérification biométrique qui confirme qu'une personne est bien celle qu'elle prétend être) et les systèmes de catégorisation biométrique inférant des attributs sensibles ou protégés sont à haut risque. Si votre Captive Portal utilise la reconnaissance faciale pour authentifier les invités récurrents, ce système nécessite une évaluation complète de la conformité, une documentation technique, un système de gestion des risques tout au long du cycle de vie du système et un enregistrement dans la base de données de l'EU AI Act.

Deuxièmement, le profilage individuel : tout système d'IA listé à l'Annexe III est toujours considéré comme à haut risque s'il profile des individus — défini comme le traitement automatisé de données personnelles pour évaluer des aspects de la vie d'une personne, y compris ses préférences, ses intérêts, son comportement, sa localisation ou ses déplacements. C'est la disposition la plus susceptible de concerner les plateformes WiFi Analytics qui construisent des profils individuels persistants alimentant des décisions marketing automatisées. La question clé est de savoir si le système d'IA prend ou influence substantiellement des décisions automatisées concernant des invités individuels basées sur leurs caractéristiques profilées.

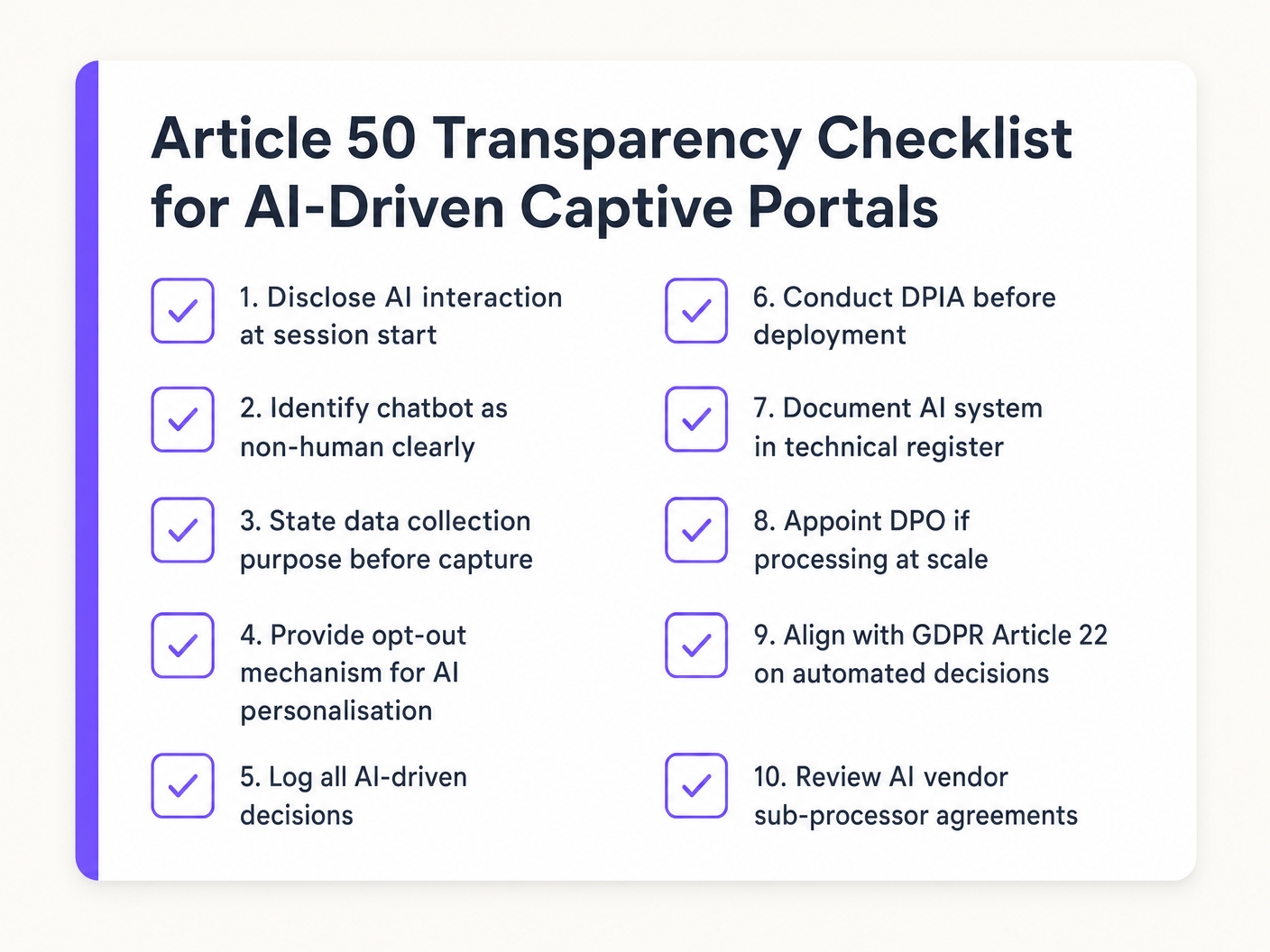

Article 50 Obligations de Transparence — La Priorité Immédiate

Pour la majorité des opérateurs de lieux aujourd'hui, l'Article 50 est la disposition la plus pertinente sur le plan opérationnel. Il couvre trois scénarios :

Systèmes d'IA conversationnels (Article 50(1)) : Les fournisseurs doivent s'assurer que les systèmes d'IA destinés à interagir avec des personnes physiques sont conçus de manière à ce que ces personnes soient informées qu'elles interagissent avec un système d'IA, à moins que cela ne soit évident d'après le contexte. Les déployeurs doivent s'assurer que cette divulgation est en place. Cela s'applique à tout chatbot d'IA déployé sur un Captive Portal — que ce soit pour les services aux invités, l'assistance à l'enregistrement à l'hôtel, la navigation dans le lieu ou les requêtes marketing.

Reconnaissance des émotions et catégorisation biométrique (Article 50(3)) : Les déployeurs de systèmes de reconnaissance des émotions ou de systèmes de catégorisation biométrique doivent informer les personnes physiques exposées à ces systèmes. Il s'agit d'une obligation distincte de la divulgation du chatbot et s'applique même lorsque le système n'est pas interdit.

Contenu synthétique (Article 50(4)) : Les systèmes d'IA générant du contenu audio, image, vidéo ou textuel synthétique doivent marquer ce contenu comme généré par l'IA. Si votre Captive Portal utilise l'IA générative pour produire des messages de bienvenue personnalisés ou des textes promotionnels, ce contenu doit être étiqueté.

L'AI Act et le GDPR : Un Cadre de Conformité Superposé

L'AI Act ne remplace pas le GDPR ; il fonctionne en parallèle. Pour les opérateurs de lieux, cela signifie que les obligations de conformité des deux cadres s'appliquent simultanément aux déploiements de marketing WiFi basés sur l'IA.

En vertu du GDPR, les dispositions pertinentes pour le marketing WiFi basé sur l'IA incluent : l'Article 6 (base légale du traitement), l'Article 9 (données de catégorie spéciale — pertinent si des données biométriques sont traitées), l'Article 13/14 (obligations de transparence dans les avis de confidentialité), l'Article 22 (restrictions sur la prise de décision individuelle automatisée) et l'Article 35 (évaluation d'impact sur la protection des données pour les traitements à haut risque).

L'AI Act ajoute : l'Article 5 (conformité aux pratiques interdites), l'Article 50 (divulgations de transparence au point d'interaction avec l'IA) et — pour les systèmes à haut risque — les Articles 8 à 17 (gestion des risques, documentation technique, évaluation de la conformité, enregistrement).

Lorsque le GDPR exige une DPIA pour le traitement de données à haut risque, l'AI Act exige un système de gestion des risques pour les systèmes d'IA à haut risque. Ceux-ci peuvent et doivent être alignés : une évaluation intégrée unique couvrant à la fois les risques de traitement des données (GDPR) et les risques du système d'IA (AI Act) est plus efficace et démontre une posture de gouvernance mature aux régulateurs.

L'Article 22 du GDPR est particulièrement pertinent pour les Captive Portals basés sur l'IA. Il restreint la prise de décision uniquement automatisée qui produit des effets juridiques ou des effets significatifs similaires sur les individus. Si votre système d'IA prend des décisions automatisées concernant les niveaux d'accès WiFi, l'éligibilité promotionnelle ou la qualité du service sans supervision humaine, vous devez évaluer si l'Article 22 s'applique et si vous devez offrir aux invités le droit de demander un examen humain.

Guide d'Implémentation

Étape 1 : Construisez Votre Inventaire d'IA

Avant de pouvoir évaluer la conformité, vous avez besoin d'une image complète de chaque système d'IA dans votre pile de marketing WiFi. Cela signifie aller au-delà de vos propres déploiements pour inclure les composants d'IA intégrés dans les plateformes tierces — outils d'automatisation marketing, tableaux de bord analytiques, fournisseurs de Captive Portal et intégrations CRM.

Pour chaque système, documentez : la fonction du système ; les données qu'il traite ; le fournisseur et tout sous-traitant ; le niveau de risque en vertu de l'AI Act ; et les obligations de conformité applicables. Cet inventaire est le fondement de votre posture de conformité à l'AI Act et sera requis si les régulateurs demandent des preuves de diligence raisonnable.

Étape 2 : Classez Chaque Système en Fonction des Niveaux de Risque

Appliquez le cadre à quatre niveaux à chaque système de votre inventaire. Les questions de classification sont :

- Le système utilise-t-il une pratique listée à l'Article 5 ? Si oui, il est interdit — cessez le déploiement.

- Le système est-il utilisé pour la vérification biométrique, le profilage individuel pour l'accès aux services, ou tout autre cas d'utilisation de l'Annexe III ? Si oui, il est à haut risque — commencez la planification de l'évaluation de la conformité.

- Le système interagit-il de manière conversationnelle avec des personnes physiques, génère-t-il du contenu synthétique ou effectue-t-il de la reconnaissance des émotions ? Si oui, il est à risque limité — mettez en œuvre les divulgations de l'Article 50.

- Aucune des réponses ci-dessus ? Il est à risque minimal — aucune obligation spécifique à l'AI Act, mais la conformité au GDPR reste obligatoire.

Étape 3 : Mettez en Œuvre les Divulgations de l'Article 50

Pour tout chatbot d'IA ou interface conversationnelle sur votre Captive Portal, mettez en œuvre une divulgation claire avant tl'interaction commence. La divulgation doit être explicite — non implicite, non enfouie dans les termes et conditions. Un simple élément d'interface utilisateur indiquant "Vous discutez avec un assistant IA" au début de la session satisfait à cette obligation. Il s'agit d'un changement frontal, non d'une refonte du système, et il devrait être déployable en un seul sprint.

Pour les systèmes de reconnaissance des émotions fonctionnant dans votre établissement (là où ce n'est pas interdit), ajoutez un avis visible dans la zone d'opération informant les clients qu'un système de reconnaissance des émotions est en cours d'utilisation.

Étape 4 : Examiner les accords avec les sous-traitants des fournisseurs

En tant que déployeur, vous partagez la responsabilité des pratiques interdites utilisées par vos fournisseurs. Examinez vos contrats avec les fournisseurs de plateformes de marketing WiFi, les fournisseurs d'analyse et les fournisseurs de Captive Portal. Demandez une confirmation explicite de leur classification selon l'AI Act et de leur documentation de conformité. Ajoutez des dispositions contractuelles exigeant des fournisseurs qu'ils vous informent de tout changement apporté à leurs systèmes d'IA susceptible d'affecter la classification des risques.

Étape 5 : S'aligner sur la gouvernance GDPR

Intégrez votre Délégué à la Protection des Données (DPO) dans le processus de conformité à l'AI Act. Mettez à jour votre Registre des Activités de Traitement pour inclure les classifications des systèmes d'IA. Lorsqu'une DPIA est requise en vertu du GDPR pour le traitement de données à haut risque, étendez-la pour couvrir les exigences de gestion des risques de l'AI Act. Assurez-vous que vos avis de confidentialité sont mis à jour pour refléter le traitement piloté par l'IA et les divulgations de l'Article 50.

Étape 6 : Planifier la conformité des systèmes à haut risque (date limite : août 2026)

Si l'un de vos systèmes est classé à haut risque, commencez dès maintenant le processus d'évaluation de la conformité. La date limite d'août 2026 pour les systèmes de l'Annexe III est plus proche qu'il n'y paraît si l'on tient compte du temps nécessaire à la documentation technique, à la mise en œuvre du système de gestion des risques et à l'enregistrement dans la base de données de l'UE. Impliquez vos fournisseurs tôt pour comprendre quelle documentation ils peuvent fournir et ce que vous devez produire en tant que déployeur.

Bonnes pratiques

Adoptez une approche de la Privacy-by-Design pour le déploiement de l'IA. Les exigences de l'AI Act pour les systèmes à haut risque — gestion des risques tout au long du cycle de vie, gouvernance des données, documentation technique — sont satisfaites plus efficacement lorsqu'elles sont intégrées à l'architecture du système dès le départ plutôt que d'être ajoutées après coup. Lors de l'évaluation de nouveaux outils de marketing basés sur l'IA, incluez les exigences de conformité à l'AI Act dans vos critères d'approvisionnement, aux côtés de la conformité au GDPR et des normes de sécurité telles que ISO 27001 et PCI DSS.

Préférez les données de première partie, basées sur le consentement, aux attributs inférés. Les pratiques interdites et les classifications à haut risque de l'Act visent principalement les systèmes d'IA qui infèrent des caractéristiques sensibles ou prennent des décisions automatisées importantes concernant des individus. Les systèmes qui utilisent des données de première partie explicitement consenties — adresses e-mail, préférences déclarées, adhésion à un programme de fidélité — pour piloter la personnalisation présentent un risque réglementaire significativement plus faible que les systèmes qui infèrent des caractéristiques à partir de signaux comportementaux.

Maintenez une séparation entre l'IA des opérations réseau et l'IA marketing. Les systèmes d'IA utilisés pour la gestion du réseau — allocation de bande passante, atténuation des interférences, équilibrage de charge — présentent un risque minimal en vertu de l'Act. Les systèmes d'IA utilisés pour le profilage des clients et la personnalisation marketing comportent un risque plus élevé. Les maintenir architecturalement séparés simplifie votre classification des risques et limite le rayon d'impact de tout problème de conformité dans la pile marketing.

Référencez IEEE 802.1X et WPA3 pour l'architecture d'authentification. Lorsque la vérification biométrique est utilisée au niveau du Captive Portal, assurez-vous que l'architecture d'authentification sous-jacente respecte les normes actuelles. IEEE 802.1X fournit un contrôle d'accès réseau basé sur les ports avec une authentification forte, et WPA3 fournit un chiffrement amélioré pour la couche sans fil. Ces normes sont indépendantes des fournisseurs et sont référencées à la fois dans les cadres de sécurité d'entreprise et dans les directives GDPR sur les mesures techniques appropriées.

Documentez vos décisions de conformité à l'AI Act. Même pour les systèmes à risque minimal, la documentation de votre justification de classification démontre la diligence raisonnable aux régulateurs. L'AI Act exige des fournisseurs de systèmes à haut risque qu'ils documentent leur évaluation avant de mettre le système sur le marché ; en tant que déployeur, maintenir une documentation équivalente pour vos propres évaluations des risques est une bonne pratique.

Dépannage et atténuation des risques

Risque : Les pratiques d'IA des fournisseurs sont opaques. De nombreuses plateformes d'automatisation marketing et d'analyse WiFi intègrent des capacités d'IA qui ne sont pas clairement documentées. Atténuation : Envoyez un questionnaire formel de conformité à l'AI Act à tous les fournisseurs. Demandez leur classification de système, leur documentation technique et des preuves d'évitement des pratiques interdites. Incluez la conformité à l'AI Act comme exigence contractuelle dans les accords nouveaux et renouvelés.

Risque : Le chatbot du Captive Portal ne divulgue pas l'Article 50. C'est la lacune de conformité la plus courante identifiée dans les déploiements actuels. Atténuation : Auditez l'interface utilisateur de votre Captive Portal. Si une interface d'IA conversationnelle ne contient pas de divulgation claire avant l'interaction, il s'agit d'un élément de remédiation prioritaire. La correction est un changement d'interface utilisateur déployable en quelques jours.

Risque : La plateforme d'analyse construit des profils individuels qui déclenchent une classification à haut risque. Si votre WiFi Analytics plateforme construit des profils individuels persistants alimentant des décisions marketing automatisées, vous pourriez opérer un système à haut risque sans l'évaluation de conformité requise. Atténuation : Examinez le modèle de données de la plateforme. Si des profils individuels sont construits et utilisés pour des décisions automatisées, contactez votre fournisseur concernant leur classification selon l'AI Act et initiez un processus d'évaluation de la conformité.

Risque : La conformité au GDPR et à l'AI Act est traitée comme des flux de travail distincts. Les organisations qui gèrent la conformité au GDPR et à l'AI Act dans des équipes distinctes risquent la duplication, les lacunes et une documentation incohérente. Atténuation : Établissez un cadre de gouvernance de l'IA unifié qui aborde les deux cadres réglementaires. Un processus intégré unique de DPIA/évaluation des risques liés à l'IA est plus efficient et plus défendable.

Risque : Erreur de classification du champ d'application de l'inférence émotionnelle. L'interdiction de l'inférence émotionnelle s'applique dans les lieux de travail et les établissements d'enseignement. Les lieux qui sont aussi des lieux de travail — campus d'entreprise, hôpitaux, espaces de co-working — doivent appliquer l'interdiction aux systèmes destinés aux employés, et pas seulement à ceux destinés aux invités. Atténuation : Cartographiez vos populations d'utilisateurs et appliquez l'interdiction à tous les contextes où les employés peuvent être soumis à l'inférence émotionnelle.

ROI et impact commercial

La conformité à l'EU AI Act n'est pas purement un centre de coûts. Les organisations qui mettent en place des cadres de gouvernance de l'IA avant la courbe d'application obtiennent des avantages concurrentiels mesurables.

Risque réglementaire réduit. Les amendes pour les violations de pratiques interdites — jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires annuel mondial — représentent un risque financier matériel pour toute organisation opérant à grande échelle dans les États membres de l'UE. Une posture de conformité proactive élimine cette exposition.

Différenciation des fournisseurs. À mesure que la conformité à l'AI Act devient une exigence d'approvisionnement, les plateformes capables de démontrer une classification claire des risques, des pratiques d'IA transparentes et des interfaces conformes à l'Article 50 seront préférées à celles qui ne le peuvent pas. Pour les opérateurs de l' hôtellerie et du commerce de détail évaluant les plateformes de marketing WiFi, la documentation de conformité à l'AI Act devient une exigence standard des RFP.

Confiance des invités et qualité des données de première partie. Les obligations de transparence en vertu de l'Article 50 — lorsqu'elles sont bien mises en œuvre — augmentent la confiance des invités. Les invités qui comprennent comment l'IA est utilisée dans leur interaction sont plus susceptibles de s'engager de manière authentique et de fournir des données de première partie de meilleure qualité. Cela améliore directement la précision des modèles de personnalisation et le ROI des campagnes marketing.

Efficacité opérationnelle grâce à une gouvernance unifiée. Les organisations qui alignent leurs cadres de conformité GDPR et AI Act en une structure de gouvernance unique réduisent la duplication des efforts entre les équipes juridiques, informatiques et marketing. L'investissement dans la construction de ce cadre porte ses fruits à mesure que le paysage réglementaire continue d'évoluer — l'AI Act sera suivi par d'autres réglementations spécifiques à l'IA, et une posture de gouvernance mature fournit une base durable.

Pour les opérateurs de transport et les organisations du secteur public, la conformité à l'AI Act est particulièrement importante compte tenu de l'examen accru des systèmes d'IA dans les espaces accessibles au public. Une conformité proactive démontre la responsabilité envers les régulateurs et le public, soutenant des objectifs plus larges de confiance numérique.

Pour en savoir plus sur les cadres de conformité connexes, consultez notre guide sur la conformité PIPEDA pour le WiFi invité au Canada , qui couvre les exigences analogues en matière de consentement et de transparence dans le contexte canadien.

Écouter : Podcast sur l'EU AI Act et le WiFi invité

Termes clés et définitions

Provider (EU AI Act)

A natural or legal person, public authority, agency, or other body that develops an AI system or general-purpose AI model, or that has an AI system or general-purpose AI model developed, with a view to placing it on the market or putting it into service under its own name or trademark, whether for payment or free of charge.

In a Guest WiFi context, the provider is typically the WiFi marketing platform vendor or the developer of the AI personalisation engine. Providers of high-risk systems carry the heaviest compliance obligations under the Act.

Deployer (EU AI Act)

A natural or legal person, public authority, agency, or other body that uses an AI system under its own authority, except where the AI system is used in the course of a personal non-professional activity.

The venue operator — hotel group, retail chain, stadium operator — is the deployer. Deployers are responsible for Article 50 transparency disclosures and for ensuring that the AI systems they use comply with the Act's requirements, even when those systems are provided by third parties.

Biometric Categorisation System

An AI system for the purpose of assigning natural persons to specific categories on the basis of their biometric data, such as face, movement, gait, posture, voice, appearance, behaviour, or other physiological or behavioural human characteristics or traits.

Relevant for venue operators using camera-based analytics or device fingerprinting in combination with AI. Systems that infer sensitive attributes (race, religion, political opinion) from biometric data are prohibited under Article 5. Systems that perform biometric categorisation without inferring sensitive attributes may be high-risk under Annex III.

Emotion Recognition System

An AI system for the purpose of identifying or inferring emotions or intentions of natural persons on the basis of their biometric data.

Prohibited in workplaces and educational institutions under Article 5. In other venue contexts (retail, hospitality), emotion recognition systems are regulated under Annex III as high-risk and require deployers to inform affected persons under Article 50(3). Vendors marketing 'mood-based' or 'engagement state' features should be assessed against this definition.

Individual Profiling

Any form of automated processing of personal data consisting of the use of personal data to evaluate certain personal aspects relating to a natural person, in particular to analyse or predict aspects concerning that natural person's performance, economic situation, health, personal preferences, interests, reliability, behaviour, location or movements.

AI systems listed under Annex III are always considered high-risk if they profile individuals. WiFi analytics platforms that build persistent individual profiles feeding into automated marketing decisions must be assessed against this definition to determine whether they are high-risk systems.

Social Scoring

The evaluation or classification of natural persons or groups of persons over a period of time based on their social behaviour or known, inferred, or predicted personal or personality characteristics, with a social score leading to detrimental or unfavourable treatment of those persons or groups in social contexts that are unrelated to the contexts in which the data was originally generated or collected.

Prohibited under Article 5. In a WiFi marketing context, this targets AI systems that score guests on behavioural patterns and use those scores to restrict access, withhold offers, or provide inferior service. The key element is detrimental treatment — personalisation that improves the experience for high-value guests is not social scoring unless it simultaneously disadvantages lower-scoring guests.

Captive Portal

A web page or authentication gateway presented to newly connected users of a WiFi network before they are granted broader access to the internet. Used by venue operators to collect guest data, present terms of service, and deliver marketing content.

The primary deployment surface for AI-driven WiFi marketing. AI features on captive portals — chatbots, personalised splash pages, recommendation engines — are subject to Article 50 transparency obligations. The captive portal is also the point at which GDPR consent for data processing is typically obtained.

Conformity Assessment

The process of verifying whether a high-risk AI system complies with the requirements set out in the EU AI Act, including risk management, data governance, technical documentation, transparency, human oversight, accuracy, robustness, and cybersecurity.

Required for high-risk AI systems before they are placed on the market or put into service. For most high-risk systems under Annex III, providers can conduct a self-assessment. For biometric identification systems, third-party assessment is required. Venue operators deploying high-risk AI systems need to ensure their vendors have completed the required conformity assessment and can provide the documentation.

DPIA (Data Protection Impact Assessment)

A process required under GDPR Article 35 for processing operations that are likely to result in a high risk to the rights and freedoms of natural persons. The DPIA must describe the processing, assess necessity and proportionality, and identify and mitigate risks.

Required under GDPR for high-risk data processing, including large-scale profiling and systematic monitoring of publicly accessible areas. In the AI Act context, the DPIA should be extended to cover AI system risk management requirements, creating a unified assessment that satisfies both regulatory frameworks.

Article 50 Transparency Obligation

The requirement under Article 50 of the EU AI Act that providers ensure AI systems intended to interact with natural persons are designed so that those persons are informed they are interacting with an AI system, unless this is obvious from the context. Deployers must ensure this disclosure is in place.

The most immediately actionable compliance obligation for venue operators with AI chatbots or conversational interfaces on their captive portals. The disclosure must be clear and upfront — before the interaction begins — not buried in terms and conditions. Applies to all AI conversational systems regardless of risk tier.

Études de cas

A 450-room hotel group operating across five EU member states has deployed an AI-driven chatbot on its captive portal to handle guest check-in queries, restaurant recommendations, and WiFi troubleshooting. The chatbot is powered by a third-party LLM platform. The marketing team also uses a WiFi analytics platform that builds individual guest profiles — including visit history, dwell time by venue area, and inferred demographic segments — to serve personalised promotional offers via the captive portal splash page. The CTO needs to assess the AI Act compliance posture of both systems before the next board meeting.

Step 1 — Classify the chatbot. The AI-driven chatbot is a conversational AI system interacting with natural persons. It falls under Article 50(1) as a Limited Risk system. The immediate action is to implement a clear pre-interaction disclosure on the captive portal UI: 'You are chatting with an AI assistant.' This is a front-end change. The hotel group, as the deployer, is responsible for this disclosure even though the underlying LLM is provided by a third party. Review the vendor contract to confirm the provider's AI Act classification and request their technical documentation.

Step 2 — Classify the analytics platform. The WiFi analytics platform builds individual guest profiles and uses them to serve personalised offers via automated decisions. The key question is whether this constitutes individual profiling under Annex III — automated processing of personal data to assess preferences, interests, behaviour, and location. If yes, the system is high-risk. Request the vendor's AI Act classification documentation. If the vendor classifies the system as minimal risk, obtain their written rationale and assess whether it is defensible. If the system is high-risk, begin planning for conformity assessment compliance ahead of the August 2026 deadline.

Step 3 — Audit the inferred demographic segments. If the analytics platform infers demographic segments that include sensitive attributes — age bracket, gender, nationality — using AI models, assess whether this constitutes biometric categorisation of sensitive attributes under Article 5. If the segmentation is based on declared data (loyalty programme membership, explicitly provided preferences) rather than AI inference from behavioural signals, it is lower risk. If it is AI-inferred from behavioural signals, it requires careful legal review.

Step 4 — Align with GDPR. Ensure the hotel group's privacy notice reflects AI-driven processing and the Article 50 disclosures. Review the lawful basis for the analytics processing under GDPR Article 6. If the processing is based on legitimate interests, conduct a legitimate interests assessment that accounts for the AI Act risk classification. Update the DPIA to cover both GDPR and AI Act risk dimensions.

A national retail chain with 120 stores across Germany, France, and the Netherlands is evaluating a new WiFi marketing platform that includes an AI feature described by the vendor as 'mood-based personalisation' — the system analyses the speed and pattern of a guest's captive portal interactions to infer their 'engagement state' and adjusts the promotional content served on the splash page accordingly. The IT director needs to assess whether this feature is permissible under the EU AI Act.

Step 1 — Identify the AI practice. The 'mood-based personalisation' feature analyses behavioural signals (interaction speed and pattern) to infer an 'engagement state' — which is functionally an emotional or psychological state. This is emotion inference.

Step 2 — Apply the Article 5 prohibition test. Article 5 prohibits emotion inference in workplaces and educational institutions. A retail store is not a workplace for the guest, so this specific prohibition does not apply to the guest population in the retail context. However, the feature may still be prohibited under Article 5(1)(a) if it deploys manipulative techniques to distort behaviour and impair informed decision-making, causing significant harm. The use of inferred emotional state to serve manipulative promotional content — targeting a guest identified as 'frustrated' with an urgency-based offer, for example — is likely to fall within this prohibition.

Step 3 — Assess the GDPR implications. Inferring emotional state from behavioural data constitutes processing of personal data for profiling purposes under GDPR. The lawful basis for this processing must be assessed. Legitimate interests is unlikely to be a defensible basis for emotion inference used for marketing purposes. Explicit consent is the most appropriate basis, but the consent mechanism must be specific and granular — consent to WiFi access does not constitute consent to emotion inference.

Step 4 — Recommendation. Do not deploy the 'mood-based personalisation' feature without a detailed legal assessment. The risk of Article 5 violation — specifically the manipulation prohibition — is material. Request the vendor's legal analysis of the feature's AI Act classification. If the vendor cannot provide a defensible classification, treat the feature as prohibited and do not activate it. Standard behavioural personalisation based on objective metrics (visit frequency, time of day, declared preferences) is permissible and carries significantly lower regulatory risk.

Analyse de scénario

Q1. Your venue's WiFi marketing platform vendor has just released a new feature called 'Visitor Sentiment Scoring' that analyses the speed, sequence, and hesitation patterns of a guest's captive portal interactions to assign a sentiment score (positive, neutral, frustrated) and adjust the promotional content served accordingly. The vendor's documentation describes this as 'behavioural analytics' rather than 'emotion recognition'. As the IT director, how do you assess this feature's EU AI Act compliance status, and what actions do you take?

💡 Astuce :Focus on the technical function of the system, not the vendor's marketing language. Ask: what is the system actually doing? Is it inferring an emotional or psychological state from behavioural signals? Then apply the Article 5 prohibition test and the Article 50 transparency test.

Afficher l'approche recommandée

The feature is functionally an emotion recognition system regardless of the vendor's labelling. Analysing interaction patterns to infer 'frustration' or 'positive sentiment' is emotion inference. The first step is to apply the Article 5 prohibition test: is this system being used in a workplace or educational institution? If the venue is a retail store or hotel, the Article 5 workplace prohibition does not apply to guests. However, the manipulation prohibition under Article 5(1)(a) may apply if the system uses the inferred sentiment to serve manipulative content — for example, targeting a 'frustrated' guest with an urgency-based offer. The second step is to assess whether the system falls under Annex III as an emotion recognition system, which would make it high-risk. The third step is to request the vendor's written AI Act classification and legal analysis. If the vendor cannot provide a defensible classification, do not activate the feature. Document your assessment rationale regardless of the outcome.

Q2. A stadium operator running a 60,000-capacity venue uses Purple's Guest WiFi platform to collect first-party data at events. The marketing team wants to deploy an AI chatbot on the captive portal to answer fan queries about facilities, merchandise, and upcoming events. The chatbot is powered by a third-party LLM API. The venue's legal team asks: what are the Article 50 obligations, who is responsible for compliance, and what does the implementation look like in practice?

💡 Astuce :Identify the deployer, the provider, and the applicable Article 50 scenario. Then specify what the disclosure must look like and when it must appear.

Afficher l'approche recommandée

The stadium operator is the deployer; the LLM API provider is the provider. Under Article 50(1), the deployer is responsible for ensuring that guests are informed they are interacting with an AI system before the interaction begins. The implementation requires a clear disclosure on the captive portal UI — a badge or introductory message such as 'You are chatting with an AI assistant' — displayed before the first message is sent. This is a front-end change to the captive portal template. The disclosure must be explicit and upfront; it cannot be buried in the terms of service. The LLM provider has their own obligations as a provider (technical documentation, instructions for use), but the deployer cannot rely on the provider to satisfy the deployer's transparency obligations. Additionally, the stadium operator must ensure the chatbot's data processing complies with GDPR — the lawful basis for processing any personal data shared in the conversation must be established, and the privacy notice must reflect the AI-driven processing.

Q3. A retail chain's WiFi analytics platform has been building individual guest profiles for two years, combining WiFi session data (device MAC address, dwell time, visit frequency, location within store) with CRM data (purchase history, loyalty programme tier) to feed an AI model that makes automated decisions about which promotional offers to serve each guest at the captive portal. The chain's new compliance lead has been asked to assess whether this system is high-risk under the EU AI Act's Annex III individual profiling provision. What is the assessment methodology and likely outcome?

💡 Astuce :Apply the Annex III individual profiling test: is the AI system performing automated processing of personal data to assess aspects of a person's preferences, interests, behaviour, or location? Then consider whether the automated decisions are significant enough to trigger the high-risk classification.

Afficher l'approche recommandée

The assessment methodology follows three steps. First, confirm that the system is an AI system (not a simple rules-based engine) — if the promotional decision is made by a machine learning model rather than a deterministic rules engine, it is an AI system. Second, apply the Annex III individual profiling test: the system is processing personal data (WiFi session data, CRM data) to assess individual preferences, interests, behaviour, and location. This meets the definition of individual profiling. Third, assess whether the system is listed under Annex III use cases — the most relevant category is 'access to and enjoyment of essential public and private services', which includes AI systems used to evaluate eligibility for services. Whether promotional offer decisions constitute 'access to services' is a grey area; if the AI system can deny a guest access to a promotional offer that materially affects their purchasing decision, regulators may take the view that this is significant. The likely outcome is that the system should be treated as potentially high-risk and a formal assessment conducted. The chain should engage the platform vendor to obtain their AI Act classification, initiate a DPIA/AI risk assessment, and begin planning for conformity assessment compliance ahead of the August 2026 deadline.