EU AI Act e Guest WiFi: O Que os Profissionais de Marketing Precisam de Saber

O EU AI Act (Regulamento 2024/1689) introduz um quadro baseado no risco que afeta diretamente a forma como os operadores de espaços implementam marketing WiFi impulsionado por IA, captive portals e análises de convidados. Este guia mapeia os quatro níveis de risco do Act contra casos de uso reais de Guest WiFi, identifica práticas proibidas, incluindo inferência de emoções e pontuação social, e fornece passos práticos de conformidade para equipas de TI e diretores de marketing que operam em ambientes de hotelaria, retalho, eventos e setor público. Compreender onde a sua implementação se enquadra no espectro de risco — e implementar as obrigações de transparência do Artigo 50 para chatbots de IA e portais conversacionais — já não é opcional: a aplicação das práticas proibidas começou em fevereiro de 2025.

🎧 Ouça este Guia

Ver Transcrição

- Resumo Executivo

- Análise Técnica Detalhada

- O Quadro de Risco de Quatro Níveis

- Práticas Proibidas ao Abrigo do Artigo 5

- Sistemas de Alto Risco ao Abrigo do Anexo III

- Artigo 50 Obrigações de Transparência — A Prioridade Imediata

- O AI Act e o GDPR: Um Quadro de Conformidade Empilhado

- Guia de Implementação

- Passo 1: Construa o Seu Inventário de AI

- Passo 2: Classifique Cada Sistema em Relação aos Níveis de Risco

- Passo 3: Implemente as Divulgações do Artigo 50

- Passo 4: Rever Acordos de Subprocessadores de Fornecedores

- Passo 5: Alinhar com a Governança do GDPR

- Passo 6: Planear a Conformidade de Sistemas de Alto Risco (Prazo: Agosto de 2026)

- Melhores Práticas

- Resolução de Problemas e Mitigação de Riscos

- ROI e Impacto no Negócio

- Ouvir: Podcast EU AI Act e WiFi para Convidados

Resumo Executivo

O EU AI Act (Regulamento 2024/1689) é o primeiro quadro legal abrangente do mundo para a inteligência artificial, e aplica-se diretamente à forma como os operadores de espaços implementam a IA na infraestrutura de Guest WiFi . O Act classifica os sistemas de IA em quatro níveis de risco — Proibido, Alto Risco, Risco Limitado e Risco Mínimo — e atribui as obrigações de conformidade em conformidade. Para a maioria dos operadores de hotelaria e retalho , o impacto operacional imediato recai em duas áreas: primeiro, garantir que qualquer interface conversacional impulsionada por IA num captive portal inclua uma divulgação clara de transparência do Artigo 50; e segundo, auditar as plataformas de marketing existentes para confirmar que não utilizam práticas proibidas, como inferência de emoções, pontuação social ou categorização biométrica baseada em atributos sensíveis.

As disposições sobre práticas proibidas ao abrigo do Artigo 5 tornaram-se aplicáveis em fevereiro de 2025. As obrigações para sistemas de alto risco ao abrigo do Anexo III aplicam-se a partir de agosto de 2026. As multas por violações de práticas proibidas podem atingir até 35 milhões de euros ou 7% do volume de negócios anual global. Este guia fornece uma referência técnica para gestores de TI, arquitetos de rede e responsáveis pela conformidade que precisam de avaliar as suas implementações atuais e implementar as alterações necessárias neste trimestre.

Análise Técnica Detalhada

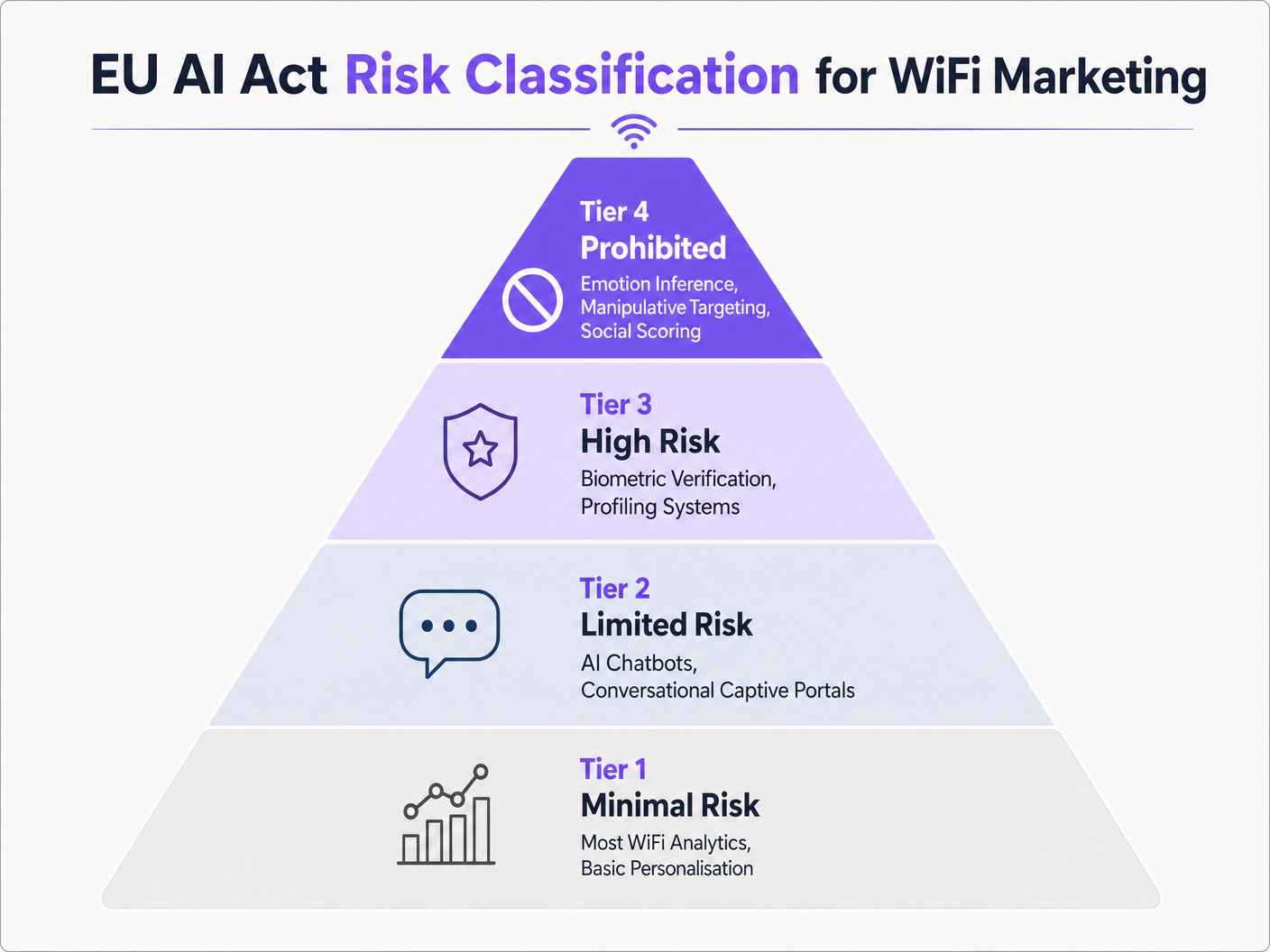

O Quadro de Risco de Quatro Níveis

O EU AI Act classifica os sistemas de IA pelo risco que representam para os direitos fundamentais, segurança e valores democráticos. A classificação determina as obrigações de conformidade que se aplicam tanto ao fornecedor (o desenvolvedor ou vendedor do sistema de IA) quanto ao implementador (a organização que coloca o sistema em serviço — tipicamente o operador do espaço ou a equipa de TI).

Os quatro níveis, mapeados para os contextos de Guest WiFi e marketing de espaços, são os seguintes:

| Nível de Risco | Referência do AI Act | Exemplos de Marketing WiFi | Obrigação de Conformidade |

|---|---|---|---|

| Proibido | Artigo 5 | Inferência de emoções em interações de portal; pontuação social de convidados; categorização biométrica por raça/religião | Cessação imediata; nenhuma implementação permitida |

| Alto Risco | Anexo III | Verificação biométrica em captive portal; perfil de IA para acesso a serviços essenciais | Avaliação de conformidade, documentação técnica, sistema de gestão de risco, registo na base de dados da UE |

| Risco Limitado | Artigo 50 | Chatbots de IA em captive portals; páginas de splash de IA generativa; sistemas de reconhecimento de emoções (contextos não proibidos) | Divulgação de transparência aos utilizadores finais antes/durante a interação |

| Risco Mínimo | Nenhuma obrigação específica | Análise agregada de fluxo de pessoas; mapas de calor de tempo de permanência; personalização baseada em regras; IA de otimização de largura de banda | Nenhuma obrigação específica do AI Act (o GDPR ainda se aplica) |

Práticas Proibidas ao Abrigo do Artigo 5

O Artigo 5 do AI Act define oito categorias de práticas de IA proibidas. Três são diretamente relevantes para as implementações de marketing WiFi em espaços.

Técnicas Manipuladoras e Enganosas. O Act proíbe sistemas de IA que utilizam técnicas subliminares, manipuladoras ou enganosas para distorcer o comportamento de uma pessoa e prejudicar a sua capacidade de tomar uma decisão informada, quando isso causa ou é provável que cause danos significativos. Num contexto de marketing WiFi, isto visa sistemas que exploram sinais comportamentais capturados no captive portal — hesitação de clique, padrões de rolagem, tempo na página — para inferir vulnerabilidades psicológicas e apresentar ofertas manipuladoras. O limiar chave é dano significativo; os reguladores avaliarão isto contextualmente, mas o princípio é claro: o "nudging" impulsionado por IA que contorna a agência racional está fora do âmbito.

Pontuação Social. O Act proíbe sistemas de IA que avaliam ou classificam indivíduos com base no seu comportamento social ou características pessoais, quando isso leva a um tratamento prejudicial ou desfavorável. Um sistema de fidelidade WiFi que utiliza um modelo de IA para pontuar convidados com base em padrões comportamentais — frequência de visitas, tempo de permanência, sinais de compra — e depois restringe a velocidade de acesso ou retém ofertas de convidados com pontuação mais baixa, estaria abrangido por esta proibição. A distinção entre personalização permitida e pontuação social proibida reside em saber se a classificação de IA produz tratamento prejudicial: servir uma oferta melhor a um convidado premium é personalização; negar a um convidado com pontuação mais baixa o acesso a serviços é pontuação social.

Categorização Biométrica de Atributos Sensíveis. O Act proíbe sistemas de IA que utilizam dados biométricos para inferir atributos sensíveis, incluindo raça, opinião política, filiação sindical, crenças religiosas ou filosóficas, vida sexual ou orientação sexual. Isto é particularmente relevante para espaços que utilizam análises baseadas em câmaras juntamente com dados WiFi. Se um sistema de IA cruzar dados de endereço MAC de dispositivos com análises visuais para inferir etnia e personalizar o conteúdo em conformidade, isso é uma violação direta do Artigo 5. A proibição aplica-se independentemente de os dados biométricos serem processados em tempo real ou em lote.

Inferência de Emoções — Esclarecimento do Âmbito. O Act proíbe a inferência de emoções em locais de trabalho e instituições de ensino. Esta proibição não se estende automaticamente a espaços de retalho, hotéis ou estádios em relação aos convidados. No entanto, se o seu espaço for também um local de trabalho — um campus corporativo, um espaço de co-working, um hospital — e estiver a utilizar a inferência de emoções em funcionários ligados ao guest WiFi, isso é proibido. Os operadores de espaços devem mapear cuidadosamente as suas populações de utilizadores antes de assumirem que a proibição de inferência de emoções não se aplica.

Sistemas de Alto Risco ao Abrigo do Anexo III

O Anexo III do Act lista casos de uso que são classificados como de alto risco. Para implementações de Guest WiFi, duas categorias são diretamente relevantes.

Primeiro, sistemas biométricos: sistemas de identificação biométrica remota (excluindo a verificação biométrica simples que confirma que uma pessoa é quem afirma ser) e sistemas de categorização biométrica que inferem atributos sensíveis ou protegidos são de alto risco. Se o seu Captive Portal utiliza reconhecimento facial para autenticar hóspedes que regressam, esse sistema requer uma avaliação de conformidade completa, documentação técnica, um sistema de gestão de risco ao longo do ciclo de vida do sistema e registo na base de dados do EU AI Act.

Segundo, criação de perfis individuais: qualquer sistema de AI listado no Anexo III é sempre considerado de alto risco se criar perfis de indivíduos — definido como o processamento automatizado de dados pessoais para avaliar aspetos da vida de uma pessoa, incluindo preferências, interesses, comportamento e localização ou movimento. Esta é a disposição mais provável de abranger plataformas de WiFi Analytics que constroem perfis individuais persistentes que alimentam decisões de marketing automatizadas. A questão chave é se o sistema de AI toma ou influencia substancialmente decisões automatizadas sobre hóspedes individuais com base nas suas características perfiladas.

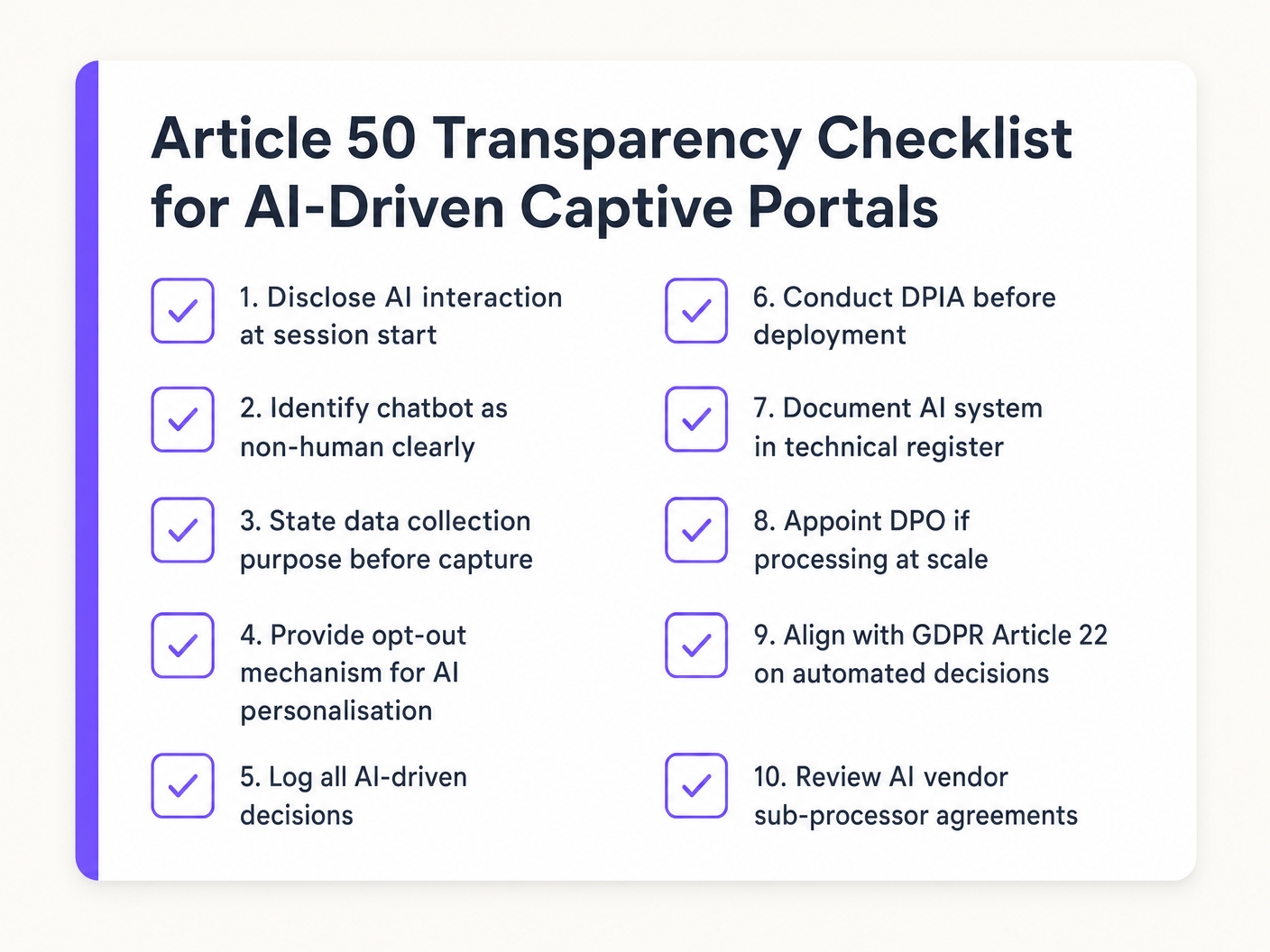

Artigo 50 Obrigações de Transparência — A Prioridade Imediata

Para a maioria dos operadores de espaços hoje, o Artigo 50 é a disposição mais relevante operacionalmente. Abrange três cenários:

Sistemas de AI conversacionais (Artigo 50(1)): Os fornecedores devem garantir que os sistemas de AI destinados a interagir com pessoas singulares são concebidos de forma a que essas pessoas sejam informadas de que estão a interagir com um sistema de AI, a menos que isso seja óbvio pelo contexto. Os implementadores devem garantir que esta divulgação está em vigor. Isto aplica-se a qualquer AI chatbot implementado num Captive Portal — seja para serviços de hóspedes, assistência no check-in do hotel, navegação no local ou questões de marketing.

Reconhecimento de emoções e categorização biométrica (Artigo 50(3)): Os implementadores de sistemas de reconhecimento de emoções ou sistemas de categorização biométrica devem informar as pessoas singulares expostas a esses sistemas. Esta é uma obrigação separada da divulgação do chatbot e aplica-se mesmo quando o sistema não é proibido.

Conteúdo sintético (Artigo 50(4)): Os sistemas de AI que geram conteúdo sintético de áudio, imagem, vídeo ou texto devem marcar esse conteúdo como gerado por AI. Se o seu Captive Portal utiliza AI generativa para produzir mensagens de boas-vindas personalizadas ou texto promocional, esse conteúdo deve ser rotulado.

O AI Act e o GDPR: Um Quadro de Conformidade Empilhado

O AI Act não substitui o GDPR; opera em paralelo. Para os operadores de espaços, isto significa que as obrigações de conformidade de ambos os quadros se aplicam simultaneamente às implementações de marketing WiFi impulsionadas por AI.

Sob o GDPR, as disposições relevantes para o marketing WiFi impulsionado por AI incluem: Artigo 6 (base legal para o processamento), Artigo 9 (dados de categoria especial — relevante se dados biométricos forem processados), Artigo 13/14 (obrigações de transparência em avisos de privacidade), Artigo 22 (restrições à tomada de decisões individuais automatizadas) e Artigo 35 (Avaliação de Impacto sobre a Proteção de Dados para processamento de alto risco).

O AI Act adiciona: Artigo 5 (conformidade com práticas proibidas), Artigo 50 (divulgações de transparência no ponto de interação com a AI) e — para sistemas de alto risco — Artigos 8–17 (gestão de risco, documentação técnica, avaliação de conformidade, registo).

Onde o GDPR exige uma DPIA para o processamento de dados de alto risco, o AI Act exige um sistema de gestão de risco para sistemas de AI de alto risco. Estes podem e devem ser alinhados: uma única avaliação integrada que abranja tanto os riscos de processamento de dados (GDPR) quanto os riscos do sistema de AI (AI Act) é mais eficiente e demonstra uma postura de governação madura aos reguladores.

O Artigo 22 do GDPR é particularmente relevante para Captive Portals impulsionados por AI. Restringe a tomada de decisões exclusivamente automatizadas que produzem efeitos legais ou efeitos significativos semelhantes sobre os indivíduos. Se o seu sistema de AI toma decisões automatizadas sobre níveis de acesso WiFi, elegibilidade promocional ou qualidade de serviço sem supervisão humana, precisa de avaliar se o Artigo 22 se aplica e se deve fornecer aos hóspedes o direito de solicitar uma revisão humana.

Guia de Implementação

Passo 1: Construa o Seu Inventário de AI

Antes de poder avaliar a conformidade, precisa de uma imagem completa de cada sistema de AI na sua pilha de marketing WiFi. Isto significa ir além das suas próprias implementações para incluir componentes de AI incorporados em plataformas de terceiros — ferramentas de automação de marketing, dashboards de análise, fornecedores de Captive Portal e integrações de CRM.

Para cada sistema, documente: a função do sistema; os dados que processa; o fornecedor e quaisquer sub-processadores; o nível de risco sob o AI Act; e as obrigações de conformidade aplicáveis. Este inventário é a base da sua postura de conformidade com o AI Act e será exigido se os reguladores solicitarem provas de devida diligência.

Passo 2: Classifique Cada Sistema em Relação aos Níveis de Risco

Aplique o quadro de quatro níveis a cada sistema no seu inventário. As questões de classificação são:

- O sistema utiliza alguma prática listada no Artigo 5? Se sim, é proibido — cesse a implementação.

- O sistema é utilizado para verificação biométrica, criação de perfis individuais para acesso a serviços, ou qualquer outro caso de uso do Anexo III? Se sim, é de alto risco — inicie o planeamento da avaliação de conformidade.

- O sistema interage com pessoas singulares de forma conversacional, gera conteúdo sintético ou realiza reconhecimento de emoções? Se sim, é de risco limitado — implemente as divulgações do Artigo 50.

- Nenhuma das anteriores? É de risco mínimo — sem obrigações específicas do AI Act, mas a conformidade com o GDPR permanece obrigatória.

Passo 3: Implemente as Divulgações do Artigo 50

Para qualquer AI chatbot ou interface conversacional no seu Captive Portal, implemente uma divulgação clara antes de ta interação começa. A divulgação deve ser explícita — não implícita, não oculta nos termos e condições. Um elemento de UI simples que declare "Está a conversar com um assistente de IA" no início da sessão satisfaz a obrigação. Esta é uma alteração de front-end, não uma reconstrução do sistema, e deve ser implementável num único sprint.

Para sistemas de reconhecimento de emoções a operar no seu espaço (onde não proibido), adicione um aviso visível na área de operação informando os convidados de que um sistema de reconhecimento de emoções está em uso.

Passo 4: Rever Acordos de Subprocessadores de Fornecedores

Como implementador, partilha a responsabilidade por práticas proibidas utilizadas pelos seus fornecedores. Reveja os seus contratos com fornecedores de plataformas de marketing WiFi, fornecedores de análises e fornecedores de captive portal. Solicite confirmação explícita da sua classificação ao abrigo do AI Act e da documentação de conformidade. Adicione disposições contratuais que exijam que os fornecedores o notifiquem de quaisquer alterações aos seus sistemas de IA que possam afetar a classificação de risco.

Passo 5: Alinhar com a Governança do GDPR

Integre o seu Encarregado de Proteção de Dados no processo de conformidade com o AI Act. Atualize o seu Registo de Atividades de Processamento para incluir as classificações dos sistemas de IA. Onde uma DPIA é exigida ao abrigo do GDPR para o processamento de dados de alto risco, estenda-a para cobrir os requisitos de gestão de risco do AI Act. Garanta que os seus avisos de privacidade são atualizados para refletir o processamento impulsionado pela IA e as divulgações do Artigo 50.

Passo 6: Planear a Conformidade de Sistemas de Alto Risco (Prazo: Agosto de 2026)

Se algum dos seus sistemas for classificado como de alto risco, inicie o processo de avaliação de conformidade agora. O prazo de agosto de 2026 para os sistemas do Anexo III está mais próximo do que parece quando se considera o tempo necessário para a documentação técnica, a implementação do sistema de gestão de risco e o registo na base de dados da UE. Envolva os seus fornecedores precocemente para entender que documentação podem fornecer e o que precisa de produzir como implementador.

Melhores Práticas

Adote uma abordagem de Privacidade por Design na implementação de IA. Os requisitos do AI Act para sistemas de alto risco — gestão de risco ao longo do ciclo de vida, governança de dados, documentação técnica — são cumpridos de forma mais eficiente quando incorporados na arquitetura do sistema desde o início, em vez de serem adaptados posteriormente. Ao avaliar novas ferramentas de marketing impulsionadas por IA, inclua os requisitos de conformidade com o AI Act nos seus critérios de aquisição, juntamente com a conformidade com o GDPR e padrões de segurança como ISO 27001 e PCI DSS.

Prefira dados primários, baseados em consentimento, em vez de atributos inferidos. As práticas proibidas e as classificações de alto risco do AI Act visam principalmente sistemas de IA que inferem características sensíveis ou tomam decisões automatizadas significativas sobre indivíduos. Sistemas que utilizam dados primários explicitamente consentidos — endereços de e-mail, preferências declaradas, adesão a programas de fidelidade — para impulsionar a personalização apresentam um risco regulatório significativamente menor do que sistemas que inferem características a partir de sinais comportamentais.

Mantenha uma separação entre a IA de operações de rede e a IA de marketing. Sistemas de IA utilizados para gestão de rede — alocação de largura de banda, mitigação de interferências, balanceamento de carga — são de risco mínimo ao abrigo do AI Act. Sistemas de IA utilizados para criação de perfis de convidados e personalização de marketing acarretam maior risco. Manter estes arquitetonicamente separados simplifica a sua classificação de risco e limita o impacto de qualquer problema de conformidade na pilha de marketing.

Consulte IEEE 802.1X e WPA3 para a arquitetura de autenticação. Onde a verificação biométrica é utilizada no captive portal, garanta que a arquitetura de autenticação subjacente cumpre os padrões atuais. IEEE 802.1X fornece controlo de acesso à rede baseado em porta com autenticação forte, e WPA3 fornece encriptação melhorada para a camada sem fios. Estes padrões são neutros em relação ao fornecedor e são referenciados tanto em frameworks de segurança empresarial como nas orientações do GDPR sobre medidas técnicas apropriadas.

Documente as suas decisões de conformidade com o AI Act. Mesmo para sistemas de risco mínimo, documentar a sua lógica de classificação demonstra a devida diligência aos reguladores. O AI Act exige que os fornecedores de sistemas de alto risco documentem a sua avaliação antes de colocar o sistema no mercado; como implementador, manter documentação equivalente para as suas próprias avaliações de risco é uma boa prática.

Resolução de Problemas e Mitigação de Riscos

Risco: As práticas de IA do fornecedor são opacas. Muitas plataformas de automação de marketing e de análise de WiFi incorporam capacidades de IA que não estão claramente documentadas. Mitigação: Emita um questionário formal de conformidade com o AI Act a todos os fornecedores. Solicite a classificação do seu sistema, documentação técnica e evidência de prevenção de práticas proibidas. Inclua a conformidade com o AI Act como um requisito contratual em acordos novos e renovados.

Risco: O chatbot do captive portal não possui a divulgação do Artigo 50. Esta é a lacuna de conformidade mais comum identificada nas implementações atuais. Mitigação: Audite a UI do seu captive portal. Se qualquer interface de IA conversacional não tiver uma divulgação clara pré-interação, este é um item de remediação prioritário. A correção é uma alteração de UI implementável em dias.

Risco: A plataforma de análise cria perfis individuais que desencadeiam a classificação de alto risco. Se a sua plataforma WiFi Analytics criar perfis individuais persistentes que alimentam decisões de marketing automatizadas, poderá estar a operar um sistema de alto risco sem a avaliação de conformidade exigida. Mitigação: Reveja o modelo de dados da plataforma. Se perfis individuais estiverem a ser criados e utilizados para decisões automatizadas, contacte o seu fornecedor sobre a sua classificação ao abrigo do AI Act e inicie um processo de avaliação de conformidade.

Risco: A conformidade com o GDPR e o AI Act é tratada como fluxos de trabalho separados. Organizações que gerem a conformidade com o GDPR e o AI Act em equipas separadas correm o risco de duplicação, lacunas e documentação inconsistente. Mitigação: Estabeleça uma estrutura unificada de governança de IA que aborde ambos os frameworks regulatórios. Um único processo integrado de DPIA/avaliação de risco de IA é mais eficiente e mais defensável.

Risco: Classificação incorreta do âmbito da inferência de emoções. A proibição da inferência de emoções aplica-se em locais de trabalho e instituições de ensino. Locais que são também locais de trabalho — campus empresariais, hospitais, espaços de co-working — devem aplicar a proibição a sistemas direcionados a funcionários, e não apenas a sistemas direcionados a convidados. Mitigação: Mapeie as suas populações de utilizadores e aplique a proibição a todos os contextos onde os funcionários possam estar sujeitos à inferência de emoções.

ROI e Impacto no Negócio

A conformidade com o EU AI Act não é puramente um centro de custos. As organizações que constroem estruturas de governação de AI antes da curva de aplicação da lei obtêm vantagens competitivas mensuráveis.

Risco regulatório reduzido. As multas por violações de práticas proibidas — até 35 milhões de euros ou 7% do volume de negócios anual global — representam um risco financeiro material para qualquer organização que opere em larga escala nos estados membros da UE. Uma postura de conformidade proativa elimina esta exposição.

Diferenciação de fornecedores. À medida que a conformidade com o AI Act se torna um requisito de aquisição, as plataformas que podem demonstrar uma classificação de risco clara, práticas de AI transparentes e interfaces em conformidade com o Artigo 50 serão preferidas em relação às que não podem. Para operadores de hotelaria e retalho que avaliam plataformas de marketing WiFi, a documentação de conformidade com o AI Act está a tornar-se um requisito padrão de RFP.

Confiança do convidado e qualidade dos dados primários. As obrigações de transparência ao abrigo do Artigo 50 — quando bem implementadas — aumentam a confiança do convidado. Os convidados que compreendem como a AI está a ser utilizada na sua interação são mais propensos a interagir de forma autêntica e a fornecer dados primários de maior qualidade. Isto melhora diretamente a precisão dos modelos de personalização e o ROI das campanhas de marketing.

Eficiência operacional através de uma governação unificada. As organizações que alinham as suas estruturas de conformidade com o GDPR e o AI Act numa única estrutura de governação reduzem a duplicação de esforços entre as equipas jurídica, de TI e de marketing. O investimento na construção desta estrutura compensa à medida que o panorama regulatório continua a evoluir — o AI Act será seguido por mais regulamentação específica de AI, e uma postura de governação madura proporciona uma base duradoura.

Para operadores de transportes e organizações do setor público, a conformidade com o AI Act é particularmente importante dada a maior escrutínio dos sistemas de AI em espaços publicamente acessíveis. A conformidade proativa demonstra responsabilidade tanto para os reguladores quanto para o público, apoiando objetivos mais amplos de confiança digital.

Para leitura adicional sobre estruturas de conformidade relacionadas, consulte o nosso guia sobre Conformidade com a PIPEDA para WiFi de Convidados no Canadá , que abrange requisitos análogos de consentimento e transparência no contexto canadiano.

Ouvir: Podcast EU AI Act e WiFi para Convidados

Termos-Chave e Definições

Provider (EU AI Act)

A natural or legal person, public authority, agency, or other body that develops an AI system or general-purpose AI model, or that has an AI system or general-purpose AI model developed, with a view to placing it on the market or putting it into service under its own name or trademark, whether for payment or free of charge.

In a Guest WiFi context, the provider is typically the WiFi marketing platform vendor or the developer of the AI personalisation engine. Providers of high-risk systems carry the heaviest compliance obligations under the Act.

Deployer (EU AI Act)

A natural or legal person, public authority, agency, or other body that uses an AI system under its own authority, except where the AI system is used in the course of a personal non-professional activity.

The venue operator — hotel group, retail chain, stadium operator — is the deployer. Deployers are responsible for Article 50 transparency disclosures and for ensuring that the AI systems they use comply with the Act's requirements, even when those systems are provided by third parties.

Biometric Categorisation System

An AI system for the purpose of assigning natural persons to specific categories on the basis of their biometric data, such as face, movement, gait, posture, voice, appearance, behaviour, or other physiological or behavioural human characteristics or traits.

Relevant for venue operators using camera-based analytics or device fingerprinting in combination with AI. Systems that infer sensitive attributes (race, religion, political opinion) from biometric data are prohibited under Article 5. Systems that perform biometric categorisation without inferring sensitive attributes may be high-risk under Annex III.

Emotion Recognition System

An AI system for the purpose of identifying or inferring emotions or intentions of natural persons on the basis of their biometric data.

Prohibited in workplaces and educational institutions under Article 5. In other venue contexts (retail, hospitality), emotion recognition systems are regulated under Annex III as high-risk and require deployers to inform affected persons under Article 50(3). Vendors marketing 'mood-based' or 'engagement state' features should be assessed against this definition.

Individual Profiling

Any form of automated processing of personal data consisting of the use of personal data to evaluate certain personal aspects relating to a natural person, in particular to analyse or predict aspects concerning that natural person's performance, economic situation, health, personal preferences, interests, reliability, behaviour, location or movements.

AI systems listed under Annex III are always considered high-risk if they profile individuals. WiFi analytics platforms that build persistent individual profiles feeding into automated marketing decisions must be assessed against this definition to determine whether they are high-risk systems.

Social Scoring

The evaluation or classification of natural persons or groups of persons over a period of time based on their social behaviour or known, inferred, or predicted personal or personality characteristics, with a social score leading to detrimental or unfavourable treatment of those persons or groups in social contexts that are unrelated to the contexts in which the data was originally generated or collected.

Prohibited under Article 5. In a WiFi marketing context, this targets AI systems that score guests on behavioural patterns and use those scores to restrict access, withhold offers, or provide inferior service. The key element is detrimental treatment — personalisation that improves the experience for high-value guests is not social scoring unless it simultaneously disadvantages lower-scoring guests.

Captive Portal

A web page or authentication gateway presented to newly connected users of a WiFi network before they are granted broader access to the internet. Used by venue operators to collect guest data, present terms of service, and deliver marketing content.

The primary deployment surface for AI-driven WiFi marketing. AI features on captive portals — chatbots, personalised splash pages, recommendation engines — are subject to Article 50 transparency obligations. The captive portal is also the point at which GDPR consent for data processing is typically obtained.

Conformity Assessment

The process of verifying whether a high-risk AI system complies with the requirements set out in the EU AI Act, including risk management, data governance, technical documentation, transparency, human oversight, accuracy, robustness, and cybersecurity.

Required for high-risk AI systems before they are placed on the market or put into service. For most high-risk systems under Annex III, providers can conduct a self-assessment. For biometric identification systems, third-party assessment is required. Venue operators deploying high-risk AI systems need to ensure their vendors have completed the required conformity assessment and can provide the documentation.

DPIA (Data Protection Impact Assessment)

A process required under GDPR Article 35 for processing operations that are likely to result in a high risk to the rights and freedoms of natural persons. The DPIA must describe the processing, assess necessity and proportionality, and identify and mitigate risks.

Required under GDPR for high-risk data processing, including large-scale profiling and systematic monitoring of publicly accessible areas. In the AI Act context, the DPIA should be extended to cover AI system risk management requirements, creating a unified assessment that satisfies both regulatory frameworks.

Article 50 Transparency Obligation

The requirement under Article 50 of the EU AI Act that providers ensure AI systems intended to interact with natural persons are designed so that those persons are informed they are interacting with an AI system, unless this is obvious from the context. Deployers must ensure this disclosure is in place.

The most immediately actionable compliance obligation for venue operators with AI chatbots or conversational interfaces on their captive portals. The disclosure must be clear and upfront — before the interaction begins — not buried in terms and conditions. Applies to all AI conversational systems regardless of risk tier.

Estudos de Caso

A 450-room hotel group operating across five EU member states has deployed an AI-driven chatbot on its captive portal to handle guest check-in queries, restaurant recommendations, and WiFi troubleshooting. The chatbot is powered by a third-party LLM platform. The marketing team also uses a WiFi analytics platform that builds individual guest profiles — including visit history, dwell time by venue area, and inferred demographic segments — to serve personalised promotional offers via the captive portal splash page. The CTO needs to assess the AI Act compliance posture of both systems before the next board meeting.

Step 1 — Classify the chatbot. The AI-driven chatbot is a conversational AI system interacting with natural persons. It falls under Article 50(1) as a Limited Risk system. The immediate action is to implement a clear pre-interaction disclosure on the captive portal UI: 'You are chatting with an AI assistant.' This is a front-end change. The hotel group, as the deployer, is responsible for this disclosure even though the underlying LLM is provided by a third party. Review the vendor contract to confirm the provider's AI Act classification and request their technical documentation.

Step 2 — Classify the analytics platform. The WiFi analytics platform builds individual guest profiles and uses them to serve personalised offers via automated decisions. The key question is whether this constitutes individual profiling under Annex III — automated processing of personal data to assess preferences, interests, behaviour, and location. If yes, the system is high-risk. Request the vendor's AI Act classification documentation. If the vendor classifies the system as minimal risk, obtain their written rationale and assess whether it is defensible. If the system is high-risk, begin planning for conformity assessment compliance ahead of the August 2026 deadline.

Step 3 — Audit the inferred demographic segments. If the analytics platform infers demographic segments that include sensitive attributes — age bracket, gender, nationality — using AI models, assess whether this constitutes biometric categorisation of sensitive attributes under Article 5. If the segmentation is based on declared data (loyalty programme membership, explicitly provided preferences) rather than AI inference from behavioural signals, it is lower risk. If it is AI-inferred from behavioural signals, it requires careful legal review.

Step 4 — Align with GDPR. Ensure the hotel group's privacy notice reflects AI-driven processing and the Article 50 disclosures. Review the lawful basis for the analytics processing under GDPR Article 6. If the processing is based on legitimate interests, conduct a legitimate interests assessment that accounts for the AI Act risk classification. Update the DPIA to cover both GDPR and AI Act risk dimensions.

A national retail chain with 120 stores across Germany, France, and the Netherlands is evaluating a new WiFi marketing platform that includes an AI feature described by the vendor as 'mood-based personalisation' — the system analyses the speed and pattern of a guest's captive portal interactions to infer their 'engagement state' and adjusts the promotional content served on the splash page accordingly. The IT director needs to assess whether this feature is permissible under the EU AI Act.

Step 1 — Identify the AI practice. The 'mood-based personalisation' feature analyses behavioural signals (interaction speed and pattern) to infer an 'engagement state' — which is functionally an emotional or psychological state. This is emotion inference.

Step 2 — Apply the Article 5 prohibition test. Article 5 prohibits emotion inference in workplaces and educational institutions. A retail store is not a workplace for the guest, so this specific prohibition does not apply to the guest population in the retail context. However, the feature may still be prohibited under Article 5(1)(a) if it deploys manipulative techniques to distort behaviour and impair informed decision-making, causing significant harm. The use of inferred emotional state to serve manipulative promotional content — targeting a guest identified as 'frustrated' with an urgency-based offer, for example — is likely to fall within this prohibition.

Step 3 — Assess the GDPR implications. Inferring emotional state from behavioural data constitutes processing of personal data for profiling purposes under GDPR. The lawful basis for this processing must be assessed. Legitimate interests is unlikely to be a defensible basis for emotion inference used for marketing purposes. Explicit consent is the most appropriate basis, but the consent mechanism must be specific and granular — consent to WiFi access does not constitute consent to emotion inference.

Step 4 — Recommendation. Do not deploy the 'mood-based personalisation' feature without a detailed legal assessment. The risk of Article 5 violation — specifically the manipulation prohibition — is material. Request the vendor's legal analysis of the feature's AI Act classification. If the vendor cannot provide a defensible classification, treat the feature as prohibited and do not activate it. Standard behavioural personalisation based on objective metrics (visit frequency, time of day, declared preferences) is permissible and carries significantly lower regulatory risk.

Análise de Cenários

Q1. Your venue's WiFi marketing platform vendor has just released a new feature called 'Visitor Sentiment Scoring' that analyses the speed, sequence, and hesitation patterns of a guest's captive portal interactions to assign a sentiment score (positive, neutral, frustrated) and adjust the promotional content served accordingly. The vendor's documentation describes this as 'behavioural analytics' rather than 'emotion recognition'. As the IT director, how do you assess this feature's EU AI Act compliance status, and what actions do you take?

💡 Dica:Focus on the technical function of the system, not the vendor's marketing language. Ask: what is the system actually doing? Is it inferring an emotional or psychological state from behavioural signals? Then apply the Article 5 prohibition test and the Article 50 transparency test.

Mostrar Abordagem Recomendada

The feature is functionally an emotion recognition system regardless of the vendor's labelling. Analysing interaction patterns to infer 'frustration' or 'positive sentiment' is emotion inference. The first step is to apply the Article 5 prohibition test: is this system being used in a workplace or educational institution? If the venue is a retail store or hotel, the Article 5 workplace prohibition does not apply to guests. However, the manipulation prohibition under Article 5(1)(a) may apply if the system uses the inferred sentiment to serve manipulative content — for example, targeting a 'frustrated' guest with an urgency-based offer. The second step is to assess whether the system falls under Annex III as an emotion recognition system, which would make it high-risk. The third step is to request the vendor's written AI Act classification and legal analysis. If the vendor cannot provide a defensible classification, do not activate the feature. Document your assessment rationale regardless of the outcome.

Q2. A stadium operator running a 60,000-capacity venue uses Purple's Guest WiFi platform to collect first-party data at events. The marketing team wants to deploy an AI chatbot on the captive portal to answer fan queries about facilities, merchandise, and upcoming events. The chatbot is powered by a third-party LLM API. The venue's legal team asks: what are the Article 50 obligations, who is responsible for compliance, and what does the implementation look like in practice?

💡 Dica:Identify the deployer, the provider, and the applicable Article 50 scenario. Then specify what the disclosure must look like and when it must appear.

Mostrar Abordagem Recomendada

The stadium operator is the deployer; the LLM API provider is the provider. Under Article 50(1), the deployer is responsible for ensuring that guests are informed they are interacting with an AI system before the interaction begins. The implementation requires a clear disclosure on the captive portal UI — a badge or introductory message such as 'You are chatting with an AI assistant' — displayed before the first message is sent. This is a front-end change to the captive portal template. The disclosure must be explicit and upfront; it cannot be buried in the terms of service. The LLM provider has their own obligations as a provider (technical documentation, instructions for use), but the deployer cannot rely on the provider to satisfy the deployer's transparency obligations. Additionally, the stadium operator must ensure the chatbot's data processing complies with GDPR — the lawful basis for processing any personal data shared in the conversation must be established, and the privacy notice must reflect the AI-driven processing.

Q3. A retail chain's WiFi analytics platform has been building individual guest profiles for two years, combining WiFi session data (device MAC address, dwell time, visit frequency, location within store) with CRM data (purchase history, loyalty programme tier) to feed an AI model that makes automated decisions about which promotional offers to serve each guest at the captive portal. The chain's new compliance lead has been asked to assess whether this system is high-risk under the EU AI Act's Annex III individual profiling provision. What is the assessment methodology and likely outcome?

💡 Dica:Apply the Annex III individual profiling test: is the AI system performing automated processing of personal data to assess aspects of a person's preferences, interests, behaviour, or location? Then consider whether the automated decisions are significant enough to trigger the high-risk classification.

Mostrar Abordagem Recomendada

The assessment methodology follows three steps. First, confirm that the system is an AI system (not a simple rules-based engine) — if the promotional decision is made by a machine learning model rather than a deterministic rules engine, it is an AI system. Second, apply the Annex III individual profiling test: the system is processing personal data (WiFi session data, CRM data) to assess individual preferences, interests, behaviour, and location. This meets the definition of individual profiling. Third, assess whether the system is listed under Annex III use cases — the most relevant category is 'access to and enjoyment of essential public and private services', which includes AI systems used to evaluate eligibility for services. Whether promotional offer decisions constitute 'access to services' is a grey area; if the AI system can deny a guest access to a promotional offer that materially affects their purchasing decision, regulators may take the view that this is significant. The likely outcome is that the system should be treated as potentially high-risk and a formal assessment conducted. The chain should engage the platform vendor to obtain their AI Act classification, initiate a DPIA/AI risk assessment, and begin planning for conformity assessment compliance ahead of the August 2026 deadline.