EU AI Act und Guest WiFi: Was Marketingexperten wissen müssen

Der EU AI Act (Verordnung 2024/1689) führt einen risikobasierten Rahmen ein, der sich direkt darauf auswirkt, wie Betreiber von Veranstaltungsorten KI-gesteuertes WiFi-Marketing, Captive Portals und Gast-Analysen einsetzen. Dieser Leitfaden ordnet die vier Risikostufen des Gesetzes realen Guest WiFi-Anwendungsfällen zu, identifiziert verbotene Praktiken wie Emotionserkennung und Social Scoring und bietet umsetzbare Compliance-Schritte für IT-Teams und Marketingleiter, die in den Bereichen Gastgewerbe, Einzelhandel, Veranstaltungen und im öffentlichen Sektor tätig sind. Zu verstehen, wo Ihre Implementierung im Risikospektrum angesiedelt ist – und die Transparenzpflichten nach Artikel 50 für KI-Chatbots und konversationelle Portale umzusetzen – ist nicht länger optional: Die Durchsetzung verbotener Praktiken begann im Februar 2025.

🎧 Diesen Leitfaden anhören

Transkript anzeigen

- Zusammenfassung für Führungskräfte

- Technischer Einblick

- Der vierstufige Risikorahmen

- Verbotene Praktiken gemäß Artikel 5

- Hochrisikosysteme gemäß Anhang III

- Artikel 50 Transparenzpflichten – Die unmittelbare Priorität

- Der AI Act und die GDPR: Ein gestapeltes Compliance-Framework

- Implementierungsleitfaden

- Schritt 1: Erstellen Sie Ihr KI-Inventar

- Schritt 2: Klassifizieren Sie jedes System nach den Risikostufen

- Schritt 3: Implementieren Sie die Offenlegungen gemäß Artikel 50

- Schritt 4: Überprüfung der Unterauftragsverarbeiter-Vereinbarungen mit Anbietern

- Schritt 5: Abstimmung mit der GDPR Governance

- Schritt 6: Planung der Compliance für Hochrisikosysteme (Frist: August 2026)

- Best Practices

- Fehlerbehebung & Risikominderung

- ROI & Geschäftlicher Nutzen

- Anhören: EU AI Act und Guest WiFi Podcast

Zusammenfassung für Führungskräfte

Der EU AI Act (Verordnung 2024/1689) ist der weltweit erste umfassende Rechtsrahmen für künstliche Intelligenz und gilt direkt für die Art und Weise, wie Betreiber von Veranstaltungsorten KI in der Guest WiFi -Infrastruktur einsetzen. Das Gesetz klassifiziert KI-Systeme in vier Risikostufen – Verboten, Hochrisiko, Begrenztes Risiko und Minimales Risiko – und weist entsprechende Compliance-Verpflichtungen zu. Für die meisten Betreiber im Gastgewerbe und Einzelhandel fallen die unmittelbaren operativen Auswirkungen in zwei Bereiche: Erstens, die Sicherstellung, dass jede KI-gesteuerte Konversationsschnittstelle auf einem Captive Portal eine klare Transparenzoffenlegung gemäß Artikel 50 enthält; und zweitens, die Überprüfung bestehender Marketing-Stacks, um zu bestätigen, dass sie keine verbotenen Praktiken wie Emotionserkennung, Social Scoring oder biometrische Kategorisierung basierend auf sensiblen Attributen verwenden.

Die Bestimmungen zu verbotenen Praktiken gemäß Artikel 5 wurden im Februar 2025 durchsetzbar. Verpflichtungen für Hochrisikosysteme gemäß Anhang III gelten ab August 2026. Bußgelder für Verstöße gegen verbotene Praktiken können bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes betragen. Dieser Leitfaden bietet eine technische Referenz für IT-Manager, Netzwerkarchitekten und Compliance-Verantwortliche, die ihre aktuellen Implementierungen bewerten und die erforderlichen Änderungen in diesem Quartal umsetzen müssen.

Technischer Einblick

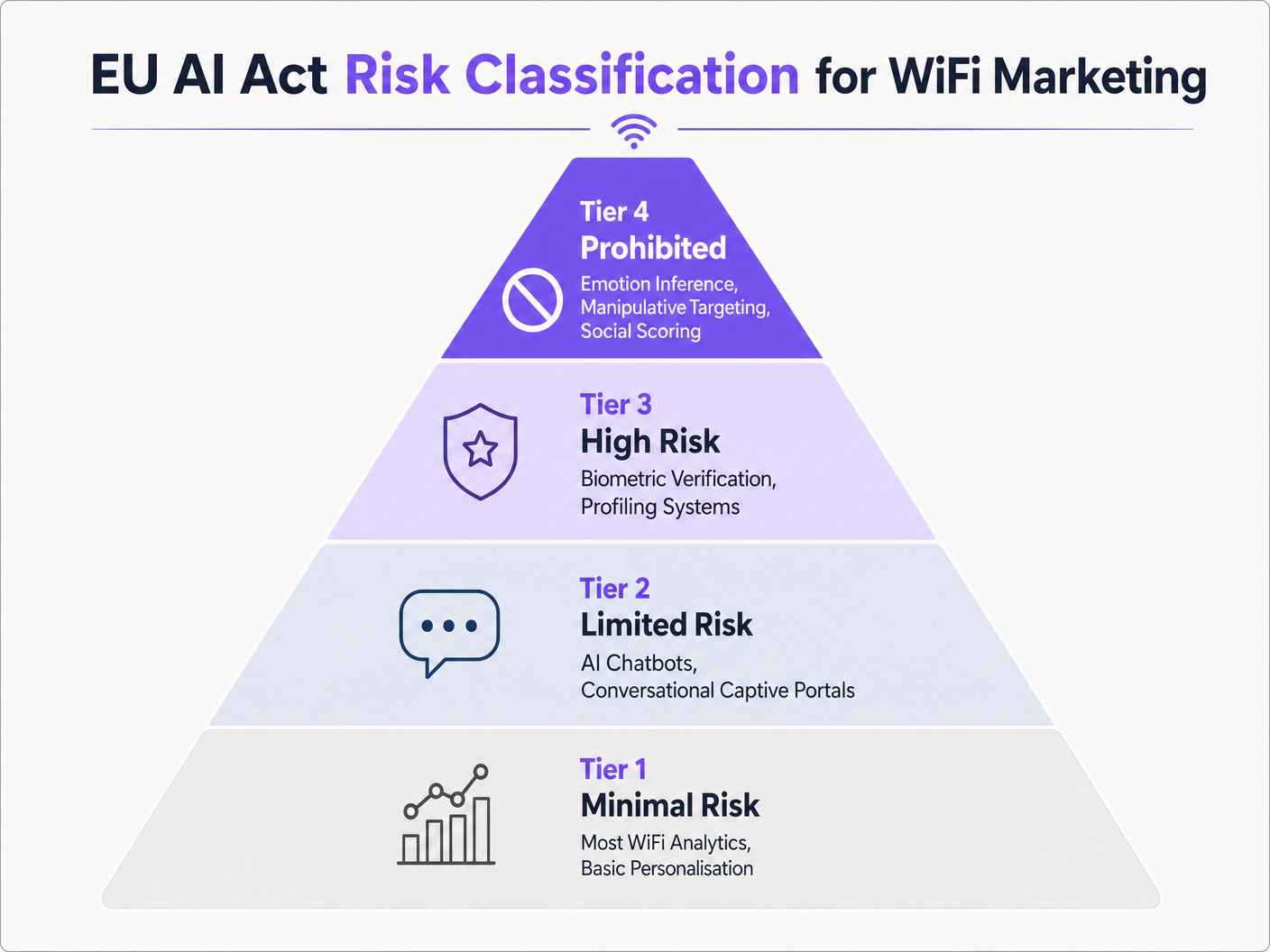

Der vierstufige Risikorahmen

Der EU AI Act klassifiziert KI-Systeme nach dem Risiko, das sie für Grundrechte, Sicherheit und demokratische Werte darstellen. Die Klassifizierung bestimmt die Compliance-Verpflichtungen, die sowohl für den Anbieter (den Entwickler oder Verkäufer des KI-Systems) als auch für den Betreiber (die Organisation, die das System in Betrieb nimmt – typischerweise der Betreiber des Veranstaltungsortes oder das IT-Team) gelten.

Die vier Stufen, zugeordnet zu Guest WiFi- und Veranstaltungsort-Marketingkontexten, sind wie folgt:

| Risikostufe | AI Act Referenz | WiFi Marketing Beispiele | Compliance-Verpflichtung |

|---|---|---|---|

| Verboten | Artikel 5 | Emotionserkennung bei Portalinteraktionen; Social Scoring von Gästen; biometrische Kategorisierung nach Rasse/Religion | Sofortige Einstellung; keine Bereitstellung erlaubt |

| Hochrisiko | Anhang III | Biometrische Verifizierung am Captive Portal; KI-Profiling für den Zugang zu wesentlichen Diensten | Konformitätsbewertung, technische Dokumentation, Risikomanagementsystem, EU-Datenbankregistrierung |

| Begrenztes Risiko | Artikel 50 | KI-Chatbots auf Captive Portals; generative KI-Splash-Pages; Emotionserkennungssysteme (nicht verbotene Kontexte) | Transparenzoffenlegung gegenüber Endnutzern vor/während der Interaktion |

| Minimales Risiko | Keine spezifische Verpflichtung | Aggregierte Besucherfrequenzanalysen; Verweildauer-Heatmaps; regelbasierte Personalisierung; Bandbreitenoptimierungs-KI | Keine AI Act-spezifischen Verpflichtungen (GDPR gilt weiterhin) |

Verbotene Praktiken gemäß Artikel 5

Artikel 5 des AI Act definiert acht Kategorien verbotener KI-Praktiken. Drei davon sind direkt relevant für WiFi-Marketing-Implementierungen an Veranstaltungsorten.

Manipulative und täuschende Techniken. Das Gesetz verbietet KI-Systeme, die unterschwellige, manipulative oder täuschende Techniken einsetzen, um das Verhalten einer Person zu verzerren und ihre Fähigkeit, eine informierte Entscheidung zu treffen, zu beeinträchtigen, wenn dies erheblichen Schaden verursacht oder wahrscheinlich verursacht. Im Kontext des WiFi-Marketings zielt dies auf Systeme ab, die Verhaltenssignale, die am Captive Portal erfasst werden – Klick-Zögern, Scroll-Muster, Verweildauer auf der Seite – nutzen, um psychologische Schwachstellen abzuleiten und manipulative Angebote zu unterbreiten. Die entscheidende Schwelle ist erheblicher Schaden; Regulierungsbehörden werden dies kontextbezogen bewerten, aber das Prinzip ist klar: KI-gesteuertes Nudging, das die rationale Entscheidungsfindung umgeht, ist ausgeschlossen.

Social Scoring. Das Gesetz verbietet KI-Systeme, die Personen aufgrund ihres sozialen Verhaltens oder ihrer persönlichen Merkmale bewerten oder klassifizieren, wenn dies zu einer nachteiligen oder ungünstigen Behandlung führt. Ein WiFi-Loyalitätssystem, das ein KI-Modell verwendet, um Gäste anhand von Verhaltensmustern – Besuchshäufigkeit, Verweildauer, Kaufsignale – zu bewerten und dann die Zugriffsgeschwindigkeit einschränkt oder Angebote für schlechter bewertete Gäste zurückhält, würde unter dieses Verbot fallen. Der Unterschied zwischen zulässiger Personalisierung und verbotenem Social Scoring liegt darin, ob die KI-Klassifizierung eine nachteilige Behandlung hervorruft: Einem Premium-Gast ein besseres Angebot zu machen, ist Personalisierung; einem schlechter bewerteten Gast den Zugang zu Diensten zu verwehren, ist Social Scoring.

Biometrische Kategorisierung sensibler Attribute. Das Gesetz verbietet KI-Systeme, die biometrische Daten verwenden, um sensible Attribute wie Rasse, politische Meinungen, Gewerkschaftszugehörigkeit, religiöse oder philosophische Überzeugungen, Sexualleben oder sexuelle Orientierung abzuleiten. Dies ist besonders relevant für Veranstaltungsorte, die kamerabasierte Analysen zusammen mit WiFi-Daten verwenden. Wenn ein KI-System MAC-Adressdaten von Geräten mit visuellen Analysen abgleicht, um die ethnische Zugehörigkeit abzuleiten und Inhalte entsprechend zu personalisieren, stellt dies einen direkten Verstoß gegen Artikel 5 dar. Das Verbot gilt unabhängig davon, ob die biometrischen Daten in Echtzeit oder im Batch verarbeitet werden.

Emotionserkennung – Klärung des Anwendungsbereichs. Das Gesetz verbietet Emotionserkennung an Arbeitsplätzen und Bildungseinrichtungen. Dieses Verbot erstreckt sich nicht automatisch auf Einzelhandelsgeschäfte, Hotels oder Stadien in Bezug auf Gäste. Wenn Ihr Veranstaltungsort jedoch auch ein Arbeitsplatz ist – ein Unternehmenscampus, ein Co-Working-Space, ein Krankenhaus – und Sie Emotionserkennung bei Mitarbeitern verwenden, die mit dem Guest WiFi verbunden sind, ist dies verboten. Betreiber von Veranstaltungsorten sollten ihre Nutzerpopulationen sorgfältig kartieren, bevor sie davon ausgehen, dass das Verbot der Emotionserkennung nicht gilt.

Hochrisikosysteme gemäß Anhang III

Anhang III des Gesetzes listet Anwendungsfälle auf, die als klassifiziert sind als hochriskant. Für Guest WiFi-Implementierungen sind zwei Kategorien direkt relevant.

Erstens, biometrische Systeme: Fern-Biometrie-Identifikationssysteme (ausgenommen einfache biometrische Verifizierung, die bestätigt, dass eine Person die ist, die sie vorgibt zu sein) und biometrische Kategorisierungssysteme, die sensible oder geschützte Attribute ableiten, sind hochriskant. Wenn Ihr Captive Portal Gesichtserkennung zur Authentifizierung wiederkehrender Gäste verwendet, erfordert dieses System eine vollständige Konformitätsbewertung, technische Dokumentation, ein Risikomanagementsystem über den gesamten Lebenszyklus des Systems und eine Registrierung in der EU AI Act-Datenbank.

Zweitens, individuelles Profiling: Jedes im Anhang III aufgeführte KI-System gilt immer als hochriskant, wenn es Personen profiliert – definiert als automatisierte Verarbeitung personenbezogener Daten zur Bewertung von Aspekten des Lebens einer Person, einschließlich Vorlieben, Interessen, Verhalten sowie Standort oder Bewegung. Dies ist die Bestimmung, die am ehesten WiFi Analytics -Plattformen erfasst, die persistente individuelle Profile erstellen, die in automatisierte Marketingentscheidungen einfließen. Die entscheidende Frage ist, ob das KI-System automatisierte Entscheidungen über einzelne Gäste auf der Grundlage ihrer profilierten Merkmale trifft oder wesentlich beeinflusst.

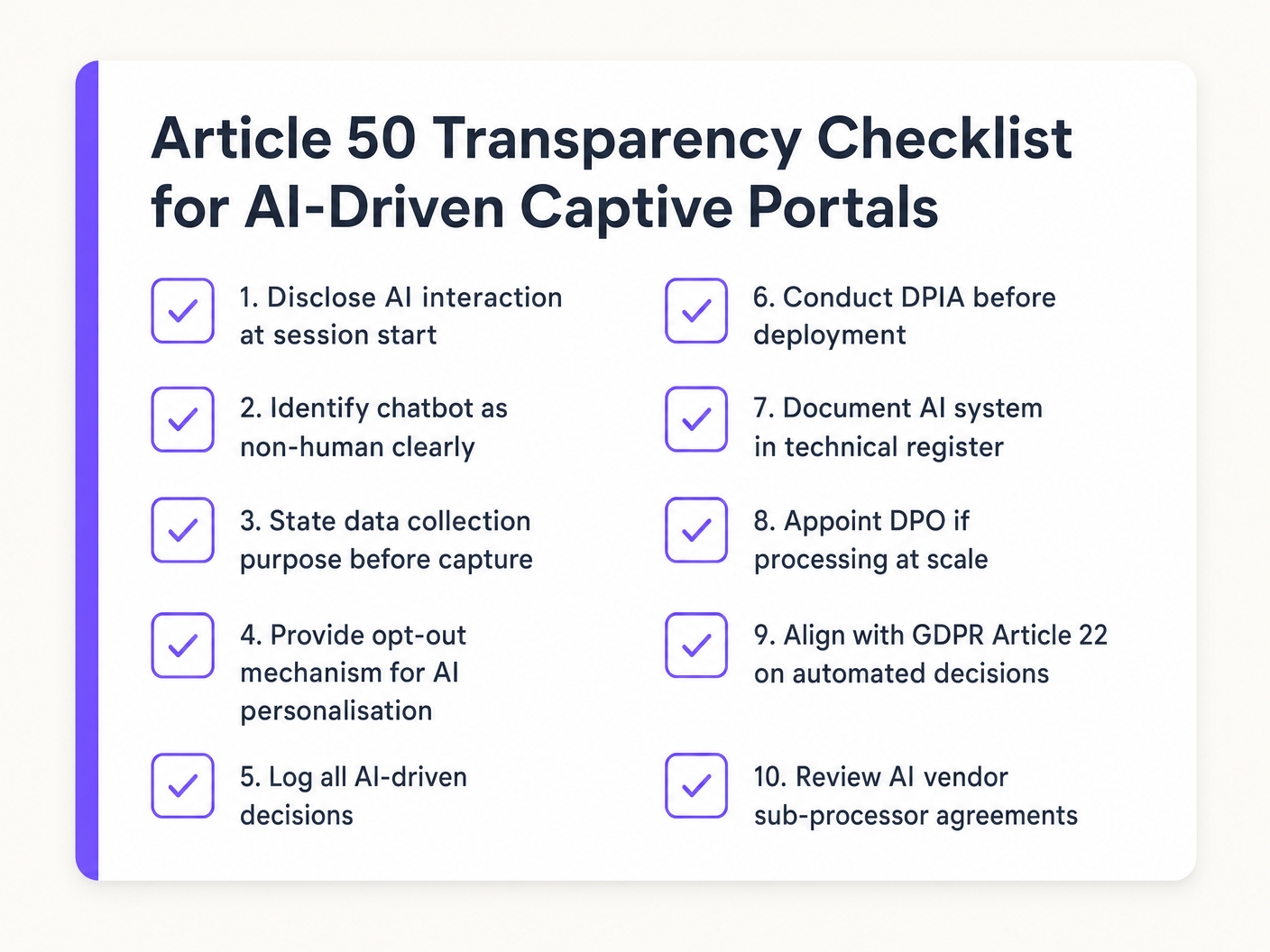

Artikel 50 Transparenzpflichten – Die unmittelbare Priorität

Für die Mehrheit der Betreiber von Veranstaltungsorten ist Artikel 50 heute die operativ relevanteste Bestimmung. Er deckt drei Szenarien ab:

Konversationelle KI-Systeme (Artikel 50(1)): Anbieter müssen sicherstellen, dass KI-Systeme, die zur Interaktion mit natürlichen Personen bestimmt sind, so gestaltet sind, dass diese Personen darüber informiert werden, dass sie mit einem KI-System interagieren, es sei denn, dies ist aus dem Kontext offensichtlich. Betreiber müssen sicherstellen, dass diese Offenlegung erfolgt. Dies gilt für jeden KI-Chatbot, der auf einem Captive Portal eingesetzt wird – sei es für Gästeservices, Hotel-Check-in-Hilfe, Veranstaltungsort-Navigation oder Marketinganfragen.

Emotionserkennung und biometrische Kategorisierung (Artikel 50(3)): Betreiber von Emotionserkennungssystemen oder biometrischen Kategorisierungssystemen müssen die natürlichen Personen, die diesen Systemen ausgesetzt sind, informieren. Dies ist eine separate Verpflichtung von der Chatbot-Offenlegung und gilt auch dann, wenn das System nicht verboten ist.

Synthetische Inhalte (Artikel 50(4)): KI-Systeme, die synthetische Audio-, Bild-, Video- oder Textinhalte generieren, müssen diese Inhalte als KI-generiert kennzeichnen. Wenn Ihr Captive Portal generative KI verwendet, um personalisierte Willkommensnachrichten oder Werbetexte zu erstellen, müssen diese Inhalte gekennzeichnet werden.

Der AI Act und die GDPR: Ein gestapeltes Compliance-Framework

Der AI Act ersetzt die GDPR nicht; er funktioniert parallel. Für Betreiber von Veranstaltungsorten bedeutet dies, dass Compliance-Verpflichtungen aus beiden Frameworks gleichzeitig für KI-gesteuerte WiFi-Marketing-Implementierungen gelten.

Unter der GDPR umfassen die relevanten Bestimmungen für KI-gesteuertes WiFi-Marketing: Artikel 6 (Rechtsgrundlage für die Verarbeitung), Artikel 9 (besondere Kategorien von Daten – relevant, wenn biometrische Daten verarbeitet werden), Artikel 13/14 (Transparenzpflichten in Datenschutzerklärungen), Artikel 22 (Einschränkungen bei automatisierten Einzelentscheidungen) und Artikel 35 (Datenschutz-Folgenabschätzung für hochriskante Verarbeitungen).

Der AI Act ergänzt: Artikel 5 (Einhaltung verbotener Praktiken), Artikel 50 (Transparenzpflichten am Punkt der KI-Interaktion) und – für Hochrisikosysteme – Artikel 8–17 (Risikomanagement, technische Dokumentation, Konformitätsbewertung, Registrierung).

Wo die GDPR eine DPIA für hochriskante Datenverarbeitungen vorschreibt, verlangt der AI Act ein Risikomanagementsystem für hochriskante KI-Systeme. Diese können und sollten aufeinander abgestimmt werden: Eine einzige integrierte Bewertung, die sowohl die Datenverarbeitungsrisiken (GDPR) als auch die KI-Systemrisiken (AI Act) abdeckt, ist effizienter und demonstriert den Aufsichtsbehörden eine ausgereifte Governance-Haltung.

GDPR Artikel 22 ist besonders relevant für KI-gesteuerte Captive Portals. Er schränkt ausschließlich automatisierte Entscheidungen ein, die rechtliche oder ähnlich bedeutsame Auswirkungen auf Einzelpersonen haben. Wenn Ihr KI-System automatisierte Entscheidungen über WiFi-Zugangsstufen, Werbeberechtigung oder Servicequalität ohne menschliche Aufsicht trifft, müssen Sie prüfen, ob Artikel 22 anwendbar ist und ob Sie Gästen das Recht einräumen müssen, eine menschliche Überprüfung zu beantragen.

Implementierungsleitfaden

Schritt 1: Erstellen Sie Ihr KI-Inventar

Bevor Sie die Compliance bewerten können, benötigen Sie ein vollständiges Bild jedes KI-Systems in Ihrem WiFi-Marketing-Stack. Dies bedeutet, über Ihre eigenen Implementierungen hinauszugehen und KI-Komponenten einzubeziehen, die in Drittanbieterplattformen eingebettet sind – Marketing-Automatisierungstools, Analyse-Dashboards, Captive Portal-Anbieter und CRM-Integrationen.

Dokumentieren Sie für jedes System: die Funktion des Systems; die von ihm verarbeiteten Daten; den Anbieter und etwaige Unterauftragsverarbeiter; die Risikostufe gemäß dem AI Act; und die anwendbaren Compliance-Verpflichtungen. Dieses Inventar ist die Grundlage Ihrer AI Act-Compliance-Haltung und wird erforderlich sein, wenn Aufsichtsbehörden Nachweise der Sorgfaltspflicht anfordern.

Schritt 2: Klassifizieren Sie jedes System nach den Risikostufen

Wenden Sie das Vier-Stufen-Framework auf jedes System in Ihrem Inventar an. Die Klassifizierungsfragen sind:

- Verwendet das System eine in Artikel 5 aufgeführte Praxis? Wenn ja, ist es verboten – stellen Sie den Einsatz ein.

- Wird das System für biometrische Verifizierung, individuelles Profiling für den Zugang zu Diensten oder andere Anhang III-Anwendungsfälle verwendet? Wenn ja, ist es hochriskant – beginnen Sie mit der Planung der Konformitätsbewertung.

- Interagiert das System konversationell mit natürlichen Personen, generiert synthetische Inhalte oder führt Emotionserkennung durch? Wenn ja, ist es ein System mit begrenztem Risiko – implementieren Sie die Offenlegungen gemäß Artikel 50.

- Nichts davon? Es ist ein System mit minimalem Risiko – keine AI Act-spezifischen Verpflichtungen, aber die GDPR-Compliance bleibt obligatorisch.

Schritt 3: Implementieren Sie die Offenlegungen gemäß Artikel 50

Implementieren Sie für jeden KI-Chatbot oder jede konversationelle Schnittstelle auf Ihrem Captive Portal eine klare Offenlegung vor ddie Interaktion beginnt. Die Offenlegung muss explizit sein – nicht impliziert, nicht in den Allgemeinen Geschäftsbedingungen versteckt. Ein einfaches UI-Element, das zu Beginn der Sitzung besagt: „Sie chatten mit einem AI assistant“, erfüllt die Verpflichtung. Dies ist eine Frontend-Änderung, kein Systemumbau, und sollte innerhalb eines Sprints implementierbar sein.

Für Emotionserkennungssysteme, die in Ihrem Veranstaltungsort betrieben werden (sofern nicht verboten), fügen Sie einen sichtbaren Hinweis im Betriebsbereich hinzu, der die Gäste darüber informiert, dass ein Emotionserkennungssystem verwendet wird.

Schritt 4: Überprüfung der Unterauftragsverarbeiter-Vereinbarungen mit Anbietern

Als Betreiber teilen Sie die Haftung für verbotene Praktiken Ihrer Anbieter. Überprüfen Sie Ihre Verträge mit WiFi marketing platform providers, analytics vendors und Captive Portal suppliers. Fordern Sie eine explizite Bestätigung ihrer AI Act Klassifizierung und Compliance-Dokumentation an. Fügen Sie vertragliche Bestimmungen hinzu, die Anbieter verpflichten, Sie über Änderungen an ihren AI Systemen zu informieren, die die Risikoklassifizierung beeinflussen könnten.

Schritt 5: Abstimmung mit der GDPR Governance

Beziehen Sie Ihren Datenschutzbeauftragten in den AI Act Compliance-Prozess ein. Aktualisieren Sie Ihr Verzeichnis der Verarbeitungstätigkeiten, um AI Systemklassifizierungen aufzunehmen. Wo eine DPIA gemäß GDPR für Hochrisiko-Datenverarbeitung erforderlich ist, erweitern Sie diese, um die Anforderungen des AI Act an das Risikomanagement abzudecken. Stellen Sie sicher, dass Ihre Datenschutzerklärungen aktualisiert werden, um AI-gesteuerte Verarbeitung und die Offenlegungen gemäß Artikel 50 widerzuspiegeln.

Schritt 6: Planung der Compliance für Hochrisikosysteme (Frist: August 2026)

Wenn eines Ihrer Systeme als Hochrisiko eingestuft wird, beginnen Sie jetzt mit dem Konformitätsbewertungsverfahren. Die Frist im August 2026 für Anhang-III-Systeme ist näher, als es scheint, wenn man die für technische Dokumentation, Implementierung des Risikomanagementsystems und EU-Datenbankregistrierung erforderliche Zeit berücksichtigt. Beziehen Sie Ihre Anbieter frühzeitig ein, um zu verstehen, welche Dokumentation sie bereitstellen können und was Sie als Betreiber erstellen müssen.

Best Practices

Verfolgen Sie einen Privacy-by-Design-Ansatz bei der AI Bereitstellung. Die Anforderungen des AI Act für Hochrisikosysteme – Risikomanagement über den gesamten Lebenszyklus, Daten-Governance, technische Dokumentation – werden am effizientesten erfüllt, wenn sie von Anfang an in die Systemarchitektur integriert werden, anstatt nachträglich angepasst zu werden. Berücksichtigen Sie bei der Bewertung neuer AI-gesteuerter Marketing-Tools die AI Act Compliance-Anforderungen in Ihren Beschaffungskriterien neben der GDPR Compliance und Sicherheitsstandards wie ISO 27001 und PCI DSS.

Bevorzugen Sie Erstanbieterdaten auf Einwilligungsbasis gegenüber abgeleiteten Attributen. Die verbotenen Praktiken und Hochrisikoklassifizierungen des Gesetzes zielen primär auf AI Systeme ab, die sensible Merkmale ableiten oder signifikante automatisierte Entscheidungen über Personen treffen. Systeme, die explizit zugestimmte Erstanbieterdaten – E-Mail-Adressen, deklarierte Präferenzen, Mitgliedschaften in Treueprogrammen – zur Personalisierung nutzen, unterliegen einem deutlich geringeren regulatorischen Risiko als Systeme, die Merkmale aus Verhaltenssignalen ableiten.

Halten Sie eine Trennung zwischen Network Operations AI und Marketing AI aufrecht. AI Systeme, die für das Netzwerkmanagement verwendet werden – Bandbreitenzuweisung, Interferenzminderung, Lastverteilung – stellen unter dem Gesetz ein minimales Risiko dar. AI Systeme, die für die Gastprofilierung und Marketingpersonalisierung verwendet werden, bergen ein höheres Risiko. Eine architektonische Trennung vereinfacht Ihre Risikoklassifizierung und begrenzt den Auswirkungsbereich jeglicher Compliance-Probleme im Marketing-Stack.

Beziehen Sie sich auf IEEE 802.1X und WPA3 für die Authentifizierungsarchitektur. Wo biometrische Verifizierung am Captive Portal verwendet wird, stellen Sie sicher, dass die zugrunde liegende Authentifizierungsarchitektur den aktuellen Standards entspricht. IEEE 802.1X bietet portbasierten Netzwerkzugang mit starker Authentifizierung, und WPA3 bietet verbesserte Verschlüsselung für die Wireless-Schicht. Diese Standards sind herstellerneutral und werden sowohl in Unternehmenssicherheits-Frameworks als auch in GDPR-Leitlinien zu geeigneten technischen Maßnahmen referenziert.

Dokumentieren Sie Ihre AI Act Compliance-Entscheidungen. Selbst bei Systemen mit minimalem Risiko zeigt die Dokumentation Ihrer Klassifizierungsbegründung den Aufsichtsbehörden die gebotene Sorgfalt. Das AI Act verlangt von Anbietern von Hochrisikosystemen, ihre Bewertung zu dokumentieren, bevor sie das System auf den Markt bringen; als Betreiber ist die Pflege einer gleichwertigen Dokumentation für Ihre eigenen Risikobewertungen eine bewährte Praxis.

Fehlerbehebung & Risikominderung

Risiko: Anbieter AI Praktiken sind undurchsichtig. Viele Marketing-Automatisierungs- und WiFi analytics platforms integrieren AI Fähigkeiten, die nicht klar dokumentiert sind. Minderung: Stellen Sie allen Anbietern einen formalen AI Act Compliance-Fragebogen aus. Fordern Sie deren Systemklassifizierung, technische Dokumentation und Nachweise zur Vermeidung verbotener Praktiken an. Nehmen Sie die AI Act Compliance als vertragliche Anforderung in neue und erneuerte Vereinbarungen auf.

Risiko: Captive Portal Chatbot fehlt die Offenlegung gemäß Artikel 50. Dies ist die häufigste Compliance-Lücke, die in aktuellen Implementierungen festgestellt wird. Minderung: Überprüfen Sie Ihre Captive Portal UI. Wenn einer konversationellen AI Schnittstelle eine klare Offenlegung vor der Interaktion fehlt, ist dies ein vorrangiger Korrekturpunkt. Die Behebung ist eine UI-Änderung, die innerhalb weniger Tage implementiert werden kann.

Risiko: Analytics platform erstellt individuelle Profile, die eine Hochrisikoklassifizierung auslösen. Wenn Ihre WiFi Analytics -Plattform persistente individuelle Profile erstellt, die in automatisierte Marketingentscheidungen einfließen, betreiben Sie möglicherweise ein Hochrisikosystem ohne die erforderliche Konformitätsbewertung. Minderung: Überprüfen Sie das Datenmodell der Plattform. Wenn individuelle Profile erstellt und für automatisierte Entscheidungen verwendet werden, sprechen Sie mit Ihrem Anbieter über dessen AI Act Klassifizierung und leiten Sie einen Konformitätsbewertungsprozess ein.

Risiko: GDPR und AI Act Compliance werden als separate Arbeitsströme behandelt. Organisationen, die GDPR und AI Act Compliance in getrennten Teams verwalten, riskieren Duplizierung, Lücken und inkonsistente Dokumentation. Minderung: Etablieren Sie einen einheitlichen AI Governance-Rahmen, der beide regulatorischen Rahmenwerke berücksichtigt. Ein einziger integrierter DPIA-/AI Risikobewertungsprozess ist effizienter.effizient und besser verteidigungsfähig.

Risiko: Fehlklassifizierung des Umfangs der Emotionsinferenz. Das Verbot der Emotionsinferenz gilt in Arbeitsstätten und Bildungseinrichtungen. Orte, die auch Arbeitsstätten sind – Unternehmenscampusse, Krankenhäuser, Co-Working-Spaces – müssen das Verbot auf mitarbeiterorientierte Systeme anwenden, nicht nur auf gästeorientierte. Minderung: Erfassen Sie Ihre Nutzerpopulationen und wenden Sie das Verbot auf alle Kontexte an, in denen Mitarbeiter der Emotionsinferenz unterliegen könnten.

ROI & Geschäftlicher Nutzen

Die Einhaltung des EU AI Act ist nicht nur ein Kostenfaktor. Organisationen, die AI-Governance-Frameworks vor der Durchsetzungskurve aufbauen, erzielen messbare Wettbewerbsvorteile.

Reduziertes regulatorisches Risiko. Die Bußgelder für Verstöße gegen verbotene Praktiken – bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes – stellen ein erhebliches finanzielles Risiko für jede Organisation dar, die in großem Umfang in den EU-Mitgliedstaaten tätig ist. Eine proaktive Compliance-Haltung eliminiert dieses Risiko.

Anbieterdifferenzierung. Da die Einhaltung des AI Act zu einer Beschaffungsanforderung wird, werden Plattformen, die eine klare Risikoklassifizierung, transparente AI-Praktiken und Artikel 50-konforme Schnittstellen nachweisen können, denen vorgezogen, die dies nicht können. Für Betreiber im Bereich Gastgewerbe und Einzelhandel , die WiFi-Marketing-Plattformen evaluieren, wird die AI Act-Compliance-Dokumentation zu einer Standardanforderung in RFPs.

Gästevertrauen und Qualität der Erstanbieterdaten. Transparenzpflichten gemäß Artikel 50 – bei guter Umsetzung – erhöhen das Gästevertrauen. Gäste, die verstehen, wie AI in ihrer Interaktion genutzt wird, sind eher bereit, sich authentisch zu engagieren und qualitativ hochwertigere Erstanbieterdaten bereitzustellen. Dies verbessert direkt die Genauigkeit von Personalisierungsmodellen und den ROI von Marketingkampagnen.

Operative Effizienz durch einheitliche Governance. Organisationen, die ihre GDPR- und AI Act-Compliance-Frameworks in einer einzigen Governance-Struktur zusammenführen, reduzieren Doppelarbeit in Rechts-, IT- und Marketingteams. Die Investition in den Aufbau dieses Frameworks zahlt sich aus, da sich die Regulierungslandschaft ständig weiterentwickelt – dem AI Act werden weitere AI-spezifische Vorschriften folgen, und eine ausgereifte Governance-Haltung bietet eine dauerhafte Grundlage.

Für Betreiber im Bereich Transport und Organisationen des öffentlichen Sektors ist die Einhaltung des AI Act besonders wichtig, angesichts der erhöhten Prüfung von AI-Systemen in öffentlich zugänglichen Bereichen. Proaktive Compliance demonstriert Rechenschaftspflicht gegenüber Regulierungsbehörden und der Öffentlichkeit und unterstützt umfassendere Ziele des digitalen Vertrauens.

Für weitere Informationen zu verwandten Compliance-Frameworks siehe unseren Leitfaden zu PIPEDA Compliance for Guest WiFi in Canada , der analoge Anforderungen an Einwilligung und Transparenz im kanadischen Kontext behandelt.

Anhören: EU AI Act und Guest WiFi Podcast

Schlüsselbegriffe & Definitionen

Provider (EU AI Act)

A natural or legal person, public authority, agency, or other body that develops an AI system or general-purpose AI model, or that has an AI system or general-purpose AI model developed, with a view to placing it on the market or putting it into service under its own name or trademark, whether for payment or free of charge.

In a Guest WiFi context, the provider is typically the WiFi marketing platform vendor or the developer of the AI personalisation engine. Providers of high-risk systems carry the heaviest compliance obligations under the Act.

Deployer (EU AI Act)

A natural or legal person, public authority, agency, or other body that uses an AI system under its own authority, except where the AI system is used in the course of a personal non-professional activity.

The venue operator — hotel group, retail chain, stadium operator — is the deployer. Deployers are responsible for Article 50 transparency disclosures and for ensuring that the AI systems they use comply with the Act's requirements, even when those systems are provided by third parties.

Biometric Categorisation System

An AI system for the purpose of assigning natural persons to specific categories on the basis of their biometric data, such as face, movement, gait, posture, voice, appearance, behaviour, or other physiological or behavioural human characteristics or traits.

Relevant for venue operators using camera-based analytics or device fingerprinting in combination with AI. Systems that infer sensitive attributes (race, religion, political opinion) from biometric data are prohibited under Article 5. Systems that perform biometric categorisation without inferring sensitive attributes may be high-risk under Annex III.

Emotion Recognition System

An AI system for the purpose of identifying or inferring emotions or intentions of natural persons on the basis of their biometric data.

Prohibited in workplaces and educational institutions under Article 5. In other venue contexts (retail, hospitality), emotion recognition systems are regulated under Annex III as high-risk and require deployers to inform affected persons under Article 50(3). Vendors marketing 'mood-based' or 'engagement state' features should be assessed against this definition.

Individual Profiling

Any form of automated processing of personal data consisting of the use of personal data to evaluate certain personal aspects relating to a natural person, in particular to analyse or predict aspects concerning that natural person's performance, economic situation, health, personal preferences, interests, reliability, behaviour, location or movements.

AI systems listed under Annex III are always considered high-risk if they profile individuals. WiFi analytics platforms that build persistent individual profiles feeding into automated marketing decisions must be assessed against this definition to determine whether they are high-risk systems.

Social Scoring

The evaluation or classification of natural persons or groups of persons over a period of time based on their social behaviour or known, inferred, or predicted personal or personality characteristics, with a social score leading to detrimental or unfavourable treatment of those persons or groups in social contexts that are unrelated to the contexts in which the data was originally generated or collected.

Prohibited under Article 5. In a WiFi marketing context, this targets AI systems that score guests on behavioural patterns and use those scores to restrict access, withhold offers, or provide inferior service. The key element is detrimental treatment — personalisation that improves the experience for high-value guests is not social scoring unless it simultaneously disadvantages lower-scoring guests.

Captive Portal

A web page or authentication gateway presented to newly connected users of a WiFi network before they are granted broader access to the internet. Used by venue operators to collect guest data, present terms of service, and deliver marketing content.

The primary deployment surface for AI-driven WiFi marketing. AI features on captive portals — chatbots, personalised splash pages, recommendation engines — are subject to Article 50 transparency obligations. The captive portal is also the point at which GDPR consent for data processing is typically obtained.

Conformity Assessment

The process of verifying whether a high-risk AI system complies with the requirements set out in the EU AI Act, including risk management, data governance, technical documentation, transparency, human oversight, accuracy, robustness, and cybersecurity.

Required for high-risk AI systems before they are placed on the market or put into service. For most high-risk systems under Annex III, providers can conduct a self-assessment. For biometric identification systems, third-party assessment is required. Venue operators deploying high-risk AI systems need to ensure their vendors have completed the required conformity assessment and can provide the documentation.

DPIA (Data Protection Impact Assessment)

A process required under GDPR Article 35 for processing operations that are likely to result in a high risk to the rights and freedoms of natural persons. The DPIA must describe the processing, assess necessity and proportionality, and identify and mitigate risks.

Required under GDPR for high-risk data processing, including large-scale profiling and systematic monitoring of publicly accessible areas. In the AI Act context, the DPIA should be extended to cover AI system risk management requirements, creating a unified assessment that satisfies both regulatory frameworks.

Article 50 Transparency Obligation

The requirement under Article 50 of the EU AI Act that providers ensure AI systems intended to interact with natural persons are designed so that those persons are informed they are interacting with an AI system, unless this is obvious from the context. Deployers must ensure this disclosure is in place.

The most immediately actionable compliance obligation for venue operators with AI chatbots or conversational interfaces on their captive portals. The disclosure must be clear and upfront — before the interaction begins — not buried in terms and conditions. Applies to all AI conversational systems regardless of risk tier.

Fallstudien

A 450-room hotel group operating across five EU member states has deployed an AI-driven chatbot on its captive portal to handle guest check-in queries, restaurant recommendations, and WiFi troubleshooting. The chatbot is powered by a third-party LLM platform. The marketing team also uses a WiFi analytics platform that builds individual guest profiles — including visit history, dwell time by venue area, and inferred demographic segments — to serve personalised promotional offers via the captive portal splash page. The CTO needs to assess the AI Act compliance posture of both systems before the next board meeting.

Step 1 — Classify the chatbot. The AI-driven chatbot is a conversational AI system interacting with natural persons. It falls under Article 50(1) as a Limited Risk system. The immediate action is to implement a clear pre-interaction disclosure on the captive portal UI: 'You are chatting with an AI assistant.' This is a front-end change. The hotel group, as the deployer, is responsible for this disclosure even though the underlying LLM is provided by a third party. Review the vendor contract to confirm the provider's AI Act classification and request their technical documentation.

Step 2 — Classify the analytics platform. The WiFi analytics platform builds individual guest profiles and uses them to serve personalised offers via automated decisions. The key question is whether this constitutes individual profiling under Annex III — automated processing of personal data to assess preferences, interests, behaviour, and location. If yes, the system is high-risk. Request the vendor's AI Act classification documentation. If the vendor classifies the system as minimal risk, obtain their written rationale and assess whether it is defensible. If the system is high-risk, begin planning for conformity assessment compliance ahead of the August 2026 deadline.

Step 3 — Audit the inferred demographic segments. If the analytics platform infers demographic segments that include sensitive attributes — age bracket, gender, nationality — using AI models, assess whether this constitutes biometric categorisation of sensitive attributes under Article 5. If the segmentation is based on declared data (loyalty programme membership, explicitly provided preferences) rather than AI inference from behavioural signals, it is lower risk. If it is AI-inferred from behavioural signals, it requires careful legal review.

Step 4 — Align with GDPR. Ensure the hotel group's privacy notice reflects AI-driven processing and the Article 50 disclosures. Review the lawful basis for the analytics processing under GDPR Article 6. If the processing is based on legitimate interests, conduct a legitimate interests assessment that accounts for the AI Act risk classification. Update the DPIA to cover both GDPR and AI Act risk dimensions.

A national retail chain with 120 stores across Germany, France, and the Netherlands is evaluating a new WiFi marketing platform that includes an AI feature described by the vendor as 'mood-based personalisation' — the system analyses the speed and pattern of a guest's captive portal interactions to infer their 'engagement state' and adjusts the promotional content served on the splash page accordingly. The IT director needs to assess whether this feature is permissible under the EU AI Act.

Step 1 — Identify the AI practice. The 'mood-based personalisation' feature analyses behavioural signals (interaction speed and pattern) to infer an 'engagement state' — which is functionally an emotional or psychological state. This is emotion inference.

Step 2 — Apply the Article 5 prohibition test. Article 5 prohibits emotion inference in workplaces and educational institutions. A retail store is not a workplace for the guest, so this specific prohibition does not apply to the guest population in the retail context. However, the feature may still be prohibited under Article 5(1)(a) if it deploys manipulative techniques to distort behaviour and impair informed decision-making, causing significant harm. The use of inferred emotional state to serve manipulative promotional content — targeting a guest identified as 'frustrated' with an urgency-based offer, for example — is likely to fall within this prohibition.

Step 3 — Assess the GDPR implications. Inferring emotional state from behavioural data constitutes processing of personal data for profiling purposes under GDPR. The lawful basis for this processing must be assessed. Legitimate interests is unlikely to be a defensible basis for emotion inference used for marketing purposes. Explicit consent is the most appropriate basis, but the consent mechanism must be specific and granular — consent to WiFi access does not constitute consent to emotion inference.

Step 4 — Recommendation. Do not deploy the 'mood-based personalisation' feature without a detailed legal assessment. The risk of Article 5 violation — specifically the manipulation prohibition — is material. Request the vendor's legal analysis of the feature's AI Act classification. If the vendor cannot provide a defensible classification, treat the feature as prohibited and do not activate it. Standard behavioural personalisation based on objective metrics (visit frequency, time of day, declared preferences) is permissible and carries significantly lower regulatory risk.

Szenarioanalyse

Q1. Your venue's WiFi marketing platform vendor has just released a new feature called 'Visitor Sentiment Scoring' that analyses the speed, sequence, and hesitation patterns of a guest's captive portal interactions to assign a sentiment score (positive, neutral, frustrated) and adjust the promotional content served accordingly. The vendor's documentation describes this as 'behavioural analytics' rather than 'emotion recognition'. As the IT director, how do you assess this feature's EU AI Act compliance status, and what actions do you take?

💡 Hinweis:Focus on the technical function of the system, not the vendor's marketing language. Ask: what is the system actually doing? Is it inferring an emotional or psychological state from behavioural signals? Then apply the Article 5 prohibition test and the Article 50 transparency test.

Empfohlenen Ansatz anzeigen

The feature is functionally an emotion recognition system regardless of the vendor's labelling. Analysing interaction patterns to infer 'frustration' or 'positive sentiment' is emotion inference. The first step is to apply the Article 5 prohibition test: is this system being used in a workplace or educational institution? If the venue is a retail store or hotel, the Article 5 workplace prohibition does not apply to guests. However, the manipulation prohibition under Article 5(1)(a) may apply if the system uses the inferred sentiment to serve manipulative content — for example, targeting a 'frustrated' guest with an urgency-based offer. The second step is to assess whether the system falls under Annex III as an emotion recognition system, which would make it high-risk. The third step is to request the vendor's written AI Act classification and legal analysis. If the vendor cannot provide a defensible classification, do not activate the feature. Document your assessment rationale regardless of the outcome.

Q2. A stadium operator running a 60,000-capacity venue uses Purple's Guest WiFi platform to collect first-party data at events. The marketing team wants to deploy an AI chatbot on the captive portal to answer fan queries about facilities, merchandise, and upcoming events. The chatbot is powered by a third-party LLM API. The venue's legal team asks: what are the Article 50 obligations, who is responsible for compliance, and what does the implementation look like in practice?

💡 Hinweis:Identify the deployer, the provider, and the applicable Article 50 scenario. Then specify what the disclosure must look like and when it must appear.

Empfohlenen Ansatz anzeigen

The stadium operator is the deployer; the LLM API provider is the provider. Under Article 50(1), the deployer is responsible for ensuring that guests are informed they are interacting with an AI system before the interaction begins. The implementation requires a clear disclosure on the captive portal UI — a badge or introductory message such as 'You are chatting with an AI assistant' — displayed before the first message is sent. This is a front-end change to the captive portal template. The disclosure must be explicit and upfront; it cannot be buried in the terms of service. The LLM provider has their own obligations as a provider (technical documentation, instructions for use), but the deployer cannot rely on the provider to satisfy the deployer's transparency obligations. Additionally, the stadium operator must ensure the chatbot's data processing complies with GDPR — the lawful basis for processing any personal data shared in the conversation must be established, and the privacy notice must reflect the AI-driven processing.

Q3. A retail chain's WiFi analytics platform has been building individual guest profiles for two years, combining WiFi session data (device MAC address, dwell time, visit frequency, location within store) with CRM data (purchase history, loyalty programme tier) to feed an AI model that makes automated decisions about which promotional offers to serve each guest at the captive portal. The chain's new compliance lead has been asked to assess whether this system is high-risk under the EU AI Act's Annex III individual profiling provision. What is the assessment methodology and likely outcome?

💡 Hinweis:Apply the Annex III individual profiling test: is the AI system performing automated processing of personal data to assess aspects of a person's preferences, interests, behaviour, or location? Then consider whether the automated decisions are significant enough to trigger the high-risk classification.

Empfohlenen Ansatz anzeigen

The assessment methodology follows three steps. First, confirm that the system is an AI system (not a simple rules-based engine) — if the promotional decision is made by a machine learning model rather than a deterministic rules engine, it is an AI system. Second, apply the Annex III individual profiling test: the system is processing personal data (WiFi session data, CRM data) to assess individual preferences, interests, behaviour, and location. This meets the definition of individual profiling. Third, assess whether the system is listed under Annex III use cases — the most relevant category is 'access to and enjoyment of essential public and private services', which includes AI systems used to evaluate eligibility for services. Whether promotional offer decisions constitute 'access to services' is a grey area; if the AI system can deny a guest access to a promotional offer that materially affects their purchasing decision, regulators may take the view that this is significant. The likely outcome is that the system should be treated as potentially high-risk and a formal assessment conducted. The chain should engage the platform vendor to obtain their AI Act classification, initiate a DPIA/AI risk assessment, and begin planning for conformity assessment compliance ahead of the August 2026 deadline.