EU AI Act e Guest WiFi: Cosa i marketer devono sapere

L'EU AI Act (Regolamento 2024/1689) introduce un quadro normativo basato sul rischio che influenza direttamente il modo in cui gli operatori di sedi implementano il marketing WiFi basato su AI, i captive portal e l'analisi degli ospiti. Questa guida mappa i quattro livelli di rischio dell'Atto rispetto a casi d'uso reali di Guest WiFi, identifica le pratiche proibite, inclusa l'inferenza delle emozioni e il social scoring, e fornisce passaggi di conformità attuabili per i team IT e i direttori marketing che operano in ambienti di ospitalità, vendita al dettaglio, eventi e settore pubblico. Comprendere dove si colloca la vostra implementazione nello spettro del rischio — e implementare gli obblighi di trasparenza dell'Articolo 50 per i chatbot AI e i portali conversazionali — non è più facoltativo: l'applicazione delle pratiche proibite è iniziata a febbraio 2025.

🎧 Ascolta questa guida

Visualizza trascrizione

- Riepilogo Esecutivo

- Approfondimento Tecnico

- Il Quadro di Rischio a Quattro Livelli

- Pratiche Proibite ai Sensi dell'Articolo 5

- Sistemi ad Alto Rischio ai Sensi dell'Allegato III

- Obblighi di Trasparenza dell'Articolo 50 — La Priorità Immediata

- L'AI Act e il GDPR: Un Quadro di Conformità Stratificato

- Guida all'Implementazione

- Fase 1: Costruisci il Tuo Inventario AI

- Fase 2: Classifica Ogni Sistema Rispetto ai Livelli di Rischio

- Fase 3: Implementa le Informative dell'Articolo 50

- Fase 4: Revisione degli accordi con i sub-processori dei fornitori

- Fase 5: Allineamento con la governance GDPR

- Fase 6: Pianificazione della conformità per i sistemi ad alto rischio (scadenza agosto 2026)

- Migliori Pratiche

- Risoluzione dei Problemi e Mitigazione del Rischio

- ROI e Impatto sul Business

- Ascolta: Podcast EU AI Act e WiFi Ospiti

Riepilogo Esecutivo

L'EU AI Act (Regolamento 2024/1689) è il primo quadro giuridico completo al mondo per l'intelligenza artificiale e si applica direttamente al modo in cui gli operatori di sedi implementano l'AI attraverso l'infrastruttura Guest WiFi . L'Atto classifica i sistemi AI in quattro livelli di rischio — Proibito, Alto Rischio, Rischio Limitato e Rischio Minimo — e assegna di conseguenza gli obblighi di conformità. Per la maggior parte degli operatori di ospitalità e vendita al dettaglio , l'impatto operativo immediato ricade in due aree: primo, assicurarsi che qualsiasi interfaccia conversazionale basata su AI su un captive portal contenga una chiara informativa sulla trasparenza dell'Articolo 50; e secondo, verificare gli stack di marketing esistenti per confermare che non utilizzino pratiche proibite come l'inferenza delle emozioni, il social scoring o la categorizzazione biometrica basata su attributi sensibili.

Le disposizioni sulle pratiche proibite ai sensi dell'Articolo 5 sono diventate applicabili a febbraio 2025. Gli obblighi per i sistemi ad alto rischio ai sensi dell'Allegato III si applicano da agosto 2026. Le multe per le violazioni delle pratiche proibite raggiungono fino a 35 milioni di euro o il 7% del fatturato annuo globale. Questa guida fornisce un riferimento tecnico per i manager IT, gli architetti di rete e i responsabili della conformità che devono valutare le loro implementazioni attuali e implementare le modifiche richieste in questo trimestre.

Approfondimento Tecnico

Il Quadro di Rischio a Quattro Livelli

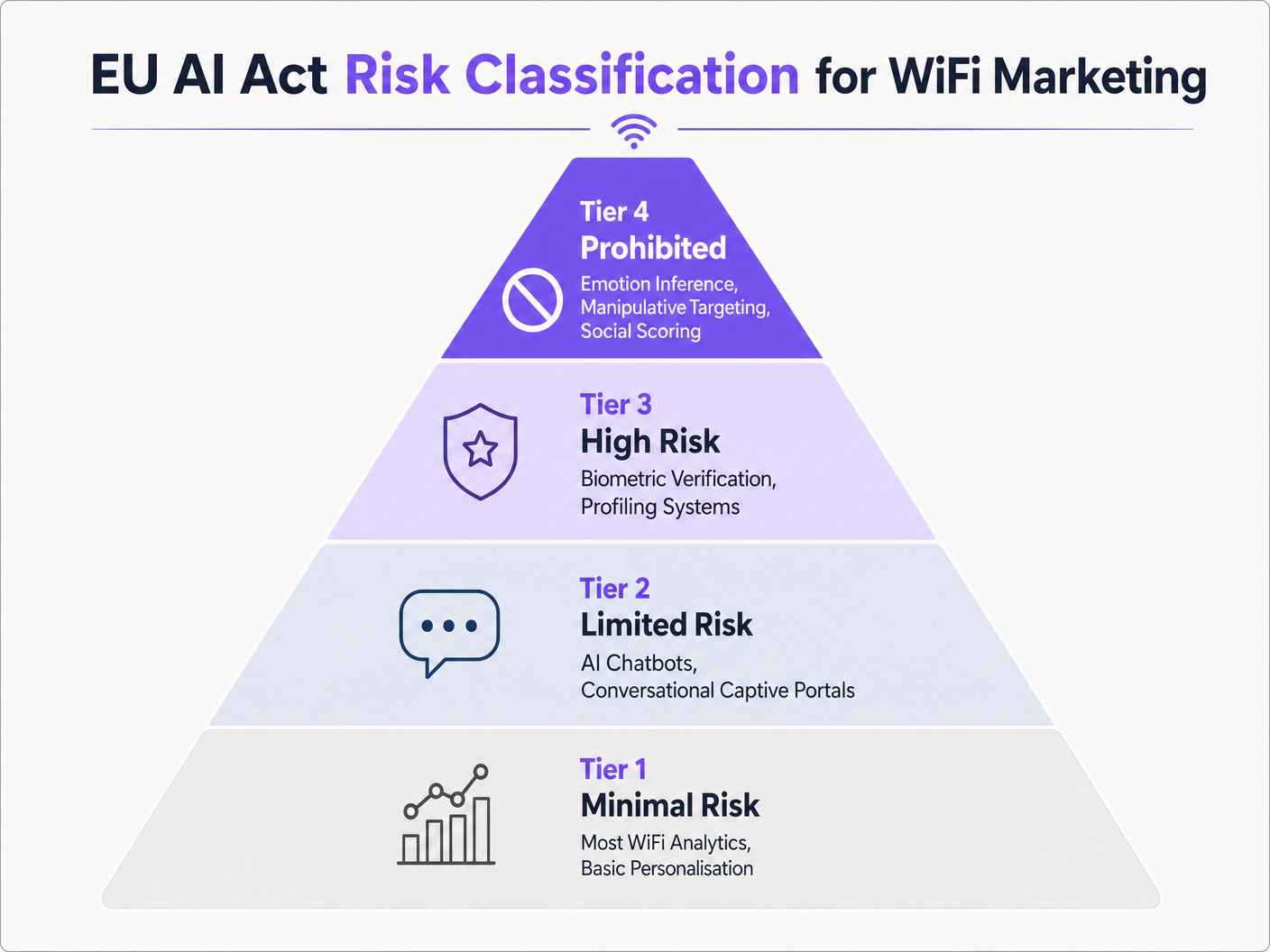

L'EU AI Act classifica i sistemi AI in base al rischio che essi pongono ai diritti fondamentali, alla sicurezza e ai valori democratici. La classificazione determina gli obblighi di conformità che si applicano sia al fornitore (lo sviluppatore o il venditore del sistema AI) sia al deployer (l'organizzazione che mette in servizio il sistema — tipicamente l'operatore della sede o il team IT).

I quattro livelli, mappati ai contesti di Guest WiFi e marketing delle sedi, sono i seguenti:

| Livello di Rischio | Riferimento EU AI Act | Esempi di Marketing WiFi | Obbligo di Conformità |

|---|---|---|---|

| Proibito | Articolo 5 | Inferenza delle emozioni sulle interazioni del portal; social scoring degli ospiti; categorizzazione biometrica per razza/religione | Cessazione immediata; nessun deployment consentito |

| Alto Rischio | Allegato III | Verifica biometrica al captive portal; profilazione AI per l'accesso a servizi essenziali | Valutazione di conformità, documentazione tecnica, sistema di gestione del rischio, registrazione nel database UE |

| Rischio Limitato | Articolo 50 | AI chatbots sui captive portal; splash page AI generative; sistemi di riconoscimento delle emozioni (contesti non proibiti) | Informativa sulla trasparenza agli utenti finali prima/durante l'interazione |

| Rischio Minimo | Nessun obbligo specifico | Analisi aggregata del traffico pedonale; mappe di calore del tempo di permanenza; personalizzazione basata su regole; AI per l'ottimizzazione della larghezza di banda | Nessun obbligo specifico dell'EU AI Act (il GDPR si applica comunque) |

Pratiche Proibite ai Sensi dell'Articolo 5

L'Articolo 5 dell'EU AI Act definisce otto categorie di pratiche AI proibite. Tre sono direttamente rilevanti per le implementazioni di marketing WiFi delle sedi.

Tecniche Manipolative e Ingannatrici. L'Atto proibisce i sistemi AI che impiegano tecniche subliminali, manipolative o ingannatrici per distorcere il comportamento di una persona e compromettere la sua capacità di prendere una decisione informata, laddove ciò causi o sia probabile che causi un danno significativo. In un contesto di marketing WiFi, questo mira a sistemi che sfruttano segnali comportamentali catturati al captive portal — esitazione nel cliccare, schemi di scorrimento, tempo sulla pagina — per inferire vulnerabilità psicologiche e servire offerte manipolative. La soglia chiave è il danno significativo; i regolatori lo valuteranno contestualmente, ma il principio è chiaro: il nudging basato su AI che bypassa l'agenzia razionale è fuori ambito.

Social Scoring. L'Atto proibisce i sistemi AI che valutano o classificano gli individui in base al loro comportamento sociale o alle caratteristiche personali, laddove ciò porti a un trattamento dannoso o sfavorevole. Un sistema di fidelizzazione WiFi che utilizza un modello AI per assegnare un punteggio agli ospiti in base a schemi comportamentali — frequenza delle visite, tempo di permanenza, segnali di acquisto — e poi restringe la velocità di accesso o nega offerte agli ospiti con punteggio inferiore rientrerebbe in questa proibizione. La distinzione tra personalizzazione consentita e social scoring proibito risiede nel fatto che la classificazione AI produca un trattamento dannoso: servire un'offerta migliore a un ospite premium è personalizzazione; negare a un ospite con punteggio inferiore l'accesso ai servizi è social scoring.

Categorizzazione Biometrica di Attributi Sensibili. L'Atto proibisce i sistemi AI che utilizzano dati biometrici per inferire attributi sensibili inclusi razza, opinione politica, appartenenza sindacale, credenze religiose o filosofiche, vita sessuale o orientamento sessuale. Questo è particolarmente rilevante per le sedi che utilizzano analisi basate su telecamere insieme ai dati WiFi. Se un sistema AI incrocia i dati dell'indirizzo MAC del dispositivo con l'analisi visiva per inferire l'etnia e personalizzare il contenuto di conseguenza, si tratta di una violazione diretta dell'Articolo 5. La proibizione si applica indipendentemente dal fatto che i dati biometrici siano elaborati in tempo reale o in batch.

Inferenza delle Emozioni — Chiarimento dell'Ambito. L'Atto proibisce l'inferenza delle emozioni nei luoghi di lavoro e nelle istituzioni educative. Questa proibizione non si estende automaticamente a sedi di vendita al dettaglio, hotel o stadi in relazione agli ospiti. Tuttavia, se la vostra sede è anche un luogo di lavoro — un campus aziendale, uno spazio di co-working, un ospedale — e state utilizzando l'inferenza delle emozioni sui dipendenti connessi al guest WiFi, ciò è proibito. Gli operatori delle sedi dovrebbero mappare attentamente le loro popolazioni di utenti prima di presumere che la proibizione dell'inferenza delle emozioni non si applichi.

Sistemi ad Alto Rischio ai Sensi dell'Allegato III

L'Allegato III dell'Atto elenca i casi d'uso che sono classificati come ad alto rischio. Per le implementazioni di Guest WiFi, due categorie sono direttamente rilevanti.

Primo, sistemi biometrici: i sistemi di identificazione biometrica remota (esclusa la semplice verifica biometrica che conferma l'identità di una persona) e i sistemi di categorizzazione biometrica che inferiscono attributi sensibili o protetti sono ad alto rischio. Se il tuo captive portal utilizza il riconoscimento facciale per autenticare gli ospiti di ritorno, tale sistema richiede una valutazione completa della conformità, documentazione tecnica, un sistema di gestione del rischio per tutto il ciclo di vita del sistema e la registrazione nel database dell'EU AI Act.

Secondo, profilazione individuale: qualsiasi sistema AI elencato nell'Allegato III è sempre considerato ad alto rischio se profila individui — definito come trattamento automatizzato di dati personali per valutare aspetti della vita di una persona, inclusi preferenze, interessi, comportamento e posizione o movimento. Questa è la disposizione che più probabilmente riguarda le piattaforme WiFi Analytics che costruiscono profili individuali persistenti alimentando decisioni di marketing automatizzate. La domanda chiave è se il sistema AI prende o influenza sostanzialmente decisioni automatizzate sugli ospiti individuali basate sulle loro caratteristiche profilate.

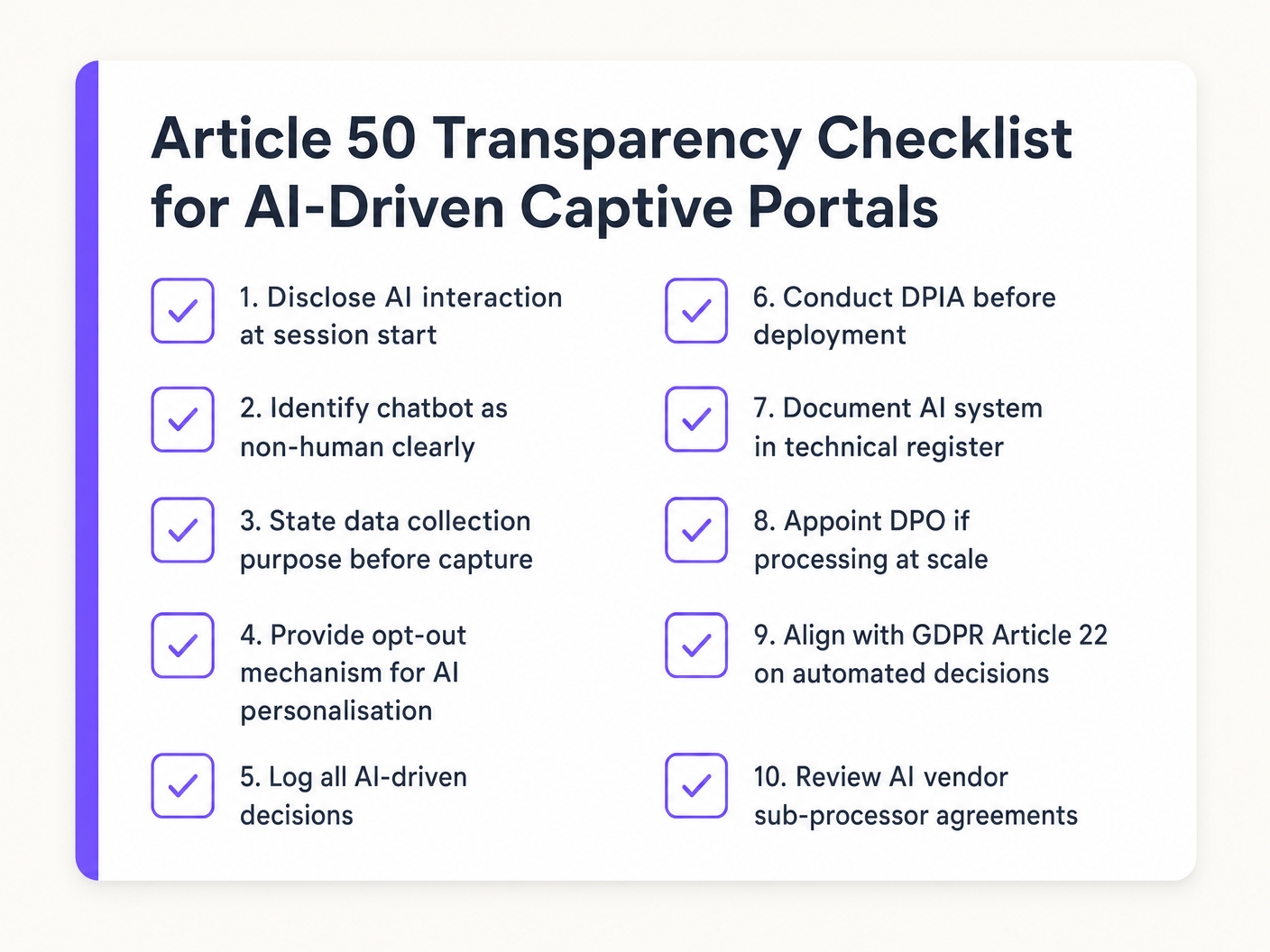

Obblighi di Trasparenza dell'Articolo 50 — La Priorità Immediata

Per la maggior parte degli operatori di sedi oggi, l'Articolo 50 è la disposizione più rilevante dal punto di vista operativo.

Copre tre scenari:

Sistemi AI conversazionali (Articolo 50(1)): I fornitori devono garantire che i sistemi AI destinati a interagire con persone fisiche siano progettati in modo tale che tali persone siano informate che stanno interagendo con un sistema AI, a meno che ciò non sia ovvio dal contesto. I deployer devono assicurarsi che questa informativa sia presente. Questo si applica a qualsiasi chatbot AI implementato su un captive portal — sia per servizi agli ospiti, assistenza al check-in in hotel, navigazione della sede o richieste di marketing.

Riconoscimento delle emozioni e categorizzazione biometrica (Articolo 50(3)): I deployer di sistemi di riconoscimento delle emozioni o di sistemi di categorizzazione biometrica devono informare le persone fisiche esposte a tali sistemi. Questo è un obbligo separato dall'informativa del chatbot e si applica anche quando il sistema non è proibito.

Contenuto sintetico (Articolo 50(4)): I sistemi AI che generano contenuti audio, immagini, video o testuali sintetici devono contrassegnare tale contenuto come generato da AI. Se il tuo captive portal utilizza l'AI generativa per produrre messaggi di benvenuto personalizzati o testi promozionali, tale contenuto deve essere etichettato.

L'AI Act e il GDPR: Un Quadro di Conformità Stratificato

L'AI Act non sostituisce il GDPR; opera in parallelo. Per gli operatori di sedi, ciò significa che gli obblighi di conformità di entrambi i quadri si applicano simultaneamente alle implementazioni di marketing WiFi basate sull'AI.

Ai sensi del GDPR, le disposizioni rilevanti per il marketing WiFi basato sull'AI includono: Articolo 6 (base giuridica per il trattamento), Articolo 9 (dati di categoria speciale — rilevante se vengono trattati dati biometrici), Articolo 13/14 (obblighi di trasparenza nelle informative sulla privacy), Articolo 22 (restrizioni sul processo decisionale individuale automatizzato) e Articolo 35 (Valutazione d'impatto sulla protezione dei dati per trattamenti ad alto rischio).

L'AI Act aggiunge: Articolo 5 (conformità alle pratiche proibite), Articolo 50 (informative sulla trasparenza al momento dell'interazione con l'AI) e — per i sistemi ad alto rischio — Articoli 8–17 (gestione del rischio, documentazione tecnica, valutazione della conformità, registrazione).

Laddove il GDPR richiede una DPIA per il trattamento di dati ad alto rischio, l'AI Act richiede un sistema di gestione del rischio per i sistemi AI ad alto rischio. Questi possono e devono essere allineati: una singola valutazione integrata che copra sia i rischi di trattamento dei dati (GDPR) sia i rischi del sistema AI (AI Act) è più efficiente e dimostra una postura di governance matura ai regolatori.

L'Articolo 22 del GDPR è particolarmente rilevante per i captive portal basati sull'AI. Limita il processo decisionale esclusivamente automatizzato che produce effetti legali o effetti analogamente significativi sugli individui. Se il tuo sistema AI prende decisioni automatizzate sui livelli di accesso WiFi, l'idoneità promozionale o la qualità del servizio senza supervisione umana, devi valutare se l'Articolo 22 si applica e se devi fornire agli ospiti il diritto di richiedere una revisione umana.

Guida all'Implementazione

Fase 1: Costruisci il Tuo Inventario AI

Prima di poter valutare la conformità, hai bisogno di un quadro completo di ogni sistema AI nel tuo stack di marketing WiFi. Ciò significa andare oltre le tue implementazioni per includere componenti AI incorporati in piattaforme di terze parti — strumenti di automazione del marketing, dashboard di analisi, fornitori di captive portal e integrazioni CRM.

Per ogni sistema, documenta: la funzione del sistema; i dati che elabora; il fornitore e gli eventuali sub-processori; il livello di rischio ai sensi dell'AI Act; e gli obblighi di conformità applicabili. Questo inventario è la base della tua postura di conformità all'AI Act e sarà richiesto se i regolatori richiederanno prove di due diligence.

Fase 2: Classifica Ogni Sistema Rispetto ai Livelli di Rischio

Applica il quadro a quattro livelli a ogni sistema nel tuo inventario. Le domande di classificazione sono:

- Il sistema utilizza una delle pratiche elencate nell'Articolo 5? Se sì, è proibito — interrompi l'implementazione.

- Il sistema è utilizzato per la verifica biometrica, la profilazione individuale per l'accesso ai servizi o qualsiasi altro caso d'uso dell'Allegato III? Se sì, è ad alto rischio — inizia la pianificazione della valutazione di conformità.

- Il sistema interagisce con persone fisiche in modo conversazionale, genera contenuto sintetico o esegue il riconoscimento delle emozioni? Se sì, è a rischio limitato — implementa le informative dell'Articolo 50.

- Nessuno dei precedenti? È a rischio minimo — nessun obbligo specifico dell'AI Act, ma la conformità al GDPR rimane obbligatoria.

Fase 3: Implementa le Informative dell'Articolo 50

Per qualsiasi chatbot AI o interfaccia conversazionale sul tuo captive portal, implementa un'informativa chiara prima di il'interazione inizia. La divulgazione deve essere esplicita — non implicita, non nascosta nei termini e condizioni. Un semplice elemento dell'interfaccia utente che dichiara "Stai chattando con un assistente AI" all'inizio della sessione soddisfa l'obbligo. Si tratta di una modifica front-end, non di una ricostruzione del sistema, e dovrebbe essere implementabile entro un singolo sprint.

Per i sistemi di riconoscimento delle emozioni operanti nella tua sede (ove non proibito), aggiungi un avviso visibile nell'area operativa che informi gli ospiti che un sistema di riconoscimento delle emozioni è in uso.

Fase 4: Revisione degli accordi con i sub-processori dei fornitori

In qualità di implementatore, condividi la responsabilità per le pratiche proibite utilizzate dai tuoi fornitori. Rivedi i tuoi contratti con i fornitori di piattaforme di marketing WiFi, i fornitori di analisi e i fornitori di captive portal. Richiedi una conferma esplicita della loro classificazione ai sensi dell'AI Act e della documentazione di conformità. Aggiungi clausole contrattuali che richiedano ai fornitori di notificarti qualsiasi modifica ai loro sistemi AI che possa influire sulla classificazione del rischio.

Fase 5: Allineamento con la governance GDPR

Coinvolgi il tuo Responsabile della Protezione dei Dati nel processo di conformità all'AI Act. Aggiorna il tuo Registro delle Attività di Trattamento per includere le classificazioni dei sistemi AI. Laddove sia richiesta una DPIA ai sensi del GDPR per il trattamento di dati ad alto rischio, estendila per coprire i requisiti di gestione del rischio dell'AI Act. Assicurati che le tue informative sulla privacy siano aggiornate per riflettere il trattamento basato sull'AI e le divulgazioni dell'Articolo 50.

Fase 6: Pianificazione della conformità per i sistemi ad alto rischio (scadenza agosto 2026)

Se uno qualsiasi dei tuoi sistemi è classificato come ad alto rischio, inizia subito il processo di valutazione della conformità. La scadenza di agosto 2026 per i sistemi dell'Allegato III è più vicina di quanto sembri se si considera il tempo necessario per la documentazione tecnica, l'implementazione del sistema di gestione del rischio e la registrazione nel database dell'UE. Coinvolgi i tuoi fornitori in anticipo per capire quale documentazione possono fornire e cosa devi produrre come implementatore.

Migliori Pratiche

Adotta un approccio Privacy-by-Design all'implementazione dell'AI. I requisiti dell'AI Act per i sistemi ad alto rischio — gestione del rischio lungo tutto il ciclo di vita, governance dei dati, documentazione tecnica — sono soddisfatti in modo più efficiente quando sono integrati nell'architettura del sistema fin dall'inizio piuttosto che aggiunti in seguito. Quando valuti nuovi strumenti di marketing basati sull'AI, includi i requisiti di conformità all'AI Act nei tuoi criteri di acquisto insieme alla conformità GDPR e agli standard di sicurezza come ISO 27001 e PCI DSS.

Preferisci dati di prima parte basati sul consenso rispetto ad attributi inferiti. Le pratiche proibite e le classificazioni ad alto rischio dell'Atto sono principalmente mirate ai sistemi AI che inferiscono caratteristiche sensibili o prendono decisioni automatizzate significative sugli individui. I sistemi che utilizzano dati di prima parte esplicitamente acconsentiti — indirizzi email, preferenze dichiarate, iscrizione a programmi fedeltà — per guidare la personalizzazione presentano un rischio normativo significativamente inferiore rispetto ai sistemi che inferiscono caratteristiche da segnali comportamentali.

Mantieni una separazione tra l'AI per le operazioni di rete e l'AI per il marketing. I sistemi AI utilizzati per la gestione della rete — allocazione della larghezza di banda, mitigazione delle interferenze, bilanciamento del carico — presentano un rischio minimo ai sensi dell'Atto. I sistemi AI utilizzati per la profilazione degli ospiti e la personalizzazione del marketing comportano un rischio maggiore. Mantenere questi sistemi architettonicamente separati semplifica la classificazione del rischio e limita l'impatto di qualsiasi problema di conformità nello stack di marketing.

Fai riferimento a IEEE 802.1X e WPA3 per l'architettura di autenticazione. Laddove la verifica biometrica sia utilizzata al captive portal, assicurati che l'architettura di autenticazione sottostante soddisfi gli standard attuali. IEEE 802.1X fornisce il controllo degli accessi alla rete basato su porta con autenticazione forte, e WPA3 fornisce una crittografia migliorata per il livello wireless. Questi standard sono indipendenti dal fornitore e sono richiamati sia nei framework di sicurezza aziendale che nelle linee guida GDPR sulle misure tecniche appropriate.

Documenta le tue decisioni di conformità all'AI Act. Anche per i sistemi a rischio minimo, documentare la logica della tua classificazione dimostra la dovuta diligenza alle autorità di regolamentazione. L'AI Act richiede ai fornitori di sistemi ad alto rischio di documentare la loro valutazione prima di immettere il sistema sul mercato; in qualità di implementatore, mantenere una documentazione equivalente per le tue valutazioni del rischio è una migliore pratica.

Risoluzione dei Problemi e Mitigazione del Rischio

Rischio: Le pratiche AI dei fornitori sono opache. Molte piattaforme di automazione del marketing e di analisi WiFi incorporano funzionalità AI che non sono chiaramente documentate. Mitigazione: Invia un questionario formale di conformità all'AI Act a tutti i fornitori. Richiedi la classificazione del loro sistema, la documentazione tecnica e le prove di prevenzione delle pratiche proibite. Includi la conformità all'AI Act come requisito contrattuale negli accordi nuovi e rinnovati.

Rischio: Il chatbot del captive portal manca della divulgazione dell'Articolo 50. Questa è la lacuna di conformità più comune identificata nelle implementazioni attuali. Mitigazione: Verifica l'interfaccia utente del tuo captive portal. Se qualsiasi interfaccia AI conversazionale manca di una chiara divulgazione pre-interazione, questo è un elemento di rimedio prioritario. La soluzione è una modifica dell'interfaccia utente implementabile in pochi giorni.

Rischio: La piattaforma di analisi crea profili individuali che attivano la classificazione ad alto rischio. Se la tua WiFi Analytics piattaforma crea profili individuali persistenti che alimentano decisioni di marketing automatizzate, potresti operare un sistema ad alto rischio senza la valutazione di conformità richiesta. Mitigazione: Rivedi il modello di dati della piattaforma. Se vengono creati e utilizzati profili individuali per decisioni automatizzate, coinvolgi il tuo fornitore sulla loro classificazione ai sensi dell'AI Act e avvia un processo di valutazione della conformità.

Rischio: La conformità GDPR e AI Act è trattata come flussi di lavoro separati. Le organizzazioni che gestiscono la conformità GDPR e AI Act in team separati rischiano duplicazioni, lacune e documentazione incoerente. Mitigazione: Stabilisci un quadro di governance AI unificato che affronti entrambi i quadri normativi. Un unico processo integrato di DPIA/valutazione del rischio AI è più effiefficiente e più difendibile.

Rischio: Errata classificazione dell'ambito di inferenza delle emozioni. Il divieto di inferenza delle emozioni si applica nei luoghi di lavoro e nelle istituzioni educative. I luoghi che sono anche luoghi di lavoro — campus aziendali, ospedali, spazi di co-working — devono applicare il divieto ai sistemi rivolti ai dipendenti, non solo a quelli rivolti agli ospiti. Mitigazione: Mappa le tue popolazioni di utenti e applica il divieto a tutti i contesti in cui i dipendenti potrebbero essere soggetti all'inferenza delle emozioni.

ROI e Impatto sul Business

La conformità all'EU AI Act non è puramente un centro di costo. Le organizzazioni che costruiscono framework di governance dell'AI in anticipo rispetto alla curva di applicazione ottengono vantaggi competitivi misurabili.

Rischio normativo ridotto. Le multe per violazioni di pratiche proibite — fino a 35 milioni di euro o il 7% del fatturato annuo globale — rappresentano un rischio finanziario materiale per qualsiasi organizzazione che opera su larga scala negli stati membri dell'UE. Un approccio proattivo alla conformità elimina questa esposizione.

Differenziazione del fornitore. Poiché la conformità all'AI Act diventa un requisito di approvvigionamento, le piattaforme che possono dimostrare una chiara classificazione del rischio, pratiche AI trasparenti e interfacce conformi all'Articolo 50 saranno preferite rispetto a quelle che non possono. Per gli operatori dell'ospitalità e del retail che valutano le piattaforme di marketing WiFi, la documentazione di conformità all'AI Act sta diventando un requisito standard per le RFP.

Fiducia degli ospiti e qualità dei dati di prima parte. Gli obblighi di trasparenza ai sensi dell'Articolo 50 — se ben implementati — aumentano la fiducia degli ospiti. Gli ospiti che comprendono come l'AI viene utilizzata nella loro interazione sono più propensi a interagire in modo autentico e a fornire dati di prima parte di qualità superiore. Ciò migliora direttamente l'accuratezza dei modelli di personalizzazione e il ROI delle campagne di marketing.

Efficienza operativa tramite governance unificata. Le organizzazioni che allineano i loro framework di conformità GDPR e AI Act in un'unica struttura di governance riducono la duplicazione degli sforzi tra i team legali, IT e marketing. L'investimento nella costruzione di questo framework ripaga man mano che il panorama normativo continua ad evolversi — l'AI Act sarà seguito da ulteriori regolamentazioni specifiche sull'AI, e una postura di governance matura fornisce una base duratura.

Per gli operatori dei trasporti e le organizzazioni del settore pubblico, la conformità all'AI Act è particolarmente importante data l'accresciuta attenzione sui sistemi AI negli spazi accessibili al pubblico. La conformità proattiva dimostra responsabilità sia nei confronti dei regolatori che del pubblico, supportando obiettivi più ampi di fiducia digitale.

Per ulteriori letture sui framework di conformità correlati, consulta la nostra guida alla Conformità PIPEDA per il WiFi Ospiti in Canada , che copre requisiti analoghi di consenso e trasparenza nel contesto canadese.

Ascolta: Podcast EU AI Act e WiFi Ospiti

Termini chiave e definizioni

Provider (EU AI Act)

A natural or legal person, public authority, agency, or other body that develops an AI system or general-purpose AI model, or that has an AI system or general-purpose AI model developed, with a view to placing it on the market or putting it into service under its own name or trademark, whether for payment or free of charge.

In a Guest WiFi context, the provider is typically the WiFi marketing platform vendor or the developer of the AI personalisation engine. Providers of high-risk systems carry the heaviest compliance obligations under the Act.

Deployer (EU AI Act)

A natural or legal person, public authority, agency, or other body that uses an AI system under its own authority, except where the AI system is used in the course of a personal non-professional activity.

The venue operator — hotel group, retail chain, stadium operator — is the deployer. Deployers are responsible for Article 50 transparency disclosures and for ensuring that the AI systems they use comply with the Act's requirements, even when those systems are provided by third parties.

Biometric Categorisation System

An AI system for the purpose of assigning natural persons to specific categories on the basis of their biometric data, such as face, movement, gait, posture, voice, appearance, behaviour, or other physiological or behavioural human characteristics or traits.

Relevant for venue operators using camera-based analytics or device fingerprinting in combination with AI. Systems that infer sensitive attributes (race, religion, political opinion) from biometric data are prohibited under Article 5. Systems that perform biometric categorisation without inferring sensitive attributes may be high-risk under Annex III.

Emotion Recognition System

An AI system for the purpose of identifying or inferring emotions or intentions of natural persons on the basis of their biometric data.

Prohibited in workplaces and educational institutions under Article 5. In other venue contexts (retail, hospitality), emotion recognition systems are regulated under Annex III as high-risk and require deployers to inform affected persons under Article 50(3). Vendors marketing 'mood-based' or 'engagement state' features should be assessed against this definition.

Individual Profiling

Any form of automated processing of personal data consisting of the use of personal data to evaluate certain personal aspects relating to a natural person, in particular to analyse or predict aspects concerning that natural person's performance, economic situation, health, personal preferences, interests, reliability, behaviour, location or movements.

AI systems listed under Annex III are always considered high-risk if they profile individuals. WiFi analytics platforms that build persistent individual profiles feeding into automated marketing decisions must be assessed against this definition to determine whether they are high-risk systems.

Social Scoring

The evaluation or classification of natural persons or groups of persons over a period of time based on their social behaviour or known, inferred, or predicted personal or personality characteristics, with a social score leading to detrimental or unfavourable treatment of those persons or groups in social contexts that are unrelated to the contexts in which the data was originally generated or collected.

Prohibited under Article 5. In a WiFi marketing context, this targets AI systems that score guests on behavioural patterns and use those scores to restrict access, withhold offers, or provide inferior service. The key element is detrimental treatment — personalisation that improves the experience for high-value guests is not social scoring unless it simultaneously disadvantages lower-scoring guests.

Captive Portal

A web page or authentication gateway presented to newly connected users of a WiFi network before they are granted broader access to the internet. Used by venue operators to collect guest data, present terms of service, and deliver marketing content.

The primary deployment surface for AI-driven WiFi marketing. AI features on captive portals — chatbots, personalised splash pages, recommendation engines — are subject to Article 50 transparency obligations. The captive portal is also the point at which GDPR consent for data processing is typically obtained.

Conformity Assessment

The process of verifying whether a high-risk AI system complies with the requirements set out in the EU AI Act, including risk management, data governance, technical documentation, transparency, human oversight, accuracy, robustness, and cybersecurity.

Required for high-risk AI systems before they are placed on the market or put into service. For most high-risk systems under Annex III, providers can conduct a self-assessment. For biometric identification systems, third-party assessment is required. Venue operators deploying high-risk AI systems need to ensure their vendors have completed the required conformity assessment and can provide the documentation.

DPIA (Data Protection Impact Assessment)

A process required under GDPR Article 35 for processing operations that are likely to result in a high risk to the rights and freedoms of natural persons. The DPIA must describe the processing, assess necessity and proportionality, and identify and mitigate risks.

Required under GDPR for high-risk data processing, including large-scale profiling and systematic monitoring of publicly accessible areas. In the AI Act context, the DPIA should be extended to cover AI system risk management requirements, creating a unified assessment that satisfies both regulatory frameworks.

Article 50 Transparency Obligation

The requirement under Article 50 of the EU AI Act that providers ensure AI systems intended to interact with natural persons are designed so that those persons are informed they are interacting with an AI system, unless this is obvious from the context. Deployers must ensure this disclosure is in place.

The most immediately actionable compliance obligation for venue operators with AI chatbots or conversational interfaces on their captive portals. The disclosure must be clear and upfront — before the interaction begins — not buried in terms and conditions. Applies to all AI conversational systems regardless of risk tier.

Casi di studio

A 450-room hotel group operating across five EU member states has deployed an AI-driven chatbot on its captive portal to handle guest check-in queries, restaurant recommendations, and WiFi troubleshooting. The chatbot is powered by a third-party LLM platform. The marketing team also uses a WiFi analytics platform that builds individual guest profiles — including visit history, dwell time by venue area, and inferred demographic segments — to serve personalised promotional offers via the captive portal splash page. The CTO needs to assess the AI Act compliance posture of both systems before the next board meeting.

Step 1 — Classify the chatbot. The AI-driven chatbot is a conversational AI system interacting with natural persons. It falls under Article 50(1) as a Limited Risk system. The immediate action is to implement a clear pre-interaction disclosure on the captive portal UI: 'You are chatting with an AI assistant.' This is a front-end change. The hotel group, as the deployer, is responsible for this disclosure even though the underlying LLM is provided by a third party. Review the vendor contract to confirm the provider's AI Act classification and request their technical documentation.

Step 2 — Classify the analytics platform. The WiFi analytics platform builds individual guest profiles and uses them to serve personalised offers via automated decisions. The key question is whether this constitutes individual profiling under Annex III — automated processing of personal data to assess preferences, interests, behaviour, and location. If yes, the system is high-risk. Request the vendor's AI Act classification documentation. If the vendor classifies the system as minimal risk, obtain their written rationale and assess whether it is defensible. If the system is high-risk, begin planning for conformity assessment compliance ahead of the August 2026 deadline.

Step 3 — Audit the inferred demographic segments. If the analytics platform infers demographic segments that include sensitive attributes — age bracket, gender, nationality — using AI models, assess whether this constitutes biometric categorisation of sensitive attributes under Article 5. If the segmentation is based on declared data (loyalty programme membership, explicitly provided preferences) rather than AI inference from behavioural signals, it is lower risk. If it is AI-inferred from behavioural signals, it requires careful legal review.

Step 4 — Align with GDPR. Ensure the hotel group's privacy notice reflects AI-driven processing and the Article 50 disclosures. Review the lawful basis for the analytics processing under GDPR Article 6. If the processing is based on legitimate interests, conduct a legitimate interests assessment that accounts for the AI Act risk classification. Update the DPIA to cover both GDPR and AI Act risk dimensions.

A national retail chain with 120 stores across Germany, France, and the Netherlands is evaluating a new WiFi marketing platform that includes an AI feature described by the vendor as 'mood-based personalisation' — the system analyses the speed and pattern of a guest's captive portal interactions to infer their 'engagement state' and adjusts the promotional content served on the splash page accordingly. The IT director needs to assess whether this feature is permissible under the EU AI Act.

Step 1 — Identify the AI practice. The 'mood-based personalisation' feature analyses behavioural signals (interaction speed and pattern) to infer an 'engagement state' — which is functionally an emotional or psychological state. This is emotion inference.

Step 2 — Apply the Article 5 prohibition test. Article 5 prohibits emotion inference in workplaces and educational institutions. A retail store is not a workplace for the guest, so this specific prohibition does not apply to the guest population in the retail context. However, the feature may still be prohibited under Article 5(1)(a) if it deploys manipulative techniques to distort behaviour and impair informed decision-making, causing significant harm. The use of inferred emotional state to serve manipulative promotional content — targeting a guest identified as 'frustrated' with an urgency-based offer, for example — is likely to fall within this prohibition.

Step 3 — Assess the GDPR implications. Inferring emotional state from behavioural data constitutes processing of personal data for profiling purposes under GDPR. The lawful basis for this processing must be assessed. Legitimate interests is unlikely to be a defensible basis for emotion inference used for marketing purposes. Explicit consent is the most appropriate basis, but the consent mechanism must be specific and granular — consent to WiFi access does not constitute consent to emotion inference.

Step 4 — Recommendation. Do not deploy the 'mood-based personalisation' feature without a detailed legal assessment. The risk of Article 5 violation — specifically the manipulation prohibition — is material. Request the vendor's legal analysis of the feature's AI Act classification. If the vendor cannot provide a defensible classification, treat the feature as prohibited and do not activate it. Standard behavioural personalisation based on objective metrics (visit frequency, time of day, declared preferences) is permissible and carries significantly lower regulatory risk.

Analisi degli scenari

Q1. Your venue's WiFi marketing platform vendor has just released a new feature called 'Visitor Sentiment Scoring' that analyses the speed, sequence, and hesitation patterns of a guest's captive portal interactions to assign a sentiment score (positive, neutral, frustrated) and adjust the promotional content served accordingly. The vendor's documentation describes this as 'behavioural analytics' rather than 'emotion recognition'. As the IT director, how do you assess this feature's EU AI Act compliance status, and what actions do you take?

💡 Suggerimento:Focus on the technical function of the system, not the vendor's marketing language. Ask: what is the system actually doing? Is it inferring an emotional or psychological state from behavioural signals? Then apply the Article 5 prohibition test and the Article 50 transparency test.

Mostra l'approccio consigliato

The feature is functionally an emotion recognition system regardless of the vendor's labelling. Analysing interaction patterns to infer 'frustration' or 'positive sentiment' is emotion inference. The first step is to apply the Article 5 prohibition test: is this system being used in a workplace or educational institution? If the venue is a retail store or hotel, the Article 5 workplace prohibition does not apply to guests. However, the manipulation prohibition under Article 5(1)(a) may apply if the system uses the inferred sentiment to serve manipulative content — for example, targeting a 'frustrated' guest with an urgency-based offer. The second step is to assess whether the system falls under Annex III as an emotion recognition system, which would make it high-risk. The third step is to request the vendor's written AI Act classification and legal analysis. If the vendor cannot provide a defensible classification, do not activate the feature. Document your assessment rationale regardless of the outcome.

Q2. A stadium operator running a 60,000-capacity venue uses Purple's Guest WiFi platform to collect first-party data at events. The marketing team wants to deploy an AI chatbot on the captive portal to answer fan queries about facilities, merchandise, and upcoming events. The chatbot is powered by a third-party LLM API. The venue's legal team asks: what are the Article 50 obligations, who is responsible for compliance, and what does the implementation look like in practice?

💡 Suggerimento:Identify the deployer, the provider, and the applicable Article 50 scenario. Then specify what the disclosure must look like and when it must appear.

Mostra l'approccio consigliato

The stadium operator is the deployer; the LLM API provider is the provider. Under Article 50(1), the deployer is responsible for ensuring that guests are informed they are interacting with an AI system before the interaction begins. The implementation requires a clear disclosure on the captive portal UI — a badge or introductory message such as 'You are chatting with an AI assistant' — displayed before the first message is sent. This is a front-end change to the captive portal template. The disclosure must be explicit and upfront; it cannot be buried in the terms of service. The LLM provider has their own obligations as a provider (technical documentation, instructions for use), but the deployer cannot rely on the provider to satisfy the deployer's transparency obligations. Additionally, the stadium operator must ensure the chatbot's data processing complies with GDPR — the lawful basis for processing any personal data shared in the conversation must be established, and the privacy notice must reflect the AI-driven processing.

Q3. A retail chain's WiFi analytics platform has been building individual guest profiles for two years, combining WiFi session data (device MAC address, dwell time, visit frequency, location within store) with CRM data (purchase history, loyalty programme tier) to feed an AI model that makes automated decisions about which promotional offers to serve each guest at the captive portal. The chain's new compliance lead has been asked to assess whether this system is high-risk under the EU AI Act's Annex III individual profiling provision. What is the assessment methodology and likely outcome?

💡 Suggerimento:Apply the Annex III individual profiling test: is the AI system performing automated processing of personal data to assess aspects of a person's preferences, interests, behaviour, or location? Then consider whether the automated decisions are significant enough to trigger the high-risk classification.

Mostra l'approccio consigliato

The assessment methodology follows three steps. First, confirm that the system is an AI system (not a simple rules-based engine) — if the promotional decision is made by a machine learning model rather than a deterministic rules engine, it is an AI system. Second, apply the Annex III individual profiling test: the system is processing personal data (WiFi session data, CRM data) to assess individual preferences, interests, behaviour, and location. This meets the definition of individual profiling. Third, assess whether the system is listed under Annex III use cases — the most relevant category is 'access to and enjoyment of essential public and private services', which includes AI systems used to evaluate eligibility for services. Whether promotional offer decisions constitute 'access to services' is a grey area; if the AI system can deny a guest access to a promotional offer that materially affects their purchasing decision, regulators may take the view that this is significant. The likely outcome is that the system should be treated as potentially high-risk and a formal assessment conducted. The chain should engage the platform vendor to obtain their AI Act classification, initiate a DPIA/AI risk assessment, and begin planning for conformity assessment compliance ahead of the August 2026 deadline.