Comment gérer la bande passante sur un réseau WiFi

Ce guide de référence fournit aux responsables informatiques, aux architectes réseau et aux CTO des stratégies pratiques pour gérer la bande passante sur les réseaux WiFi d'entreprise dans les lieux à forte densité. Il couvre la Qualité de Service (QoS), la mise en forme du trafic, la limitation de débit par utilisateur et l'inspection approfondie des paquets (Deep Packet Inspection) — les contrôles essentiels pour exploiter un réseau invité équitable et performant. En intégrant ces techniques à la plateforme de WiFi invité et d'analyse de Purple, les organisations peuvent passer d'une gestion de réseau réactive à une gestion proactive et axée sur les politiques.

🎧 Écouter ce guide

Voir la transcription

- Résumé Exécutif

- Approfondissement Technique

- Limitation de Débit par Utilisateur

- Qualité de Service (QoS) et Priorisation du Trafic

- Mise en Forme du Trafic et Inspection Approfondie des Paquets (DPI)

- Segmentation SSID et Architecture VLAN

- Guide d'Implémentation

- Étape 1 : Définir le Cadre de la Politique

- Étape 2 : Configurer l'application en périphérie

- Étape 3 : Attribution dynamique de politiques via RADIUS

- Étape 4 : Façonnage du trafic de la passerelle

- Bonnes Pratiques

- Dépannage et Atténuation des Risques

- ROI et Impact Commercial

Résumé Exécutif

Pour les sites d'entreprise — qu'il s'agisse d'un vaste complexe commercial, d'un stade à forte densité ou d'un hôtel de 500 chambres — une bande passante WiFi non gérée représente un risque opérationnel important. Un seul invité diffusant une vidéo 4K ou téléchargeant de grosses mises à jour ne devrait jamais dégrader les performances des systèmes de point de vente, des communications VoIP ou des infrastructures IoT critiques. La gestion de la bande passante sur un réseau WiFi nécessite une approche multicouche qui va au-delà de la simple limitation de débit pour englober la Qualité de Service (QoS), la mise en forme intelligente du trafic et l'application dynamique des politiques liée à l'authentification des utilisateurs.

Ce guide de référence technique fournit aux responsables informatiques, aux architectes réseau et aux CTO des stratégies de déploiement exploitables pour contrôler le débit, garantir l'équité du temps d'antenne et prioriser les applications critiques. En mettant en œuvre ces meilleures pratiques indépendantes des fournisseurs et en les intégrant à des plateformes de WiFi invité et d' analyse WiFi comme Purple, les organisations peuvent transformer leur infrastructure sans fil d'un utilitaire non géré en un actif contrôlé et performant qui soutient directement les opérations commerciales.

Approfondissement Technique

La gestion de la bande passante dans un environnement sans fil d'entreprise vise fondamentalement à garantir l'équité et à protéger les services critiques. L'architecture repose sur plusieurs mécanismes interconnectés fonctionnant à différentes couches de la pile réseau.

Limitation de Débit par Utilisateur

La première et la plus fondamentale couche de défense est la limitation de débit par utilisateur, généralement appliquée au point d'accès (AP) ou au contrôleur de réseau local sans fil (WLC). En plafonnant le débit maximal pour les appareils clients individuels — par exemple, 5 Mbps en téléchargement / 2 Mbps en téléversement — les administrateurs réseau empêchent tout utilisateur de monopoliser le temps d'antenne disponible. Ceci est essentiel dans des environnements comme l' Hôtellerie , où des centaines d'invités peuvent se connecter simultanément à un circuit internet partagé.

La limitation de débit est appliquée au niveau de l'association, ce qui signifie que la politique est appliquée dès qu'un appareil rejoint le SSID. Dans les déploiements plus sophistiqués, la limite est renvoyée dynamiquement par le serveur RADIUS en tant qu'attribut spécifique au fournisseur (VSA) au moment de l'authentification, permettant des politiques par utilisateur ou par groupe plutôt qu'une limite globale unique pour tous les appareils.

Qualité de Service (QoS) et Priorisation du Trafic

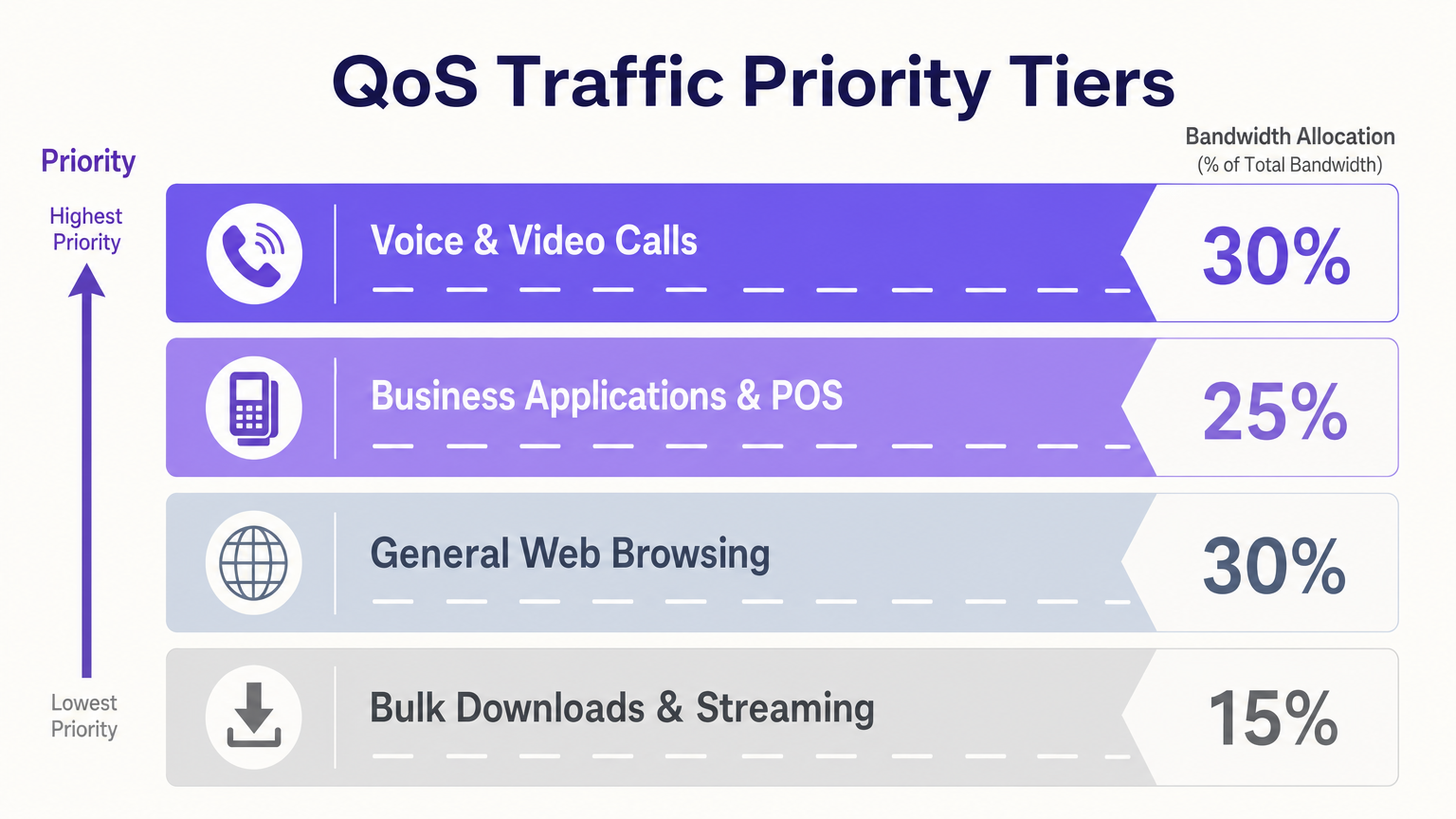

Alors que la limitation de débit contrôle le volume global, la QoS dicte la priorité des différents types de trafic. Dans un environnement d'entreprise, les applications sensibles à la latence telles que la voix sur IP (VoIP) et la vidéoconférence doivent avoir la priorité sur la navigation web générale, qui à son tour doit avoir la priorité sur les téléchargements en masse.

Cette priorisation est réalisée à l'aide du marquage Differentiated Services Code Point (DSCP) à la couche 3, et de IEEE 802.11e / Wi-Fi Multimedia (WMM) à la couche 2. Lorsqu'un paquet entre dans le réseau, il est inspecté et marqué avec une valeur DSCP. Les commutateurs réseau et les points d'accès utilisent ensuite ces marques pour placer les paquets dans différentes files d'attente matérielles, garantissant que le trafic critique est transmis en premier pendant les périodes de congestion.

Les quatre catégories d'accès WMM correspondent aux types de trafic suivants :

| WMM Access Category | DSCP Mapping | Typical Traffic |

|---|---|---|

| Voix (VO) | EF (46) | VoIP, push-to-talk |

| Vidéo (VI) | AF41 (34) | Visioconférence, IPTV |

| Meilleur Effort (BE) | Par défaut (0) | Navigation web, e-mail |

| Arrière-plan (BK) | CS1 (8) | Mises à jour OS, P2P |

Mise en Forme du Trafic et Inspection Approfondie des Paquets (DPI)

La mise en forme du trafic va au-delà de la simple priorisation en contrôlant le débit de flux d'applications spécifiques. En utilisant l'inspection approfondie des paquets (DPI) au niveau du pare-feu ou de la passerelle, les administrateurs peuvent identifier l'application sous-jacente — telle que Netflix, BitTorrent ou Microsoft Teams — quel que soit le port ou le protocole utilisé. Cela permet des politiques granulaires, comme la limitation du débit vidéo en streaming à 2 Mbps pour forcer la lecture en définition standard, plutôt que de bloquer entièrement le service.

Le blocage des services est presque toujours la mauvaise approche dans un contexte de Commerce de Détail ou d'hôtellerie. Cela entraîne une mauvaise expérience utilisateur, une augmentation des tickets de support et des invités frustrés qui associeront l'expérience négative à votre marque.

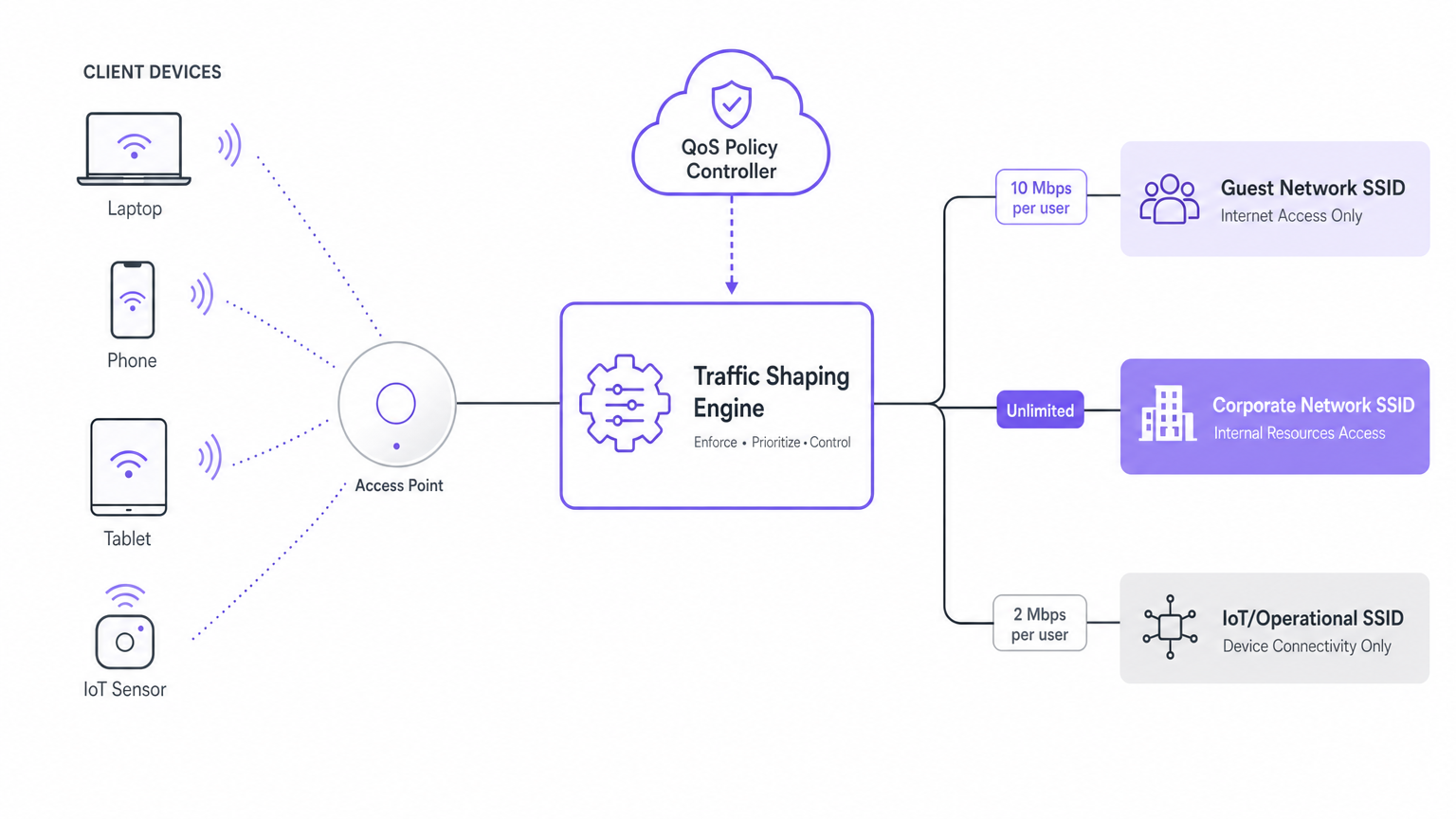

Segmentation SSID et Architecture VLAN

Une gestion efficace de la bande passante commence par une segmentation réseau appropriée. Le déploiement de plusieurs SSIDs — chacun mappé à un VLAN dédié — permet aux administrateurs d'appliquer des politiques distinctes à différents groupes d'utilisateurs :

- SSID Invité : Accès internet uniquement, limitations de débit par utilisateur, limitation d'applications basée sur le DPI.

- SSID d'Entreprise : Accès complet au réseau interne, authentifié via IEEE 802.1X / WPA3-Enterprise, pas de limitation de débit.

- SSID IoT/Opérationnel : Restreint à des flux d'applications spécifiques (par exemple, MQTT pour les données de capteurs), faible allocation de bande passante.

Cette segmentation est un prérequis pour la conformité aux normes telles que PCI DSS, qui exige que les environnements de données des titulaires de carte soient isolés des réseaux invités, et GDPR, qui impose des contrôles techniques appropriés pour protéger les données personnelles.

Guide d'Implémentation

Le déploiement d'une gestion efficace de la bande passante nécessite une approche structurée de la conception et de l'application des politiques. Les étapes suivantes décrivent une méthodologie de déploiement standard pour les environnements d'entreprise.

Étape 1 : Définir le Cadre de la Politique

Évitez de trop compliquer la QoS "politique. Commencez par un modèle simplifié à trois niveaux :

- Niveau Critique (Haute Priorité) : Technologie opérationnelle, VoIP, systèmes POS et applications d'entreprise internes. Attribuez DSCP EF ou AF41.

- Niveau Standard (Priorité Moyenne) : Navigation web générale, e-mail et médias sociaux pour l'accès invité. Attribuez DSCP Default (0).

- Niveau Scavenger (Basse Priorité) : Mises à jour du système d'exploitation en arrière-plan, transferts de fichiers volumineux et trafic peer-to-peer. Attribuez DSCP CS1.

Étape 2 : Configurer l'application en périphérie

Mettez en œuvre la limitation de débit par utilisateur au niveau de l'AP. Pour un environnement de vente au détail typique offrant un WiFi invité gratuit, une limite de 2 à 5 Mbps par utilisateur est généralement suffisante pour la navigation standard et l'engagement sur les médias sociaux sans saturer la liaison WAN. Pour les environnements de conférence où les utilisateurs peuvent avoir besoin de passer des appels vidéo, 10 à 15 Mbps par utilisateur est plus approprié, sous réserve de la capacité WAN totale.

Étape 3 : Attribution dynamique de politiques via RADIUS

Pour les déploiements avancés, intégrez les politiques de bande passante à la couche d'authentification. Lorsqu'un utilisateur s'authentifie via un captive portal ou 802.1X, le serveur RADIUS peut renvoyer des attributs spécifiques au fournisseur (VSAs) qui attribuent dynamiquement l'utilisateur à un niveau de bande passante ou un VLAN spécifique en fonction de son profil.

En utilisant la plateforme Guest WiFi de Purple, un membre d'un programme de fidélité pourrait recevoir une allocation de 20 Mbps, tandis qu'un invité standard reçoit 5 Mbps. Cette approche est très efficace dans les pôles de Transport et les établissements hôteliers haut de gamme où les niveaux de service différenciés constituent un avantage concurrentiel.

Étape 4 : Façonnage du trafic de la passerelle

Assurez-vous que la liaison WAN en amont est protégée. Mettez en œuvre le façonnage du trafic au niveau du pare-feu de périphérie pour garantir la bande passante des VLAN critiques avant que le trafic n'atteigne le FAI. Si la connexion Internet est saturée, même la meilleure configuration QoS sans fil ne parviendra pas à offrir une bonne expérience utilisateur. C'est l'étape la plus souvent négligée dans les déploiements WiFi d'entreprise.

Bonnes Pratiques

Activer l'équité du temps d'antenne. Dans les environnements à haute densité, l'équité du temps d'antenne est plus critique que le débit brut. Cette fonctionnalité empêche les appareils plus anciens et plus lents (par exemple, 802.11b/g) de monopoliser le temps radio, garantissant que les appareils modernes reçoivent leur juste part d'opportunités de transmission. Sans cela, un seul appareil hérité transmettant à 1 Mbps peut réduire le débit effectif de tout un secteur d'AP.

Désactiver les débits de données inférieurs. Forcez les appareils plus anciens à quitter le réseau ou à se connecter à la bande 2,4 GHz en désactivant les débits de données inférieurs à 12 Mbps ou 24 Mbps sur la radio 5 GHz. Cela maintient la bande 5 GHz dégagée pour des transmissions plus rapides et plus efficaces et réduit la surcharge de gestion des clients à faible débit.

Mettre en œuvre le Band Steering. Encouragez activement les clients compatibles bi-bande à se connecter aux bandes 5 GHz ou 6 GHz moins encombrées, laissant la bande 2,4 GHz pour les appareils hérités et les capteurs IoT. Cela est particulièrement pertinent dans les déploiements sur de grandes surfaces — consultez le Indoor Positioning System: UWB, BLE, & WiFi Guide pour en savoir plus sur la gestion des environnements d'appareils mixtes.

Surveiller et Itérer. La gestion de la bande passante n'est pas une configuration "définir et oublier". Utilisez les tableaux de bord WiFi Analytics pour surveiller les tendances d'utilisation des applications, les périodes de pointe de concurrence et le débit par SSID. Ajustez les politiques de façonnage à mesure que le comportement des utilisateurs évolue — le profil de trafic d'un site de vente au détail en décembre différera considérablement de son profil en juillet.

Protéger les environnements de santé. Dans les milieux cliniques, les enjeux sont considérablement plus élevés. Référez-vous au WiFi in Hospitals: A Guide to Secure Clinical Networks pour des conseils spécifiques sur la gestion de la bande passante dans les environnements où la communication des dispositifs médicaux doit être garantie.

Dépannage et Atténuation des Risques

Lorsque les politiques de gestion de la bande passante échouent, les symptômes se manifestent souvent par une connectivité intermittente, des appels VoIP interrompus ou un rendu lent du captive portal. Voici les modes de défaillance les plus courants et leurs solutions.

QoS Asymétrique. Les balises DSCP sont souvent supprimées par le FAI ou non respectées sur la liaison WAN. Assurez-vous que le façonnage du trafic est appliqué au point de sortie de votre réseau pour contrôler le flux avant qu'il ne quitte votre domaine administratif. Ne comptez pas sur le FAI pour respecter vos marquages DSCP internes.

AP Sursaturés. La limitation de débit ne résoudra pas la congestion de la couche physique. Si un AP a trop de clients associés — généralement plus de 50 à 75 appareils actifs sur une seule radio — la surcharge de gestion des connexions dégradera les performances, quelles que soient les limites de bande passante. Dans de tels cas, une refonte physique du réseau et un déploiement d'AP supplémentaires sont nécessaires.

Délais d'attente du Captive Portal. Si les limites de bande passante sont trop faibles (inférieures à 1 Mbps), la redirection initiale vers le captive portal peut expirer, empêchant les utilisateurs de s'authentifier. Assurez-vous que l'état 'jardin clos' de pré-authentification dispose d'une bande passante suffisante pour charger rapidement les ressources du portail. Un minimum de 2 Mbps est recommandé pour le flux d'authentification.

Mauvaise configuration VLAN. Un étiquetage VLAN incorrect au niveau du port du commutateur connecté à l'AP peut entraîner le passage du trafic de différents SSIDs dans le mauvais segment de réseau, contournant les politiques de QoS et de sécurité. Validez toujours les attributions VLAN avec une capture de paquets avant la mise en service.

ROI et Impact Commercial

Une gestion efficace de la bande passante a un impact direct sur les résultats financiers en reportant les mises à niveau coûteuses des circuits WAN et en améliorant l'efficacité opérationnelle. En priorisant les applications critiques, les sites s'assurent que les systèmes générateurs de revenus — tels que les terminaux POS, les applications de commande et les outils de communication du personnel — restent fonctionnels même pendant les périodes de forte affluence des invités.

De plus, les modèles de bande passante à plusieurs niveaux offrent des opportunités de monétisation directe. Les sites peuvent fournir un niveau d'accès Internet de base gratuitement, tout en offrant un niveau premium à haute vitesse en échange de l'inscription à un programme de fidélité, générant un RO mesurableIl provient de l'infrastructure sans fil. Ce modèle est de plus en plus courant dans les environnements de l' Hôtellerie et du Transport .

Pour un aperçu plus large des considérations de déploiement initial, consultez Comment configurer le WiFi pour votre entreprise : Un guide complet .

Termes clés et définitions

Quality of Service (QoS)

A set of technologies and policies that prioritize certain types of network traffic over others to ensure consistent performance for critical applications during periods of congestion.

Essential for ensuring VoIP calls and POS transactions are not delayed by guest downloads on a shared network.

Traffic Shaping

The practice of regulating network data transfer to enforce a guaranteed level of performance, typically by delaying or dropping packets that exceed a defined rate for a specific application or flow.

Used at the gateway to throttle high-bandwidth applications like streaming video before they saturate the internet connection.

Per-User Rate Limiting

A policy that caps the maximum upload and download throughput for an individual client device on the network, regardless of the total available bandwidth.

The primary defence against a single user monopolising the wireless network in a public venue. Applied at the AP or WLC level.

Deep Packet Inspection (DPI)

Advanced network packet filtering that examines the data payload of a packet as it passes an inspection point, enabling application-level identification beyond simple port and protocol analysis.

Allows IT teams to throttle 'Netflix' specifically, rather than blindly throttling all HTTPS traffic on port 443.

Airtime Fairness

A wireless feature that allocates equal transmission time to all connected clients, regardless of their theoretical data rate, preventing slower devices from monopolising the radio medium.

Critical in high-density environments. Without it, a single legacy 802.11g device can reduce effective throughput for all modern devices on the same AP.

Differentiated Services Code Point (DSCP)

A 6-bit field in the IP header used to classify network traffic into service classes, enabling routers and switches to apply Quality of Service policies.

The standard Layer 3 method for tagging packets so that switches and routers know which traffic is high priority. DSCP EF is used for VoIP; DSCP CS1 for background traffic.

Wi-Fi Multimedia (WMM)

A Wi-Fi Alliance specification based on the IEEE 802.11e standard that provides four access categories (Voice, Video, Best Effort, Background) for wireless QoS prioritization.

Translates Layer 3 DSCP tags into Layer 2 wireless priorities, ensuring that VoIP packets are transmitted before web browsing packets at the radio level.

Band Steering

A technique used by Access Points to encourage dual-band capable client devices to connect to the less congested 5 GHz or 6 GHz bands instead of the 2.4 GHz band.

Improves overall network capacity and performance by utilizing the wider channels available in higher frequency bands, leaving 2.4 GHz for legacy devices and IoT sensors.

Vendor-Specific Attribute (VSA)

An extension to the RADIUS protocol that allows network vendors to define custom attributes returned during authentication, such as bandwidth limits or VLAN assignments.

Used by platforms like Purple to dynamically assign per-user bandwidth policies at the point of captive portal authentication.

Études de cas

A 500-room hotel is experiencing poor performance on their Point-of-Sale (POS) tablets in the restaurant during the evening, coinciding with peak guest streaming activity in the rooms. The WAN link is 500 Mbps and is running at 90% utilisation during peak hours.

- Segregate POS traffic onto a dedicated operational VLAN (e.g., VLAN 10), separate from the guest VLAN (VLAN 20). 2. Configure the wireless LAN controller to map POS device traffic to DSCP EF (Expedited Forwarding) and ensure the WMM Voice (VO) queue is used for this SSID. 3. Implement DPI at the edge firewall to identify and throttle streaming video applications (Netflix, YouTube, Disney+) on the guest VLAN to a maximum of 3 Mbps per flow, ensuring standard definition playback while preserving WAN bandwidth. 4. Apply a per-user rate limit of 10 Mbps on the guest SSID to prevent any single device from consuming a disproportionate share of the circuit. 5. Configure the gateway to guarantee a minimum of 50 Mbps for the operational VLAN before any bandwidth is allocated to guest traffic.

A large retail chain with 150 stores wants to offer free WiFi to shoppers but needs to ensure the network isn't abused by neighbouring businesses or residents, and that the connection remains usable for the in-store digital signage system.

- Deploy a captive portal requiring SMS or email authentication to deter casual abuse and capture customer data for CRM. 2. Apply a strict per-user rate limit of 3 Mbps down / 1 Mbps up on the guest SSID. 3. Implement a session timeout of 2 hours, requiring re-authentication to continue using the service — this prevents all-day squatters. 4. Block known peer-to-peer (P2P) file-sharing protocols at the gateway firewall. 5. Place the digital signage system on a dedicated SSID mapped to a separate VLAN with a guaranteed minimum bandwidth allocation of 20 Mbps, completely isolated from the guest network. 6. Use Purple's analytics platform to monitor peak usage periods and adjust rate limits by time-of-day if required.

Analyse de scénario

Q1. A conference centre expects 2,000 attendees for a technology summit. The WAN connection is 1 Gbps. Assuming a 50% device concurrency rate, what is the maximum per-user rate limit you should configure on the guest SSID, and what additional controls would you implement to protect the WAN link?

💡 Astuce :Calculate available bandwidth per concurrent user, then consider that not all users download simultaneously at their maximum rate.

Afficher l'approche recommandée

With 2,000 attendees and a 50% concurrency rate, expect approximately 1,000 active devices. The theoretical maximum per-user limit to avoid saturating the 1 Gbps WAN link is 1 Mbps (1,000 Mbps / 1,000 users). However, since not all users download at their peak rate simultaneously, a practical limit of 5–10 Mbps per user is appropriate, combined with DPI-based throttling of streaming video to 3 Mbps per flow and a Scavenger-class policy for bulk downloads. Gateway traffic shaping should reserve a minimum of 100 Mbps for any operational VLANs.

Q2. You are deploying a new wireless network in a hospital. Clinical staff use VoIP communication badges that operate on the 5 GHz band. How should you configure the QoS policies at both the wireless (Layer 2) and wired (Layer 3) layers to ensure reliable communication?

💡 Astuce :Consider both the wireless (Layer 2 WMM) and wired (Layer 3 DSCP) prioritization mechanisms, and ensure they are consistent end-to-end.

Afficher l'approche recommandée

Configure the VoIP badges or their associated SSID to tag outbound traffic with DSCP EF (46). On the WLC and APs, map DSCP EF to the WMM Voice (VO) hardware queue. Ensure that the wired switches connecting the APs to the distribution layer are configured to trust DSCP markings from the AP uplink ports, and that the voice traffic is placed into the priority queue across the entire LAN. At the gateway, guarantee a minimum bandwidth allocation for the clinical VLAN. See also the guidance in WiFi in Hospitals: A Guide to Secure Clinical Networks for additional clinical-specific considerations.

Q3. A retail store manager reports that guest WiFi is slow, but monitoring shows the WAN link is only at 20% utilisation. The AP in the main seating area has 150 associated clients, many of which are older smartphones. What is the likely root cause and the recommended remediation?

💡 Astuce :The issue is not raw bandwidth availability — it is wireless medium contention at the radio layer.

Afficher l'approche recommandée

The AP is suffering from airtime congestion, exacerbated by older 802.11b/g devices transmitting at slow data rates (1–11 Mbps). Each slow transmission occupies the radio medium for a disproportionately long time, reducing the effective throughput for all other clients. The solution is: (1) enable Airtime Fairness to allocate equal transmission time rather than equal data volume; (2) disable data rates below 12 Mbps on the 5 GHz radio to force clients to transmit faster or roam to a closer AP; (3) review the AP placement and consider adding additional APs to reduce the client load per radio below 50 active devices.